2026-05-27 17:00:16

前几年关于工作内容方面的回顾:

大概开发了两个月,MVP 功能基本完成,公开内测之后运营效果比较差,就直接搁置了。我承担包括合约开发、后端逻辑开发、前端界面开发。

这个项目在产品形态上做成了 friend.tech + 分答(知乎)+ NGL 模式的混合体。

项目的核心逻辑是,creator 为主体,可以创建 card(key),card 的价格可以被炒作。其他人可以向 creator 提问问题,creator 回答问题的时候,可以选择公开或者不公开。对于不公开的回答,其他人可以花费 1 USD 来解锁答案。同时,creator 接受匿名提问(NGL 模式)。

还有一些运营方面的功能,可以根据 X 账号给别人创建 card、一键把 X 账号的信息同步到网站上之类。

开发了大概两个月,核心逻辑基本可用,虽然还有 bug。我承担包括后端和前端逻辑的开发。

这个 Trading Bot 的核心功能包括:批量生成钱包、从 Binance、BitMart、MEXC 批量提现、集成了 Aerodrome 和 Uniswap 交易、支持 V2 和 Slipstream 交易池,功能模块上可以一键导入代币、管理交易对、管理 project,支持一键批量 warm up 钱包的交易、在某一个价格范围内的 range trading 交易。有 K 线图、一键 simulation 交易数据、根据 simulation 数据创建 task、交易结果 analysis 等。还有余额情况的 snapshot、trends 图、gas fee 图等。还有对某一个代币持仓情况分布的监控、对某一个地址行为的监控等。

两周时间出 MVP,当时在考虑做预测市场周边的项目,但是不确定做什么,所以这个小程序类似一个 Polymarket 平台的 paper trading 游戏,只是比交易更简单,在 PM 已经结束的 markets 中,单纯选择 yes 和 no,然后和真实的事件结果对比。用户有积分榜、连胜榜等统计。

可能做了不到一个月,说实话做的很糟糕。项目本意是做预测事件的跨平台对比,我们索引了 DefiLlama 上排名靠前的六七个预测市场的数据,包括 Polymarket、Kalshi、Limitless Exchange 等,然后试图把数据整合为一种事件数据对比的工具界面。

但是遇到不少问题,这种预测市场本质上是中心化的交易平台,对标 Binance、OKX 这种交易所,而不是去中心化的数据。预测市场基本上都是链下撮合、链上交易的模式,所以索引数据本身就是个问题,很大程序上受到平台方 API 的 rate limit 限制。

其次是数据分析比较重,哪怕通过 Subgraph 之类索引到全部的数据,也需要稍微高配的数据库和硬件做分析,需要不小的硬件成本。

最后是盈利模式的问题,除非数据分析的非常好非常准,然后以订阅制也就是 BaaS 的运作模式收费,否则普通用户看到了跨平台的数据、甚至看到套利机会,然后呢,去对应的平台交易了。所以这个方向比较吃力不讨好。

做了可能不到半个月。基于做 Screener 索引到的大量数据,就发现市场上存在一个缺口,就是把新闻一类的信息,和真实的预测市场的交易盘之间,如何关联起来?

所以我们做的事情是把预测市场摘要文本生成 embedding 数据存起来,用户可以输入任意文本,无论是长文本还是短文本,然后返回与搜索文本相匹配的 markets 数据,包括 Polymarket、Kalshi 等。

这个功能的本意是,假如用户看到一个突发新闻,想要去 Polymarket 上下注,但是又不知道有哪些可以下注的 markets。

这是现在仍然在进行的项目,已经开发了三四个月,参考了 Polymarket Builder 榜单上的主流项目,现在 Web Terminal 和 TG Copy Trading 两个方向在同时推进。

这个项目主要就是通过预测市场平台的 API 进行套壳交易,已经支持了 Polymarket 和 Predict.fun 两个平台,也支持了针对 Polymarket 交易的 Copy Trading。当然也在试图集成一些概念,比如 AI 分析、AI Skills、托管自动交易等。

现在,AI Coding 已经成为事实上在发生的事情,会带来深刻的变革。关于程序员的身份认同、价值体现、差异性来源等问题,我发现两句有意思的话,并且附带来源:

Computer science can be probably called applied logic because it originated from logicians.

来源:《Ground-Up Computer Science 》第 3 章

Programming is just another name for the lost art of thinking.

来源:《Ground-Up Computer Science 》第 7 章

2026-05-16 16:50:14

中心化的加密货币价格能不能涨呢?能涨,而且拉盘、控盘、砸盘更狠。大一点的像 ETH,SOL、BNB,随意一点的就是 TRUMP、DOGE 一类。但是你要相信,如果你是从二级市场开始参与,那么拉盘周期吃到肉的人,一定不会是你。要么喝汤,要么被割(大概率)。

美股能不能涨呢?能涨,虽然所有的股票都是中心化的,但是完全适合用于投资,因为有监管,有审核。英伟达、苹果、谷歌、特斯拉。

从投资者的视角,硅谷已经不从二级市场割韭菜了,从 1.5 级市场就开始割。OpenAI 和 Anthropic 万亿美元级别的估值,一旦上了二级市场,就等着小韭菜们接盘,价格会逐渐跌。但是人家融资,你有钱也投不进去。真正顶级的公司,一级市场都没机会。而不那么顶级的公司,几个 VC 互相割。不管能不能 IPO 割小韭菜,VC 的钱是割到了。

人们买加密货币是为了什么?是为了高倍的涨幅,想从中挣钱。币圈没有信仰,要有信仰也都是信仰钱。金融市场都是为了钱。没有人是为了去中心化的信仰和理想买比特币的。

回到比特币的初衷,比特币想干什么来着?比特币想要抗通胀。现代政府和金融体系要依靠负债表的不断扩张,来维持社会运转,也就意味着法币从趋势上是持续增发的。

比特币有供应量上限,正是为了应对通胀。所以 ETH 等所有没有供应量上限的公链,哪怕代币供应量是动态条件之后通缩的,也达不到抗通胀的目的。

2008 年,全球的法币总供应量大概 21 万亿美元,因此比特币的总供应量设计为 2100 万。按照当时的愿景,当比特币能代替全球的法币职能的那一天到来,一个 BTC 的价格应该等于(当时的) 100 万美元。

这不是巧合,比特币的精度是 8 位小数点,最小单位是 sat,那么如果 1 BTC = 100 万美元,恰好 1 sat = 1 美分,美元的最小单位就是比特币的最小单位。

2009 年,密码学家 Hal Finney 成为历史上第一个接受比特币转账的人,收到了来自中本聪 10 BTC 的转账。

2009 年,全球的家庭总财富体量大概在 100 万亿到 300 万亿之间。按照这个财富价值估算,如果比特币在全球的资产储备中占据主导地位,一个 BTC 的价格将约等于(当时的) 1000 万美元。

2027 年,全球货币总供应量大概 70 万亿美元,全球家庭财富总量大概 530 万亿美元。映射到比特币上,如果按照 M1 供应量计算,每个 BTC 的价值等于 333 万美元。如果按照财富总量计算,每个 BTC 的价值等于 2650 万美元。

这就是比特币的特殊之处,比特币不是为了创造下一个百万富翁,而是为了保护全世界人的资产不受到损失。BTC 的价格不应该再大幅暴涨,而是应该稳定逐步随着法币的增发而价值上涨。

从抗通胀的逻辑,比特币和黄金在同一个赛道,山寨币和美股在同一个赛道。

所以结论是:

两个负面规则:

2026-04-24 20:34:05

Gavin Wood 当年在设计 EVM 的时候,会面临两个问题:基于栈还是基于寄存器?显然实际上的 EVM 是基于栈的,也许是出于上线迭代等外部因素影响,也许是出于 Gavin 当时的历史局限性。后来 Gavin 离开了以太坊、创建了 Polkadot 之后,一开始把 Polkadot 的虚拟机设计为 基于 WASM 虚拟机,最近又转向了基于 RISC-V 指令集的、用于实现通用计算的虚拟机。也就是说,Gavin 抛弃了基于栈的 EVM 的老路,最终转向寄存器结构的 RISC-V。

EVM 底层是 256 位的无符号数字,每一条指令、每一个数据,都会拆解为 256 位的数字来表示。至于为什么是 256 位,可能因为以太坊是从比特币演变来的,而哈希算法 Keccak-256 和签名算法 secp256k1 等都沿用了比特币的设计,它们的输出都是 256 位,为了无缝适配这些加密算法,就采用了 256 位的字长。

我们平时使用的电脑 CPU,大都是 64 位的。CPU 经历过 32 位的时代,但是由于在地址寻址的方式下,32 位最多表示 2^32 Byte = 4 GB 的内存大小,已经跟不上使用需求,所以现在的 CPU 已经都是 64 位的。

这里有两个数字,EVM 是 256 位的,CPU 是 64 位的。这也就意味着,每一个 EVM 的指令操作,到了 CPU 上都至少需要 10 个指令来完成,模拟一个栈内存、计算低位、计算高位、把结果推回栈等,这一套动作下来,256 位的 EVM 指令在执行效率上,比使用 64 位 CPU 指令,慢大概 10 倍到 100 倍。

RISC-V 是一个精简的指令集架构标准,包含有 64 位的 RISC-V 虚拟机指令标准。这就意味着,通过 JIT 编译,RISC-V 的指令几乎可以 1:1 映射到现代 64 位的 CPU 上,执行效率接近于 CPU 本身的效率。

Arbitrum 有过一次叫 Stylus 的 版本升级,内容是用运行于 WASM 的虚拟机性能与 EVM 虚拟机的性能进行对比,官方的宣传口径是,一个简单的加法 ADD 运算,在 WASM 上的 Gas 消耗比在 EVM 上少 150 倍,而这 150 倍就是指令集转换带来的额外开销。WASM 的性能比 RISC-V 差,因为 WASM 从设计之初是在浏览器环境运行一个多编程语言的虚拟机,所以合理推测,基于 RISC-V 的指令,性能上也要好过 EVM 至少 100 倍。

从指令执行的效率方面来看,RISC-V 绝对要好过 EVM 太多。

另一方面,RISC-V 非常适合做通用计算,比如 cartesi 这个项目,相当于直接在每一个链上节点本地,运行一个小型的 Linux 系统,这个系统内能运行的,就不只是智能合约,而可以包括各种各样进程级别的程序,这能释放很大的想象空间。

很多 zkVM 也都是基于 RISC-V 在做,毕竟要给一个 256 位的虚拟机以及各种复杂的指令集开发 ZK 电路,心智负担太大了,而 RISC-V 是一个精简指令集,只有比较底层的指令,比 zkEVM 实现起来要更加容易并且通用。

至于 EVM 方面,也有在性能方面做出卓越突破的链比如 Monad,实现了真正的并行 EVM。只不过 Monad 提高性能的方式并不是从比较底层的指令集层面去做,而是乐观执行、有冲突再回滚的方式,以及实现了专用的数据库而不是通用的 KV 数据库来提高磁盘 IO 效率,整体结合下来,让 EVM 的执行速度有了显著提升。

那么至此可以看到的是,基于 RISC-V 指令集的虚拟机、智能合约语言,有着种种性能上的优点。

是不是意味着 RISC-V 是替代 EVM 的最佳趋势呢?显然也不是。

生态方面的护城河当然很重要,RISC-V 属于彻底抛弃了 EVM 体系、自成一套,支持各种编译型的编程语言。那也就意味着,包括开发者和审计公司,在 EVM 上踩过的坑,需要推倒重来。这是谁都不愿意看到的事情。EVM 的简单带来了性能上的劣势,也让安全风险和执行逻辑上的排查更加可控,因为是栈结构,Solidity 语言里连指针操作都没有,确定性非常高。而 RISC-V 的寄存器模式,合约的 ABI 不再是字节码而是 ecall ABI,里面涉及到内存分配、有堆内存、有垃圾回收,复杂度非常高。

而为了解决确定性的问题,一般的做法是在 RISC-V 支持的编程语言上,再阉割一层,用一个沙盒环境来执行合约逻辑,并且禁用一些语言特性,从沙盒外部能够看到一个确定性的结果。这当然就会牵扯到,每一个项目都在定义自己的沙盒标准,没有业界统一的方案。

再就是很多项目方宣传口径上的问题,放大了 RISC-V 的性能优势,刻意在忽略 RISC-V 模式带来的冯诺伊曼税的问题。在 EVM 上,修改余额就是一个 SSTORE 指令,EVM 天然知道什么是账户、什么是余额,要去数据库的什么位置寻找数据。而 RISC-V 过于通用,如果要修改余额,可能需要先分配内存、处理语言运行时的边界检查、写入数据、释放内存等,虽然单个指令的执行效率高了,但是反而在业务逻辑上消耗了更多的 CPU 周期。

总的来说,RISC-V 虚拟机还无法代替 EVM 虚拟机。

2026-04-22 17:50:48

Polkadot 有一个叫 Existential Deposit (ED) 的机制,含义是如果你的账户余额小于 1 DOT,区块链网络会直接删除你的账户以及余额。删除的意思是指,你的地址信息将不存在于链上,其他地址无法转账小于 1 DOT 给你,你的余额以及 Nonce 值会被直接抹除,整个网络的代币总供应量也会因此减少。

我们先来理解一下为什么 ED 这样的设计会存在。Vitalik 要说代码和工程水平可能远不及他拥有的名气,Gavin Wood 是以太坊的实际开发者。Gavin 因为实际设计了以太坊的节点,所以很清楚以太坊存在状态数据会无限膨胀的问题。

以太坊节点会把整条链上所有有过交易记录的地址信息,都维护到世界状态中,用的是一种叫 MPT 的树结构,每个地址信息都是树上的一个叶子节点。那么就存在一个问题,我们平时使用以太坊钱包也会有体会,如果地址里有 0.00001 ETH 的余额,这种非常小额的余额,是永远无法被转出的,因为以太坊对于普通转账交易,固定要求 21000 Gas,无论 Gas Price 多低,以太坊账户的余额都不可能彻底清零。这种非常小的余额被称为粉尘余额,对于强迫症来说会是一种灾难。

对于以太坊节点来说,这些地址以及余额,就不仅只是视觉上强迫症的问题,而是意味着,节点需要维护的状态数据,永远都会只增加、不减少。每多一个新的地址有余额,服务器上的节点就需要多储存一份地址的键值对信息,哪怕对内存的占用量很小,也会持续累积和增加,给服务器持续带来压力。这种设计在工程上是很暴力、不负责也不合理的。

针对粉尘余额,存在两个问题,我们分别来对比:

比特币是如何解决粉尘余额问题的?假如有一个 UTXO 地址里的余额非常小只有 1 sats,那么自己发起转账肯定是不行的,因为 1 sats 不够付矿工费。但是比特币的交易允许有多个 input,只要把小额的 UTXO 作为其中一个 input,再让其他有大额余额的 UTXO 作为另外的 input 来支付矿工费,整笔交易就可以成功,拥有 1 sats 的 UTXO 余额也会清零。所以是 UTXO 账户模型让比特币天然没有粉尘余额的问题。

以太坊是粉尘余额的起源地,所以目前始终无法解决。

Polkadot 为了解决粉尘余额的问题,把 Existential Deposit 作为 Day Zero 的核心设计写到了协议里。余额小于 1 DOT 就会被自动清除,自然不存在粉尘余额的问题。这种清除余额并不是指余额会转给矿工或者转给黑洞地址,而是凭空消失一样地清除。

比特币节点也是需要 chainstate 的,会把所有有余额信息的地址信息都维护在节点的内存中。不过相比以太坊,由于比特币地址的粉尘余额是可以被清零的,而节点方面对于余额是 0 的地址不需要维护一份状态数据,如果一个地址的余额是 0,节点就可以把地址从状态数据中删掉,内存占用就可以减少一点点。所以对于比特币节点来说,状态数据并不会只增不减,而是可以根据实际情况有增有减。

以太坊节点呢,一方面因为用户余额本身就无法清零,余额再小节点也得维护状态。另一方面在于,以太坊其实有清理状态数据的机制,只是地址可以被清理的要求很苛刻,需要余额为 0,并且 Nonce 值为 0。Nonce 值这个东西,也是比特币没有的概念,以太坊为了账户-余额模型加的。也就是说,哪怕余额为 0 了,只要发出过交易,Nonce 值就不可能是 0。两方面原因叠加下来,以太坊的状态数据会只增不减,持续膨胀。

Polkadot 呢,同样是利用 Existential Deposit 的设计,会直接清理掉小于阈值的地址以及相关信息,相应的,链上节点维护状态数据的压力就会变小。

所以 Polkadot 利用 Existential Deposit 这种机制,同时解决了粉尘余额对于用户以及对于节点的影响,在工程上是一种比较纯粹和现代化的设计。

回到标题,Polkadot 的这种设计有错吗?

程序员群体在解决现实问题的时候,往往会偏好工程化的解决方式,而忽略现实用户的体验。Polkadot 给人的感觉就是,小钱不是钱,我没钱就不配用。

加密货币作为一种资产,一种货币,一种钱,链上节点像是在回收垃圾一样,把我的余额给回收掉。是不是等同于在说,小的金额就是垃圾?用编程语言的垃圾回收机制,来针对加密资产做回收,这是比较错配的行为。内存中的无效资源、悬空对象可以是垃圾,但是用户的资金不是。在比特币网络,哪怕只有 1 sats,也会安安静静躺在那里。

Polkadot 的 Existential Deposit,直接违背了加密货币的根本原则:只有持有私钥的人,才有资产的控制权。

我们常说 “Not your keys, not your coins”,但是到了 Polkadot 这里,只有你自己持有私钥对吧,但是链上的节点可以直接抹掉你的余额,在没有私钥的情况下让地址内的余额发生了变化。这是一种非常违背原则的做法。

在区块链中,唯一有效的、对余额产生影响的,应该来自于账本数据,以太坊尚且没有做得这么过分,但是 Polkadot 做了,直接改了状态数据里的余额,在没有交易行为的情况下,引入了节点层面的收割机制。

如果说 AA 钱包 是以太坊为了解决账户模型而打出的一个补丁,那么 Existential Deposit 就是 Polkadot 为了填补账户模型打出的另外一个补丁,试图在以太坊的基础上向前多走一步,而做出的激进设计。

2026-03-02 13:52:16

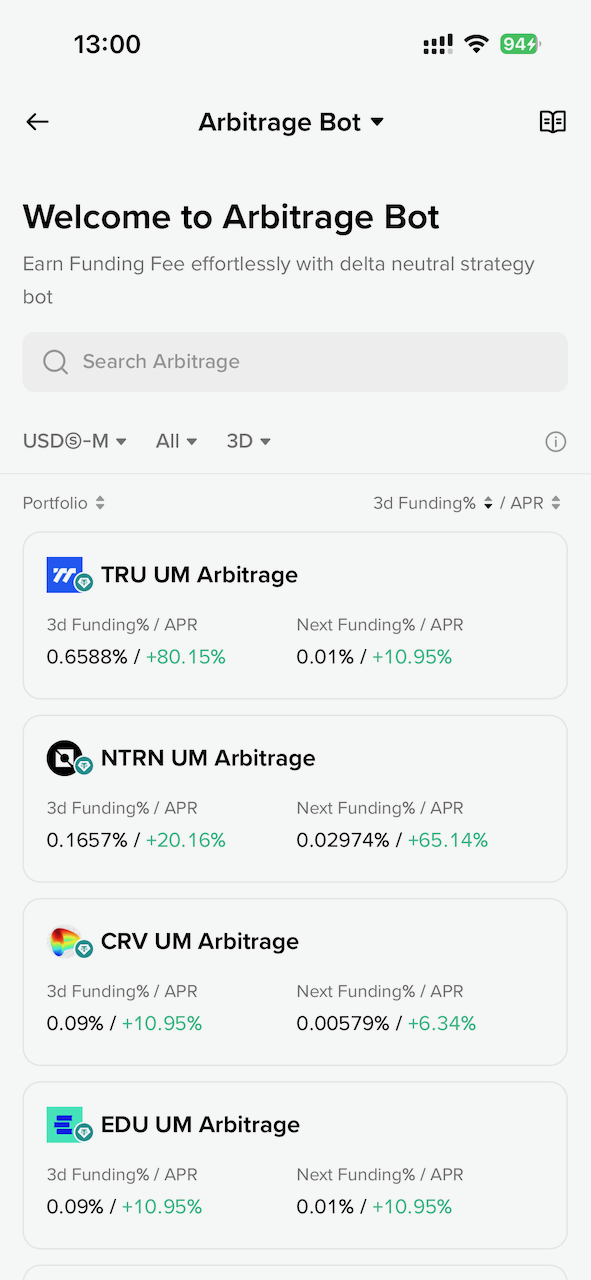

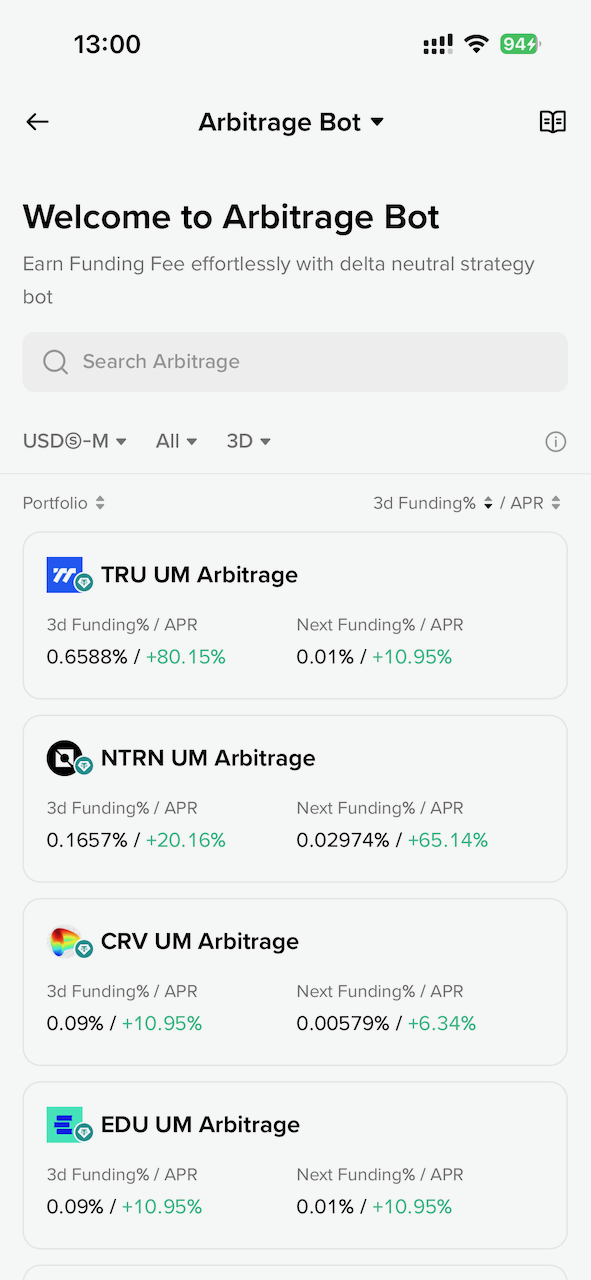

资金费率套利是一种没有风险、保本的套利方式。我一开始尝试自己写脚本来运行策略,后来发现 Binance 直接提供了 bot 来进行这种操作:

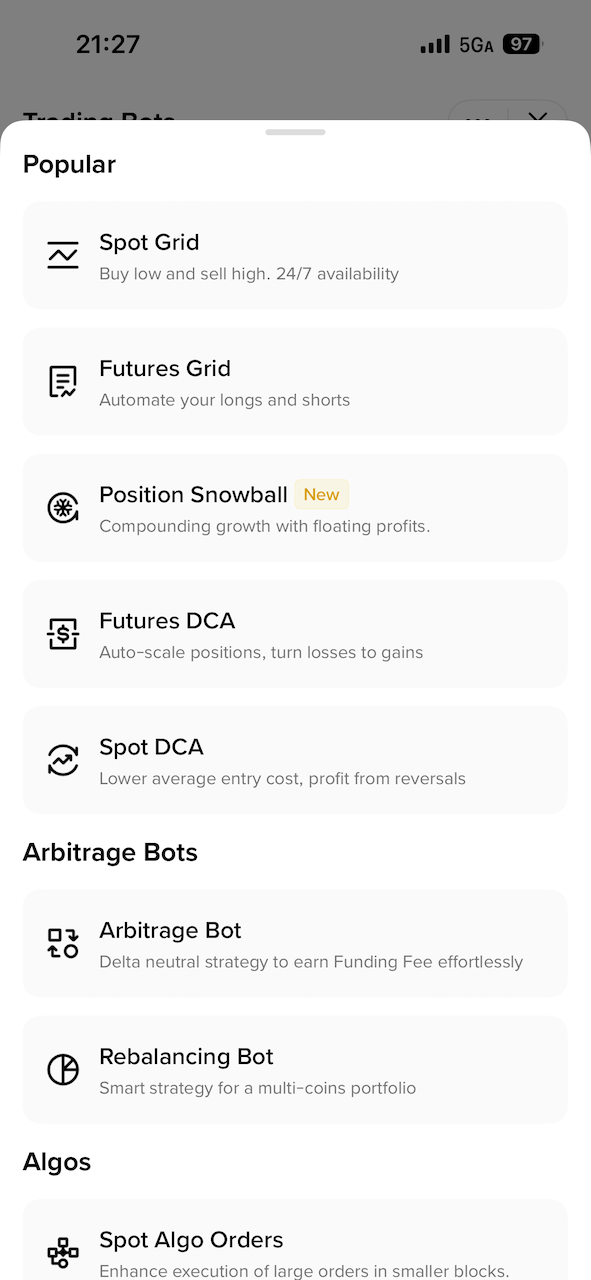

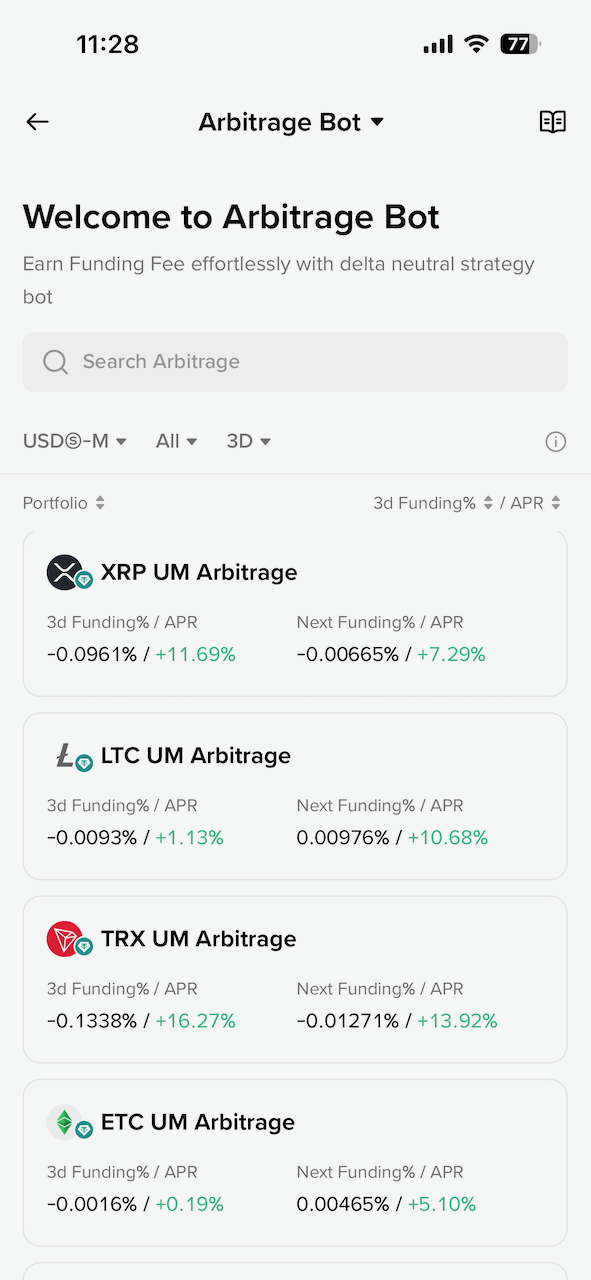

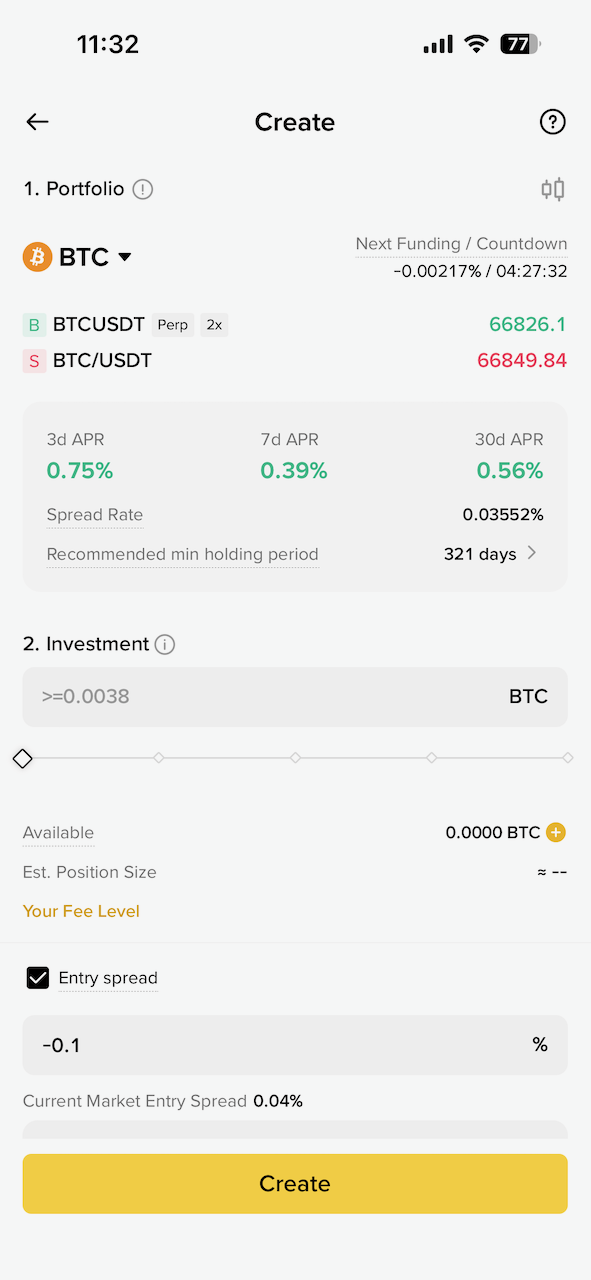

这里的 Arbitrage Bot 就是资金费率套利的 Bot,点开可以看到有很多币种可以选,包括按照资金费率来排序等。而且 Binance 的 Bot 做的很智能,如果资金费率是正的,就开正向的套利策略(使用 USDT),如果资金费率是负的,就开反向的策略(使用代币)。

资金费率套利的获利空间很小,尤其是 BTC 等主流币种,APR 在 1% 以下,当前低迷的市场环境下,大概持有 300 天以上才能磨平手续费损耗。实际上是很不划算的方式。而如果按照资金费率排序,选最高的一个代币,APR 能相对高一点,也许能达到 40% 甚至更多,当然高收益也就意味着高的波动和风险:

资金费率套利是 Detla 中性的,假如代币突然暴涨,把 2 倍的做多合约给爆仓了,会不会导致损失一半本金呢?不会,因为现货涨了 2 倍后卖掉正好抵消了爆仓的损失,所以本金没有变化,整个过程就是赚了这段时间的资金费率。

所以根据资金费率高的代币排序,然后开套利 Bot,是我唯一尝试过想赚点利息的方式。

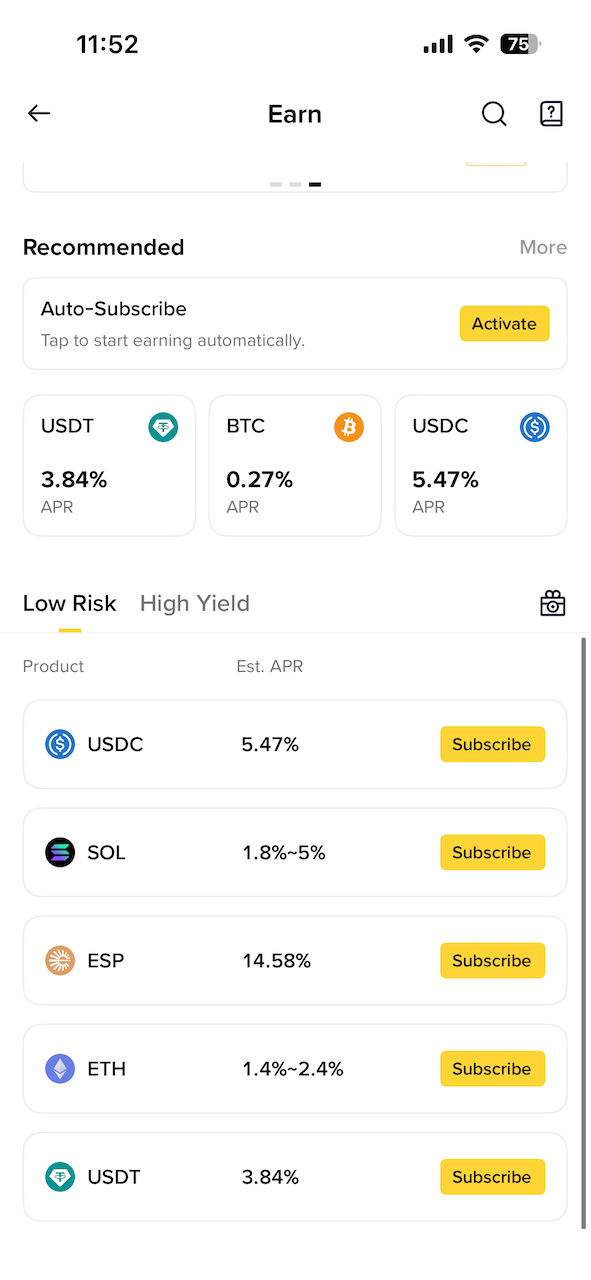

Simple Earn 很简单,存到 Binance 里赚利息。问题在于 APR 并不高,USDC 也就 6%,而且有非常高的额度限制,只支持 200 USDC。几乎没什么用。

双币投资(Dual Investment)的策略整体看下来,关键在于你心里要有一个预期的价位。比如 BTC 到 60000 就愿意买入,无论它以后会不会继续跌,都以 60000 的价格买入(卖出同理)。

双币投资更像是期货交割的逻辑,对于普通散户来说,同样没什么用。为什么双币投资的利息高呢?因为风险也高,有卖飞或者接刀子的风险。风险高,利息就高了。

如果双币投资设定一个非常离谱的价格呢,比如在 100000 的时候买入 BTC,岂不是可以达不到条件一直赚利息了?但实际上利息是由风险决定的,市场看到风险小,也就没有人愿意付高额利息,所以价格离谱的市场本身就不存在。

别作死。

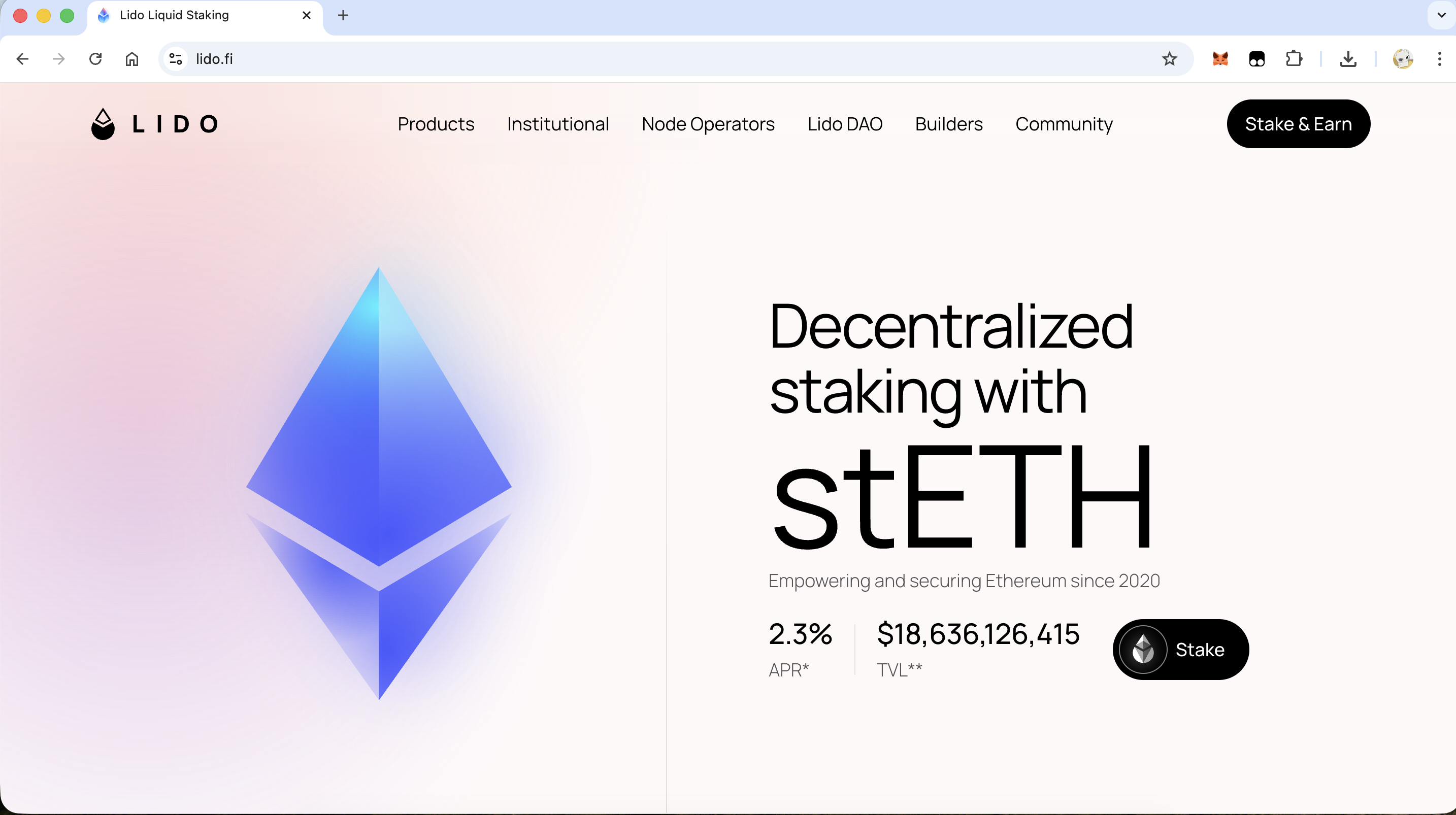

这 2.3% 的 APR 实在是太低了。用某个人的话来说,对于普通人,低于 5% 的 APR 根本不需要考虑,得至少 20 年才能赚钱。

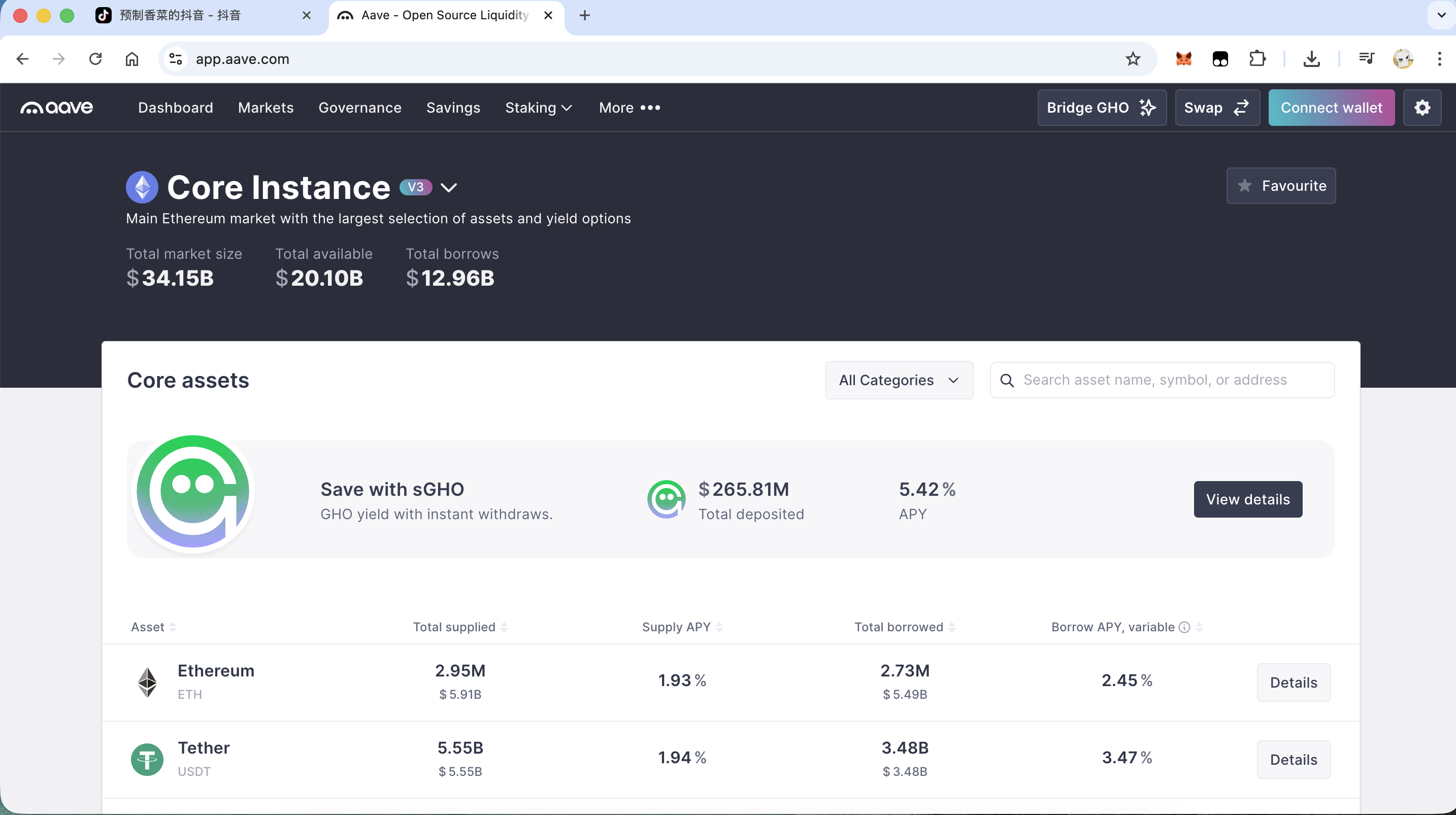

Aave 的 APR 也很低,甚至最高也低于 2%,几乎等于没有。

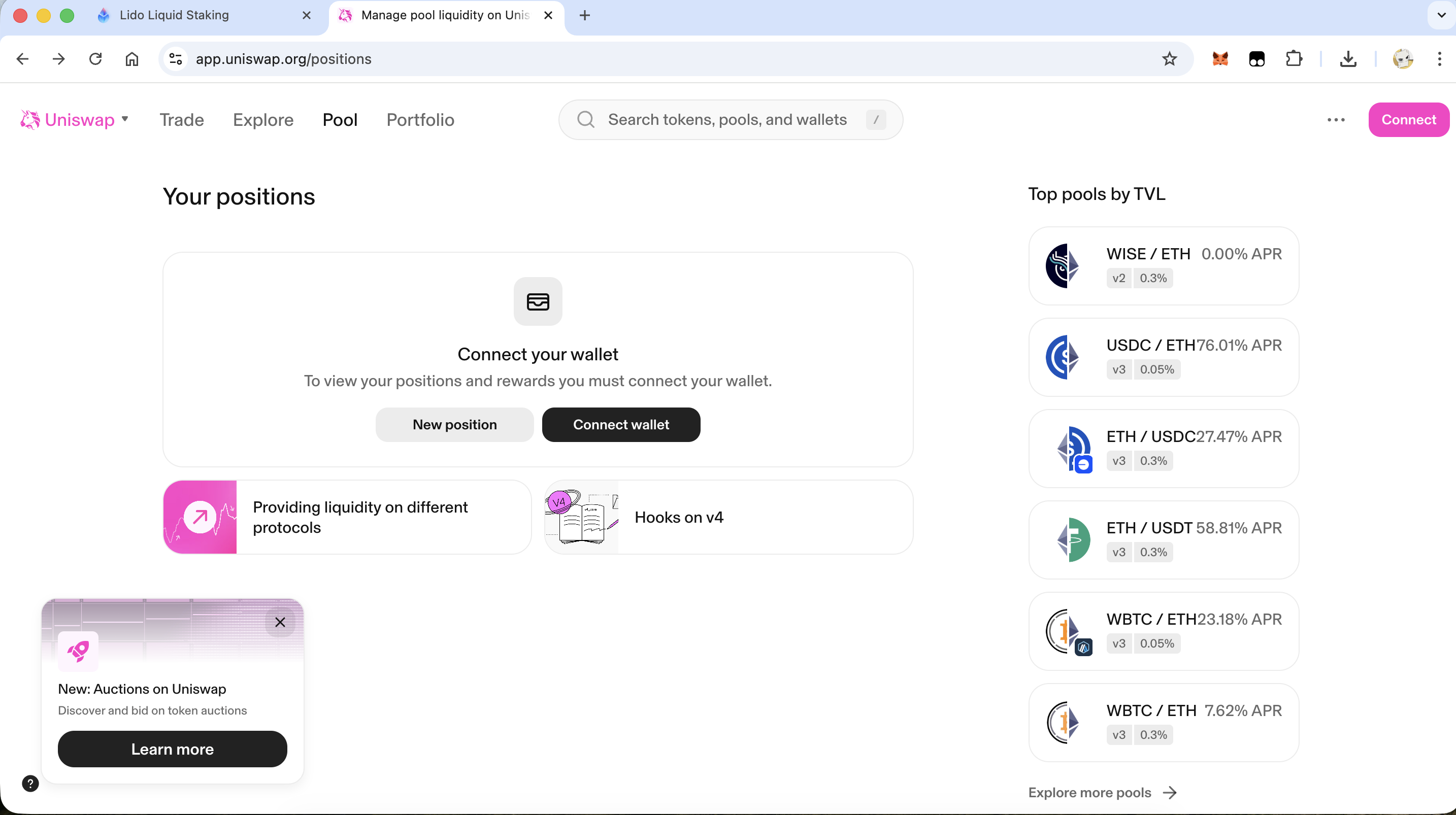

乍一看还挺吓人的,USDC/ETH 有 76% 的 APR。问题在于提供流动性是存在无常损失的,你投入 1000 ETH 和 1000 USDC,随着池子中不断进行交易,最终你提出来可能就剩 300 ETH 和 1700 USDC。代币的总量不变,但是 ETH 的价格在剧烈波动,你的投入就完全不划算了。而 Uniswap 上的稳定币交易对 USDT/USDC 这种池子的收益率自然很低,在 1% 左右。

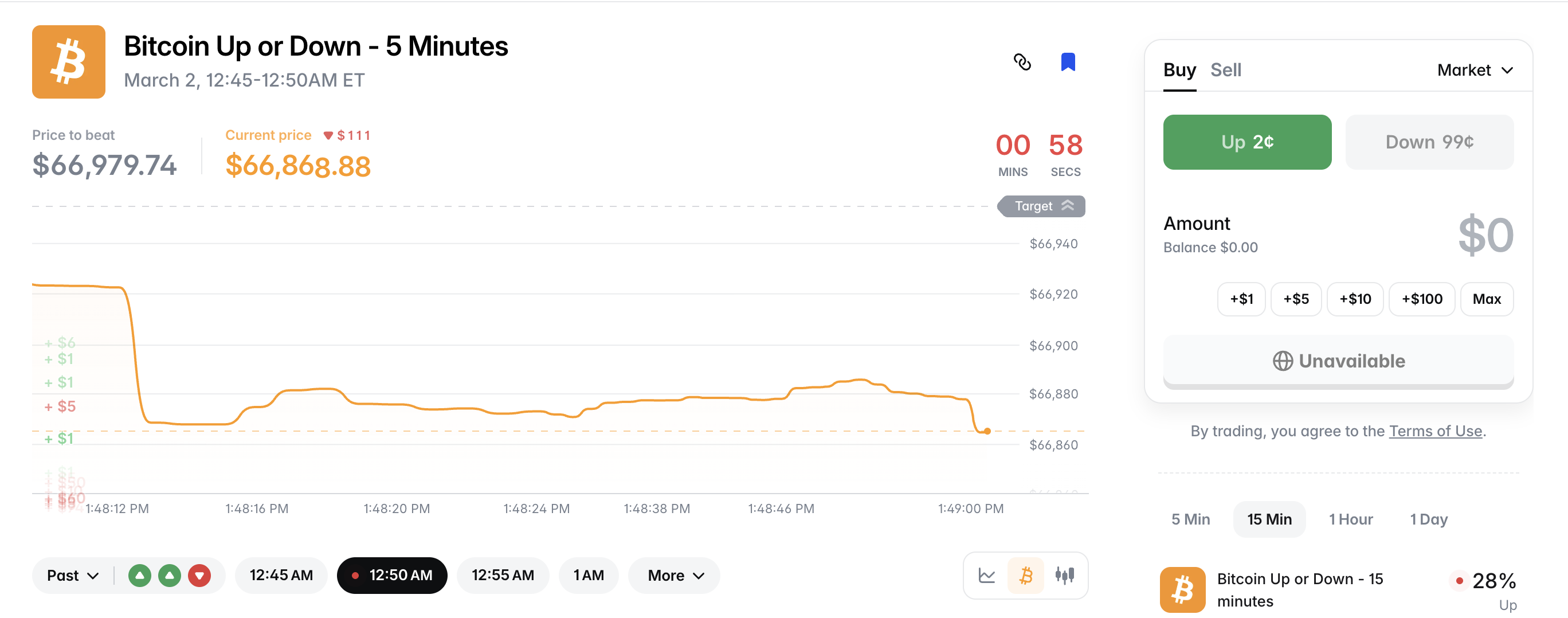

Polymarket 上线了 BTC 5 分钟猜涨跌的玩法。那么在这种市场有获利的机会吗?结论是没有。这是一种负期望值的游戏,散户、低频等同于纯粹的赌博。甚至可以认为所有的事件预测市场都是赌博。别提什么稳定套利的机会了。

一方面,Polymarket 上有一些整活市场,比如 耶稣会不会在 2027 年回归?。这种市场的 no 价格大约 96.2c,意味着如果持仓一年等待事件结算后,持仓的年化收益大约 4%。非要和传统银行以及现金 APR 比的话这个收益率也还不错。

另一方面,Polymarket 有一个机制,对于某些 符合要求 的市场,只要 holding 就会一直分发年化 4% 的 shares。有一些市场是显然知道结局的,所以可以大胆买入,比如某个市场的 no 价格是 91.1c,当事件结算后会获得接近 9% 的年化收益,再累加上 4% 的持仓收益,实际上是一个还算不错的理财选择。

快省省吧。

经过这么多年的发展以及几年前的 DeFi Summer,无论是 Cex 利息还是 DeFi,随着 ETF 的推出、华尔街巨头的介入,只要市场上有低风险的套利机会,就会有几亿的资金以及高频低延迟的机器人入场。普通玩家的机会非常少。

在金融市场里怎么赚钱?

除此之外,别无他法。

散户之所以是韭菜,是因为:

反正什么都没有。有的只有无知,和赚钱的欲望。

李笑来经历过那么多项目,最后总结出的终极交易策略是定投。《定投改变命运》这本书其实写的非常好,信息密度很高。当我们对于某些高频交易策略动心的时候,不妨回顾一下这本书里提到的要点,而定投正是需要极度耐心的一种策略。

当然定投策略以及李笑来的理论,也有让人觉得扯淡的地方。比如书里到最后,给大家的建议是提高 “场外赚钱的能力”。这基本上是非常正确的废话,谁不知道场外赚钱重要……

定投是一种与人性做对抗的策略,确实很难严格落实,尤其是对于从业者来说,天天会看到行情和市场情绪,不可能做到情绪高的时候还定投,也做不到情绪低的时候管得住手。

想要赚钱,还是得做出点别人做不到的事情才行。

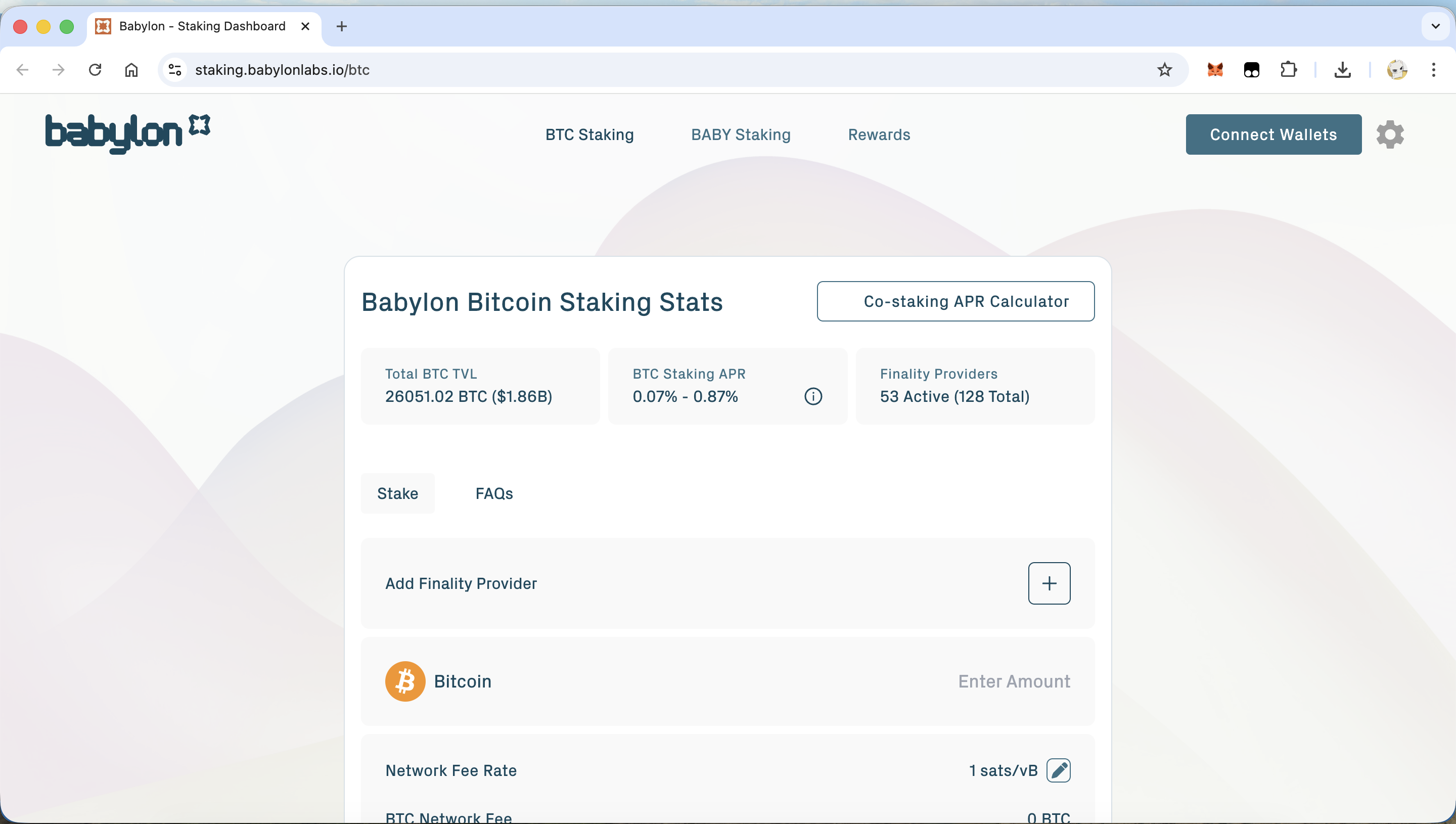

刚才提到了定投,那么假如坚持定投 BTC 的话,BTC Restaking 能不能在持有 BTC 的基础上再赚点利息?

Restaking 赛道唯一一个真正做 BTC Restaking 的项目 Babylon,提供的 APR 至高 0.87%,这确实是不值一提。毕竟 2B 的资金量压在协议里,APR 又不能凭空产生,项目收益再高,一分到 2B 的质押量上,APR 就不可能高了。所以 BTC Restaking 几乎不值得去操作。

我在思考 “场外赚钱” 这个问题。我发现 “定投+持有” 的过程无聊至极。

金融市场里有一个很奇怪的逻辑,明明你就是场外赚钱能力有限,才想要到金融领域通过投资手段寻找高杠杆、高回报率的新机会。而投资界的大佬都会告诉你,场外赚钱的能力才是最重要的,你要有源源不断的现金流才行。

而事实上,金融领域从来只放大资金收益,而不负责基础资金的来源。在金融领域的不可能三角是:

如果你有足够的本金,即使收益率低也有很好的回报,100 万美元年化 10% 一年下来就是 10 万美元。如果你愿意承担极度高的风险,土狗币百倍币就是高收益最直接的渠道,收益率是对承担风险的回报。

那么如果本金也不够大,风险也不愿意承担呢?剩下能投入的只有时间。