2026-05-11 09:38:27

这是 4 月 27 日 Indigo Live 月末直播的完整文字整理。一个半小时的内容,看似在讲过去两个月 AI 的进展,其实是在讲一件更朴素的事:当世界变化得比你想象的更快,你需要校准什么?

校准对 AI 的认知,从「聊天工具」到「代理范式」;校准对自己的定位,从「中间地带」到「双峰的某一侧」;校准对组织的想象,从「层层审批」到「Agent 直接调度」;校准对投资的方向,从「碳基消费」到「硅基消费」;最后,校准对人类自身的信心——重新认领那些 AI 做不到、但只有人类才有的事。

这一期的情绪基调是一个很完整的弧线:先用三藩、西雅图、温哥华这三个城市的现场观察打开焦虑,再用 Dario Amodei 与 Andrej Karpathy 的数据把焦虑实锤化,然后展开模型、Agent、组织、物理世界这四张地图,最后回到 Rick Rubin 那段独白,把整场拉回到品味、判断力与学习的欲望。

如果只能记住一句话,那就是:AI 不是平权工具,它是极端的放大器;AI 是个人的镜子,你想把它用得更好,就得先提升自己。

过去几周,我在美西做了一圈 Meetup 巡回——三藩、西雅图、温哥华,三个城市,三种完全不同的氛围。

三藩的氛围是一句话能概括的:人均 co-founder。我遇到的人,几乎人手一个 side project。哪怕在大公司有正职,也都在偷偷搞副业。这不是什么硅谷文化的浪漫续集,更像是一种集体性的「防裁姿势」——大家心里都清楚,自己这份工作随时可能没。

西雅图给我的感觉就更沉了。来的几乎清一色都是大厂员工,亚马逊、微软、Meta,焦虑感是从言谈之间渗出来的。一个职业天花板看上去再稳的人,现在也会开始问:我这份工作还能撑几年?

温哥华反而是焦虑感最低的。原因不复杂,温哥华的职业构成本来就更多元,不是单一产业拉起来的城市。当一个城市不是「all in 在一件事上」,反而能在变局里更从容。

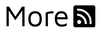

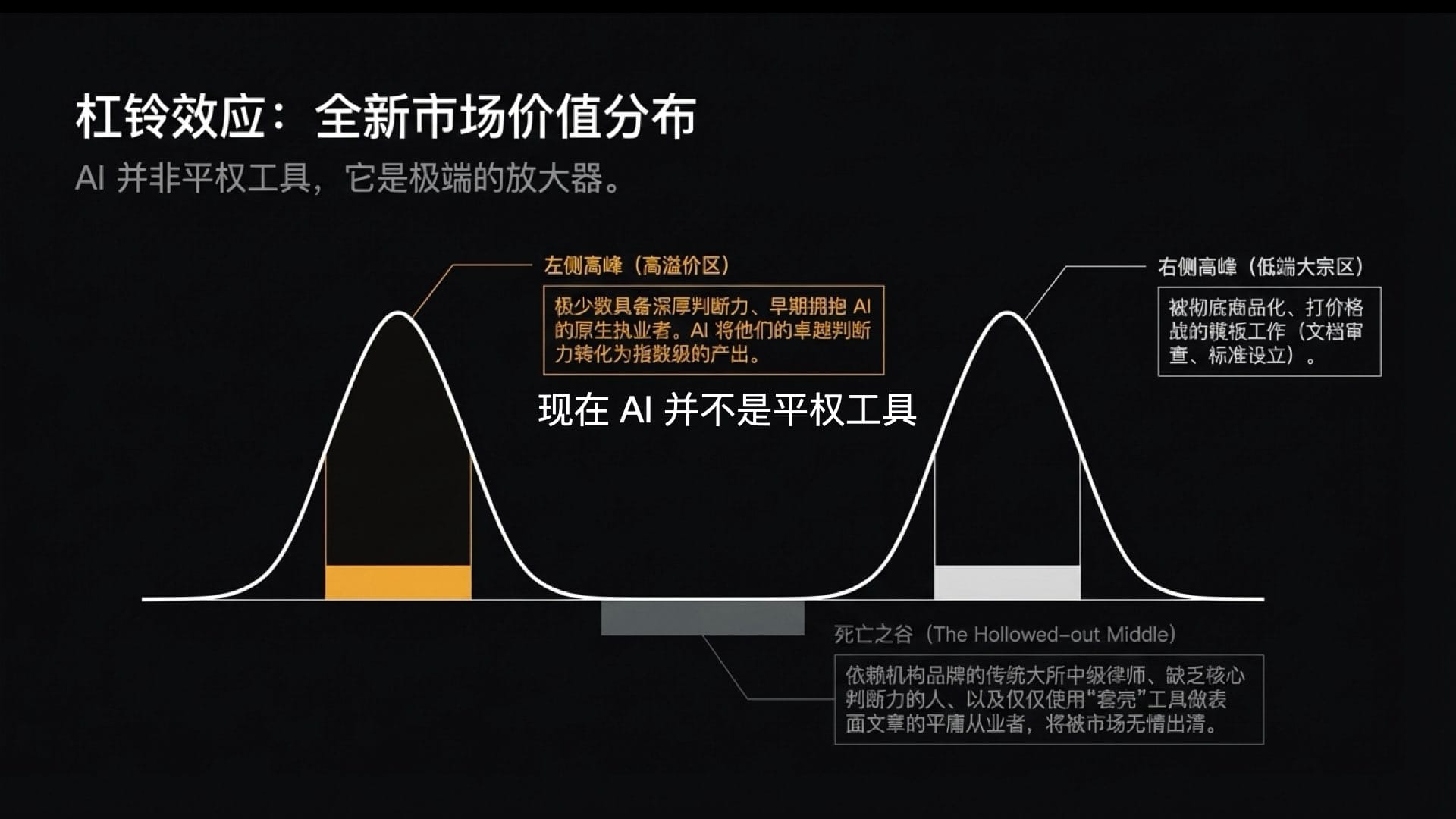

把这三个城市叠在一起,我得到的核心结论是:无论你是做投资、做创业,还是只是为自己的职业发展操心,中间地带都正在快速消失。什么叫中间地带?我做了一张图。

横轴的左侧是「百倍速人类」——一个能熟练驾驭 AI 的人,配上一整套 Agent 与工具栈,效率能到普通人的几十甚至上百倍。这是高溢价区。横轴的右侧是「低端大众区」——很多重复性的、流程化的、信息处理密度不高的工作,被 AI 全自动化,市场价格趋近于零。

而中间,是死亡之谷。中间是过去十几年里我们最熟悉的那种工作:高学历、白领、薪水不错、需要一定专业判断、但本质上是处理结构化信息——金融分析师、咨询顾问、初级律师、初级软件工程师、产品经理、运营、市场……这一层正在被 AI 从下往上、从内向外地吃掉。

AI 不是平权工具,它是极端的放大器。它放大了「会用 AI」和「不会用 AI」之间的差距,也放大了「能调度 AI」和「只能被 AI 替代」之间的差距。

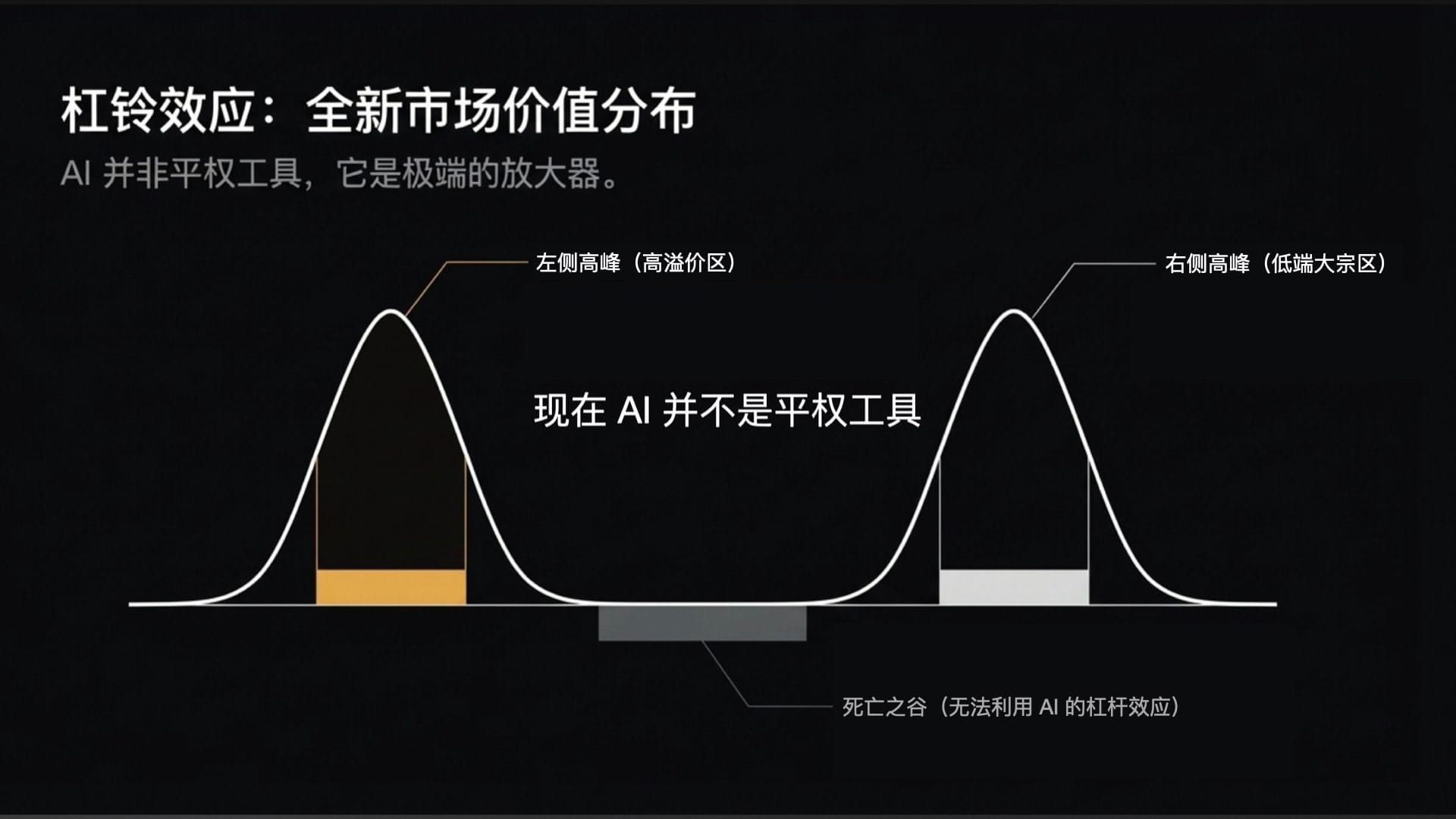

更让人不安的是数据。全球 81 亿人口里,只有 0.3% 的人用过付费 AI 产品,只有 0.04% 的人用过 AI 写代码。万里挑一,这意味着什么?意味着今天看上去已经无处不在的 AI,对绝大多数人来说,连入口都还没找到。

所以我在直播里给了一个相对极端但认真的判断:从 2026 年开始,人类会分化成两种人——前 AI 人类,和 AI 共生人类。这两种人未来五到十年里的处境会完全不同,就像上一代里没学会用智能手机的老人,他们这辈子大概率不会再补上这一课。这是一个非常实在的提醒:AI 是个人的镜子。

你是怎样的人,AI 就反映出什么样的答案。要把 AI 用得更好,就得先把自己变好。

直播这一段我放了 Dario Amodei 最近一段非常耿直的英文采访,差不多两分钟,全场气氛一下子就变了。

Dario 说的话不复杂,但每一句都很扎实:两年前,AI 的水平大概是一个聪明的高中生;现在,已经是一个大学生水平。他用了一个非常具体的对比来描述这个变化——金融、咨询、科技、编程这四个最典型的入门级白领工作,在未来一到五年内,会先被「增强」,然后被「替代」。

1920 到 1930 年代的电力革命。那一次技术革命的副作用,是大量的中产阶层失业,紧接着是大萧条。Dario 没有把话说得很重,但他的意思非常清楚——我们这一次面对的可能是同一种结构性问题,只是规模和速度都更快了。

Dario 用了一句让我印象很深的话:「我们能阻止它,但要现在就行动。但我们没法阻止 AI 这辆车。」翻译过来就是:政策、教育、社会保障这些可以被设计的部分还有窗口期,但 AI 的进化本身已经超出了任何单一国家、单一公司可以拉刹车的范围。

为了不让这件事停留在「专家说说」的层面,我接下来抛了三组数据。

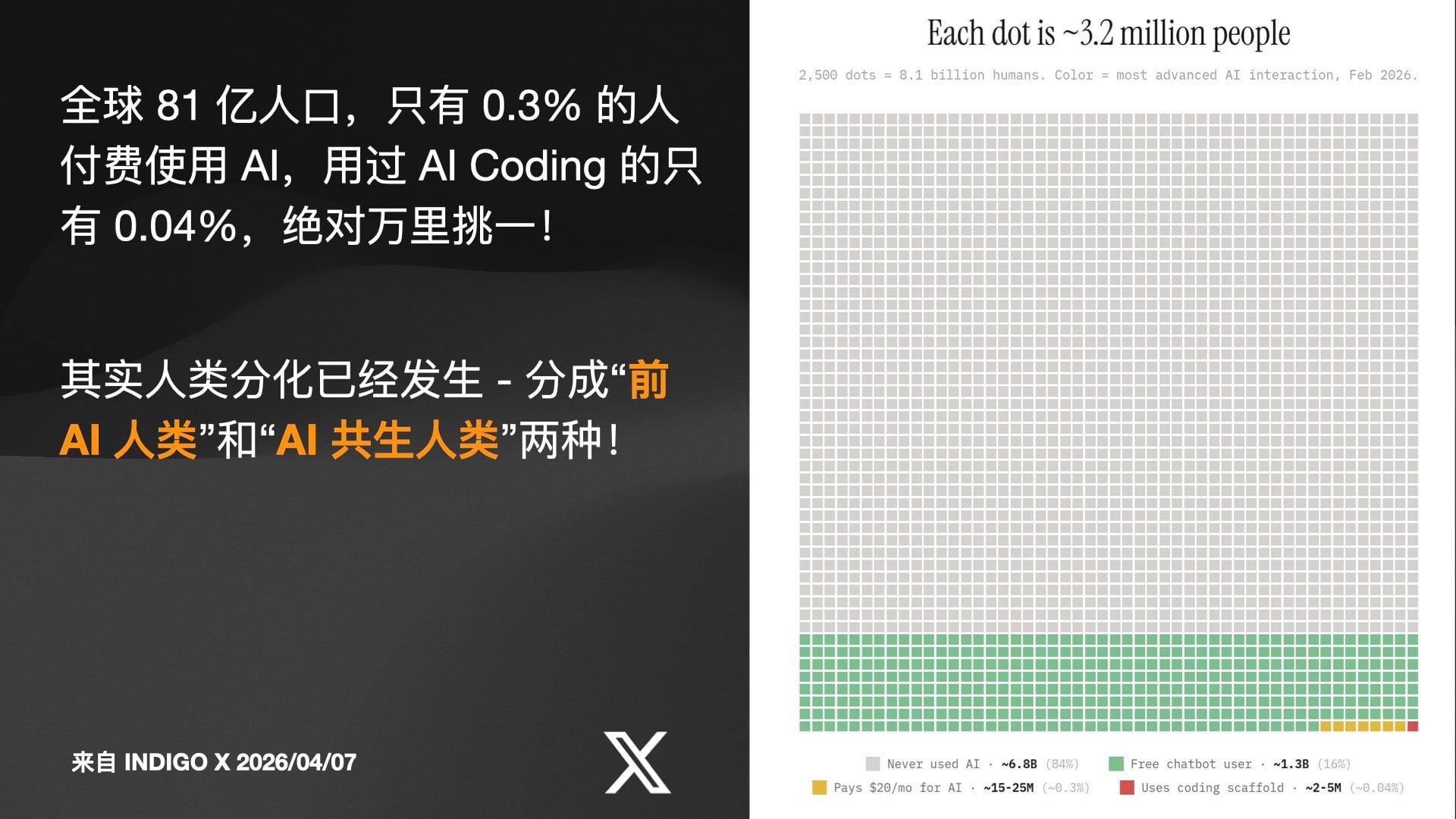

第一组数据来自 Anthropic 三月份发布的 Economic Index。这是 Anthropic 用自己的真实使用数据做的全球第一份「AI 对经济结构影响」的季度报告。结论非常刺眼:AI 直接冲击的是教育水平更高、薪酬更高的白领职业——管理、商务、计算机、建筑工程,全部是高暴露职业。性别和族裔的细分数据更刺眼:女性、亚裔受到的冲击最严重。最关键的一条:22 到 25 岁的年轻人入职高暴露职业的比例,同比下降了 14%。这是一个连贯的信号:企业正在悄悄停止招初级白领。

第二组数据来自 Andrej Karpathy 的一个周末项目。他把美国劳工部公布的 342 个职业分类全部拉出来,给每一个职业打了一个 AI 暴露度评分。Karpathy 的结论用一句话说就是:AI 不是均匀地淘汰每一个工作,它是沿着「信息处理密度」精准打击的。哪些工作信息密度高、可以被语言模型完整 cover?那些工作的暴露度最高。算下来,美国大概有 6000 万岗位在高暴露区,对应大约 3.7 万亿美元的年薪总额。

第三组数据是关于「下一波」的预告。今天我们看到的还只是文字与代码这两条路被打通;等到世界模型、空间智能、机器人这三块再成熟一点——大概一到两年——蓝领劳动里的相当一部分也会进入这条曲线。

把这三组数据叠在一起,结论很清晰:未来五年,劳动力市场会经历一次结构性的重塑。2026 年是这条曲线的第一年,看到 2030 年应该会是一个比较剧烈的转折期。

半导体会把软件的 margin 全部吃掉。

这句话我前两天发过一条视频号,反响很大,争议也不小,所以我在直播里展开讲一下。

传统软件公司的商业模式,本质上是「人 + 软件 + 订阅费」。一家中等体量的 SaaS 公司,雇一堆研发、销售、客户成功,然后按月、按年向客户收钱。过去 20 年,这个模式造就了 Salesforce、Workday、ServiceNow、Adobe 这一串巨头。

但现在这个模式的两端都在塌。

研发端,AI 大幅压缩了「实现一个功能需要多少工程师」这件事。初级程序员岗位实际上已经在消失了,硅谷今年的招聘数据非常直白。高级程序员一到两年内、研究员三年内,也都会被全面自动化——这不是我说的,是 Anthropic 和 OpenAI 自己在公开场合说的。AI Labs 现在最在意的事情之一就是「让 AI 加速 AI 的研发」,这个飞轮一旦转起来,速度会越来越夸张。

销售端,模型公司正在直接绕过 SaaS 这一层。客户原来要的是什么?要的是「一个完成某项工作的解决方案」。SaaS 是把它做成软件卖给你,你雇人来用这个软件。现在 AI Labs 的逻辑是:我直接把「这件工作做完」卖给你,你不需要再雇一堆人来用我的软件。

这就是我说的——卖程序,变成了卖工作。

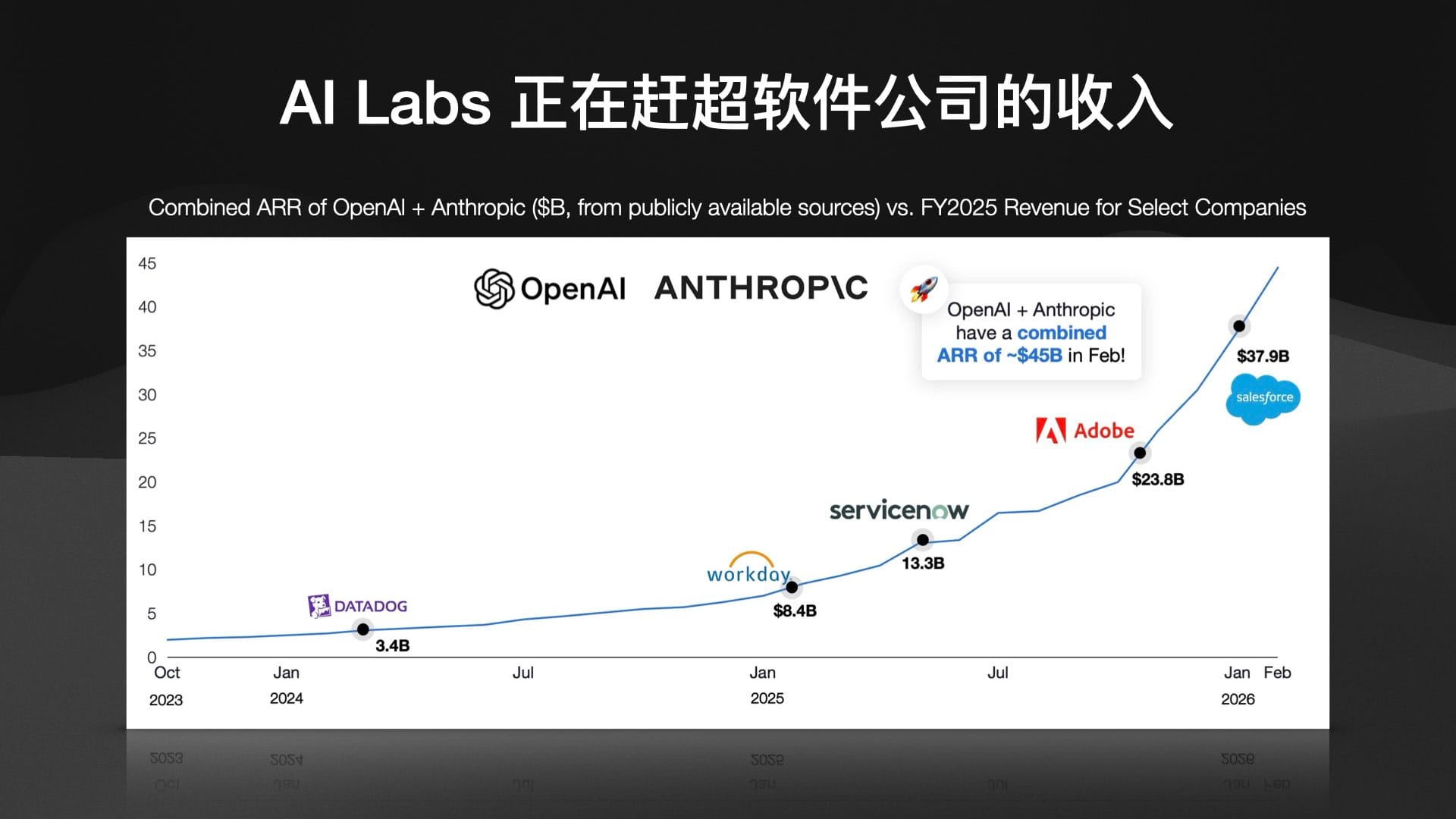

订阅制软件这个市场,全球大概是 2000 亿美金。而「替代人力工作」这个市场,根据多家券商的预测,是 5.5 万亿美金量级。差了 27 倍。这就是为什么这两个月 OpenAI 和 Anthropic 的 ARR(年度经常性收入)会突然像火箭一样往上窜——他们不是在抢 SaaS 的生意,他们是在打开 SaaS 上面那个十几倍大的池子。

我手边有一个具体的数字:今年 2 月,OpenAI 与 Anthropic 加起来的 ARR 已经超过 450 亿美金,直接超过了 Adobe + Salesforce + ServiceNow + Workday 四家加起来。这四家是这一轮股价跌得最狠的四家公司,市场已经把这件事 price in 了——股市看的从来不是当下,是未来。

我也观察到一个更细的现象:模型迭代的节奏在明显加快。Opus 从 4.5 到 4.6 到 4.7,GPT 从 5.3 到 5.4 到 5.5,每一次主版本升级之间的间隔,都在压缩到一到两个月。这背后是 AI Labs 自己在大规模使用自己的模型来做研发——这件事本身就是一种「自我加速」的飞轮。

这一段是这场直播信息密度最高的部分,因为 AI Labs 这两个月的动作实在太多。我快速梳理一下这张能力地图,按公司一家一家来。

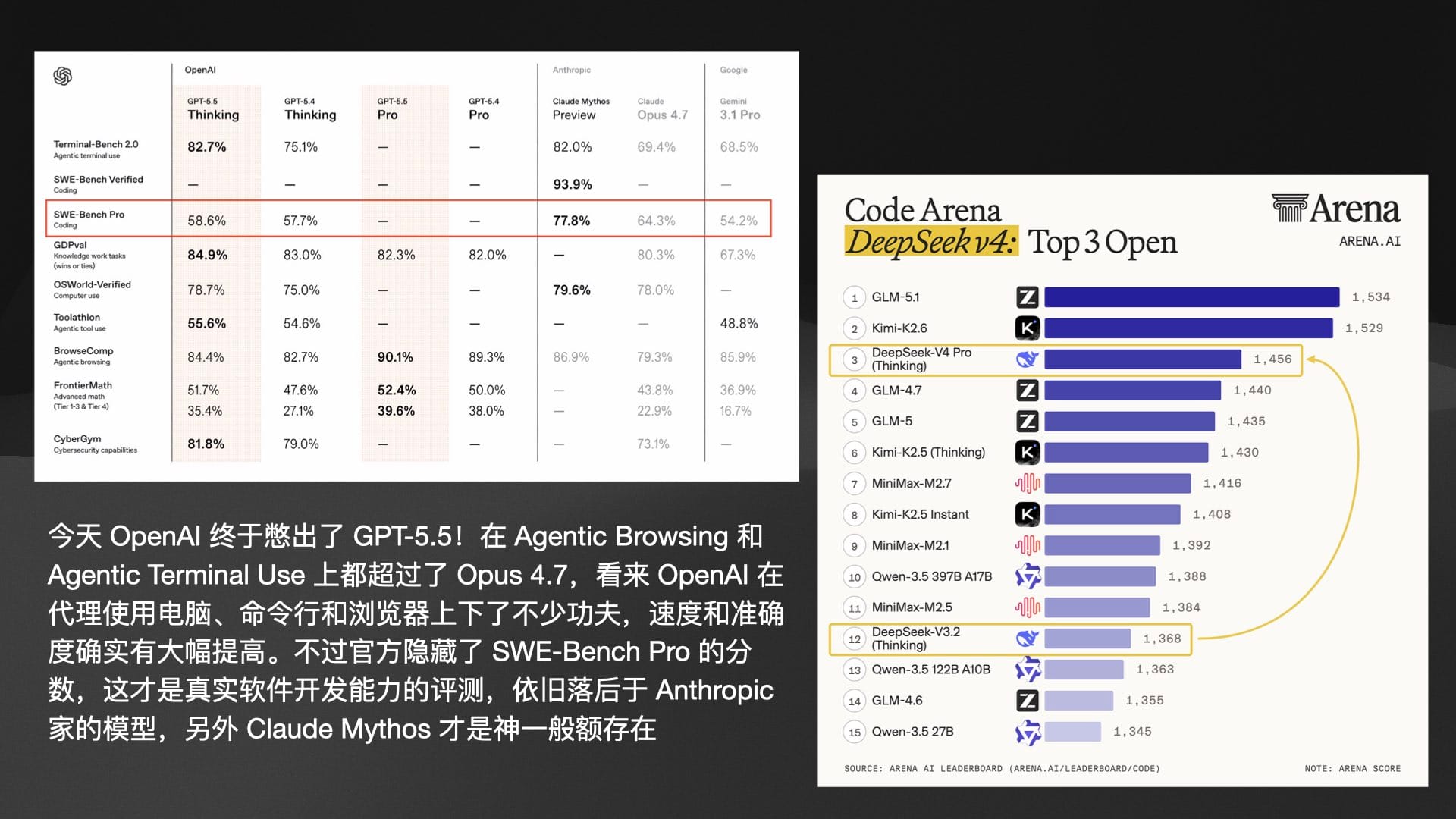

OpenAI 这边,旗舰产品是 GPT 5.5。它在 Agentic Browsing(代理式浏览)和 Terminal Use(终端使用)这两个维度上,反超了同期的 Opus 4.7。不过 OpenAI 这次悄悄隐藏了 SWE-Bench Pro 的成绩——他们没拿到第一就不公布,这是惯例。但 GPT 5.5 的整体感觉是更激进、更好用、也更敢于让 Agent 自己跑。

Anthropic 这边,Opus 4.7 的风格在主流模型里相对独特。它更像一个「伙伴」,回答更短,推理更多,工具调用更克制。它不会主动搜索,需要你刺激它才会去搜——这其实是 Anthropic 在算力不足的现实下做的一种资源保护。前一段时间 Opus 还出过「降智」问题,GPT 5.5 发布当天,Anthropic 紧急修复。

Anthropic 还有一个隐藏的底牌叫 Mythos——内部代号系列衍生模型,没有公开发布,只给约 100 家机构使用,里面包括美国国防部。它的网络漏洞发现能力远超人类防御者,是一个不折不扣的「超级武器」。这件事的隐喻很重:最强的 AI,可能永远不会出现在 ChatGPT 上。

算力压力是真实存在的,前两天 Google 宣布给 Anthropic 追加了 400 亿美金投资——先 100 亿,后 300 亿全部用于采购 GPU。这笔钱不是给 Anthropic 自己花的,是直接拿去买卡的。

Google 这边,Gemini 主版本没更新,但发了 Gemma 4——目前端上小模型里最好的一个。Google 在 on-device(端上推理)这条路上的布局正在显出价值。

xAI(Grok)这边……我直说吧,团队挺乱的。原来的核心创始团队走了一批,Elon 又把 Cursor 的几位核心工程师挖了过去,最后把 xAI 跟 SpaceX 做了合并——这个合并我个人觉得「帮我们解套了」。Grok 的基座不差,但 RL(强化学习)这一块没做好,整体竞争力比起前三家有明显差距。

开源模型这一边,被中国公司霸榜了。智谱 GLM 在代理能力维度上目前是开源最好的,Kimi 第二,DeepSeek 4 这一代表现一般。开源 vs 闭源现在大概有 6 个月的代差——但更关键的代差不在能力,而在「执行力」:闭源公司围绕模型能力做的产品化、工程化、生态建设,速度是开源生态的 10 到 20 倍。

把这五家放在一张表上看,我得出几个判断。

第一,今年年底我们会进入一个 Jensen 在 GTC 上画的那张图说的「AI 自我改进的拐点」——AI 加速 AI 研发的飞轮真正转起来。

第二,接下来两年,我们处在一个类似 2022 年 11 月 ChatGPT 时刻的范式起点。但这一次的范式不是「聊天」,而是「代理」(Agent)。Opus 4.5 / Codex 这一代是这个范式的原点。

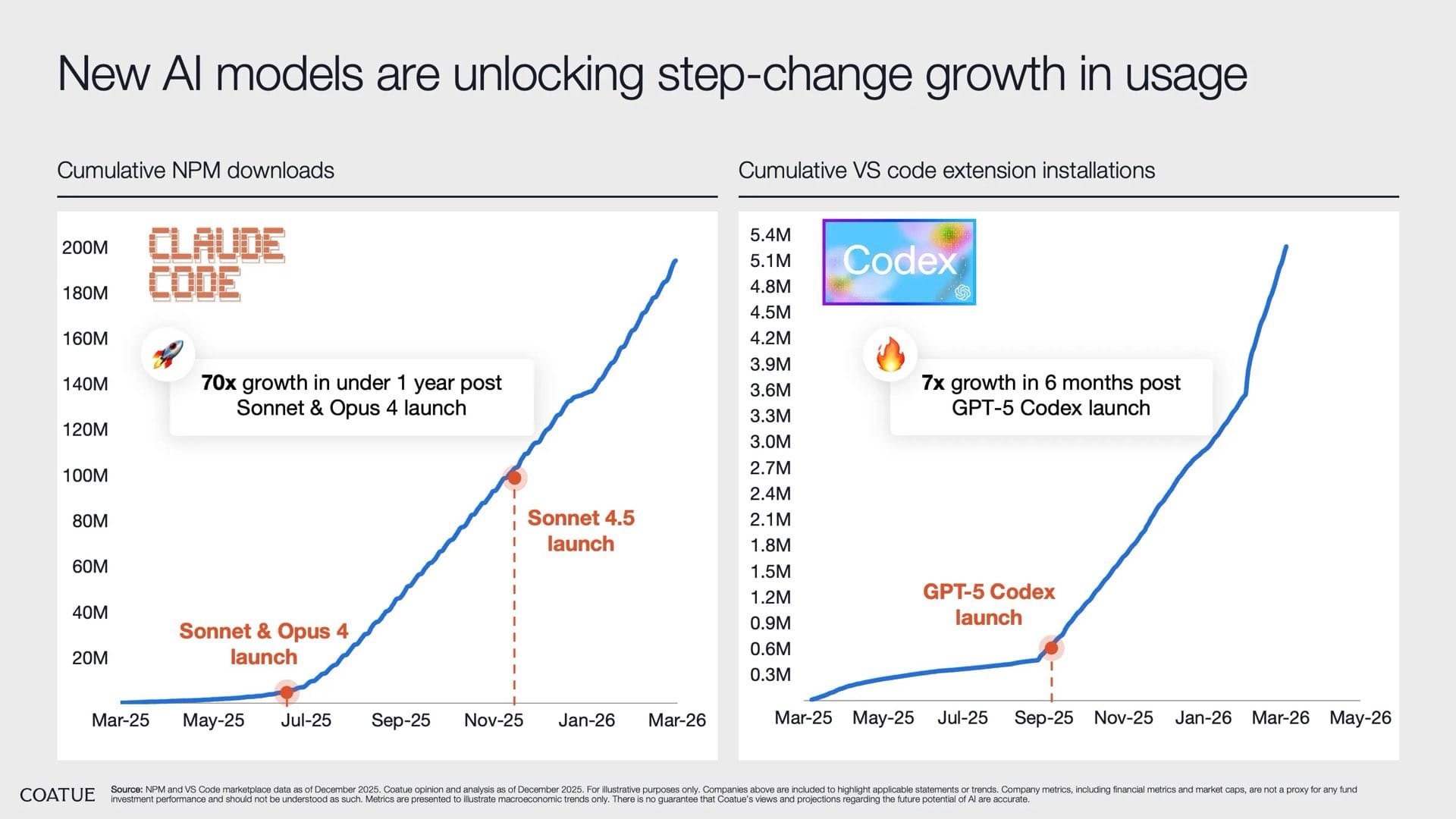

第三,Coding App 是浏览器之外的下一代杀手级应用。如果说大模型是 CPU,那 Coding App 就是它的超级终端。Claude Code 发布后六个月使用量增长了 70 倍,把 Anthropic 的收入预测一下子拉到超过 OpenAI;Codex 也增长了 7 倍。这个增长速度,是过去 SaaS 时代任何一款企业软件都做不到的。

第四,关于算力的过剩问题——很多人担心 AI 公司的算力会过剩,我的判断是:现在多少算力就能吃掉多少算力,这些模型公司哪怕再翻 10 倍,他们也能用完。OpenAI 把 SoraApp 停了,就是为了集中算力优先做 Agent 与编程。这件事反过来证明了算力的稀缺。

我自己也在用 Claude Design 做了一份演讲幻灯片,3 到 5 分钟搞定。这种小事在两年前是不可想象的。这就是「卖工作」这个商业模式的微观体感——你不再为「软件」付钱,你为「这件事完成了」付钱。

在直播的中段,我专门花了一段时间解释一个我认为今年最重要的概念:Agent Harness。「Harness」这个词在英文里的本意是「马鞍」「挽具」——给马套上马鞍,你才能驾驭它。在 AI 这里,它的意思是:给 AI 套上一整套环境,让它能真正去做事。

具体来说,一个完整的 Agent Harness 包含这些东西:

一个沙盒环境(让 AI 安全地执行代码而不会搞乱你的电脑),一个专属的文件系统(让 AI 有自己的工作区),一套长期记忆机制(让 AI 跨 session 记住你和它一起做过的事),一组工具调用接口(让 AI 能调用搜索、代码执行、API 接口、终端命令),还有一套目标管理系统(让 AI 知道当前在做什么、下一步要做什么)。

把这些东西拼起来,你就从「跟 AI 聊天」升级到了「让 AI 替你做事」。这就是为什么 Claude Code、Devin、Codex、OpenClaw 这些产品过去半年使用量爆炸式增长——它们不是更好的 ChatGPT,它们是一种新形态的电脑。

「Harness」这个词目前还没有一个特别好的中文翻译,我暂时用「驾驭 AI」这个说法。但我相信半年内这个词会进入中文圈的日常词汇。直播里我放了 Jensen 在 GTC 上一段四分钟的英文演讲。他说了一句让我反复回味的话:MCP(Model Context Protocol)是 agentic computer 的开源操作系统。

这句话的体感非常深。Windows 让个人电脑成为可能,Linux 让服务器成为可能,HTML 让 Web 成为可能,Kubernetes 让云原生成为可能。每一次新的「连接协议」出现,都对应着一次大规模的产业重构。MCP 就是 Agent 时代的那个连接协议。每家公司,从今年开始,都得有一个 MCP 战略,等价于「Agent 战略」。

Jensen 那句话的最后一句是:Every single SaaS company will become an Agents-as-a-Service company!每一家 SaaS 公司,都将变成一家 Agent-as-a-Service 公司,这是一个产业级的洗牌信号。

Anthropic 已经动手了。他们最新推出的 Managed Agent System,就是给企业客户一整套预配好的 Claude 版 Harness——工具、代码沙盒、Skills、记忆、调度,全都给你配齐,你买的不是 Claude API,是一整套「数字员工的工作环境」。

我经常说:Anthropic 是新时代的 Microsoft + AWS——办公软件 + 设计软件 + 云基础设施一体。这话听上去夸张,但越往后看越准。

我自己的桌上现在常年开着两台 Mac mini,一台跑 Claude Code,一台跑 OpenClaw(小龙虾)。这就是我个人的 Harness——我的私人服务器,去哪都能用。这是一个很有意思的体验:你不再被电脑这个物理实体绑定,你被绑定在「你和你的 Agent 之间的关系」上。

围绕 Agent,会出现整整一层全新的基础设施。在个人这一侧,移动终端会重新洗牌——OpenAI 想做手机,但我判断苹果在 6 月发布的新 Siri 反而会更强。新 Siri 不是过去那个语音助手,它是一个跨应用推理、屏幕感知、独立界面、可挂接不同模型的真正 AI Agent。iOS + macOS + Apple Hardware 整体就是一个巨型的、已经分发到全球十几亿人手中的 Agent Harness。苹果是直接一步到位搬到了最前端。

在企业这一侧,Cloudflare、Vercel 这种 Agent Vendor 在快速演化;私有部署、数字员工、Agent 编排平台,都会在未来一两年里出现一批新巨头。

苹果 9 月会换新 CEO,我对苹果的下一阶段还是有所期待。

但 Agent 的真正威力,不在于让每个员工配一个小助手,那只是 Copilot 时代的故事,那个故事其实没改组织结构。

AI 真正的潜力,是重构组织的底层运作逻辑。

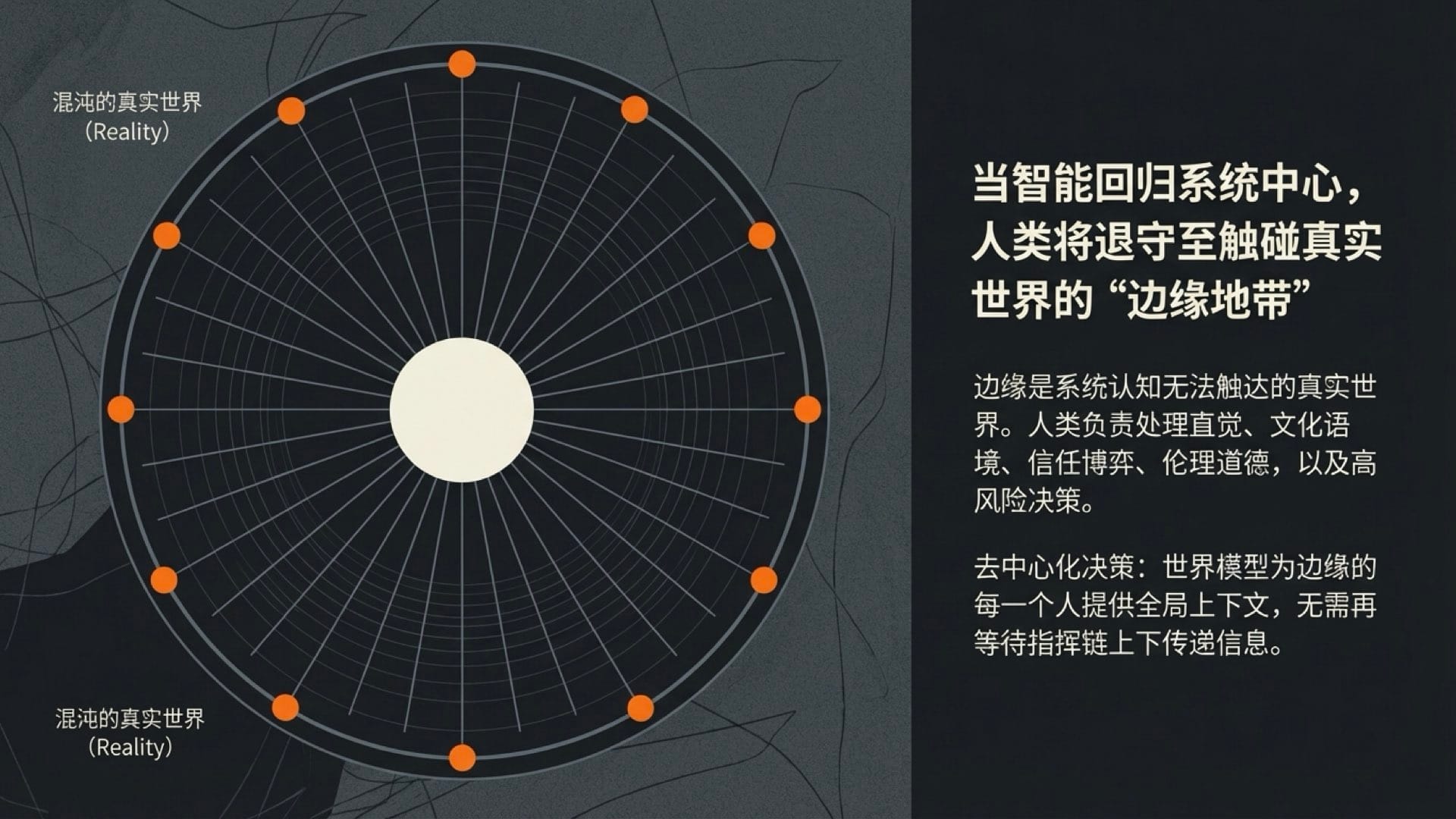

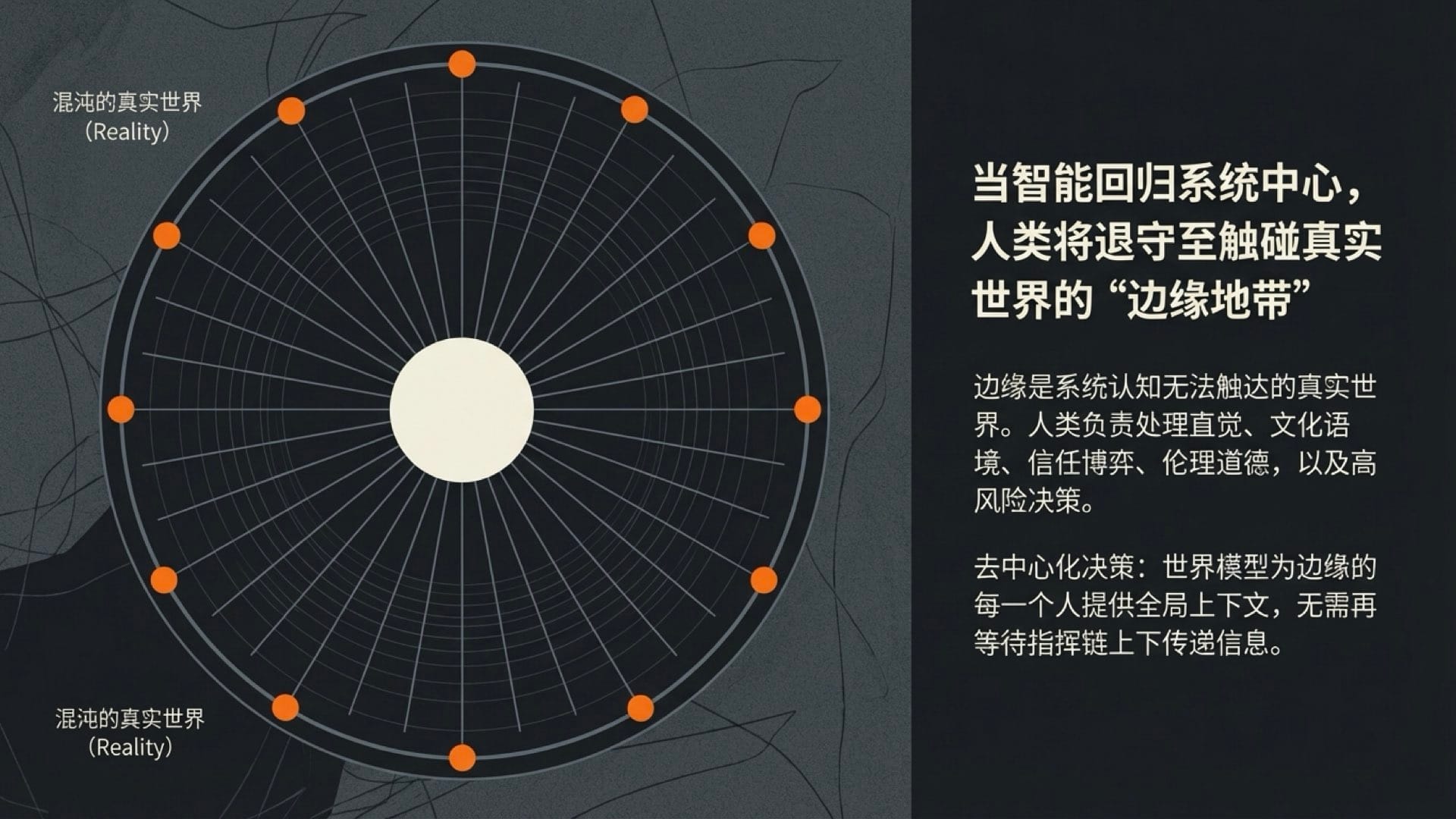

我把这种新的组织形态叫做 Mini AGI。它的样子是这样的:CEO 直接对一个中央 Agent 系统下指令「我要这件事在两周内做完」。中央 Agent 把这个任务拆解,分发给一群专业的子 Agent,子 Agent 再把那些只有人类能做的边缘任务,比如线下沟通、签合同、面对面拜访客户,派给人类去做。中间管理层,几乎全部消失。我们已经能在硅谷的几家公司里看到了雏形。

Facebook 现在在做的事情就是这个雏形的一种——小扎正在用一套系统监控员工的一举一动。表面上看是控制感问题,本质上是「边缘的人类员工 + 中间的 AI 调度」这种新组织形态的过渡形态。

更前沿的例子在军事领域。美军用 Palantir 的 Agent 中央系统洞察全局,每个士兵直接由系统调用——在军事层面上的管理已经是没有中间层了。这件事过去是科幻片的设定,现在已经在伊拉克、乌克兰、印太的多个战区里跑起来了。

在这种新组织形态里,公司本身变成了可 Fork 的代码。一家公司的运作 = 一份 context(公司的世界模型 + 客户的世界模型 + 调度规则)。理论上,你把这份 context 拷走,就复制了这家公司。这件事一旦成立,对组织、对管理、对竞争都是颠覆性的。

我们现在还缺一样东西——IDE for Agent。开发者用 IDE 来写代码,但「管理一群 Agent」这件事还没有一个像 IDE 那样成熟的工具。今年下半年,应该会有几家公司开始做这件事。

这套未来组织形态最让我兴奋的一句话是:未来甚至 CEO 都不需要。你只需要董事会,找一个 Agent CEO 给他设 OKR,他自己指挥下面的 Agent 和人类。听上去很激进,但你只要把这条逻辑往前推,就会看到一个非常清晰的未来。

那么人类呢?人类回到了哪里?

回到了系统的边缘。人类负责处理直觉、语言文化、信任、博弈、伦理、道德,还有各种高风险决策。人类做去中心化的判断,并把这些判断反馈给中央 Agent。Agent 负责执行、规模化、复制;人类负责感受、方向、判断。

这就是为什么硅谷今年这么焦虑——研究员们意识到,他们正在发明一种会淘汰自己的技术。这是一种非常奇特的存在感:在自己挖坟,但又停不下来。

但我想说的是,这件事的另一面是机会。在这个新组织形态里,未来人类要干的,是更有人感的事情。

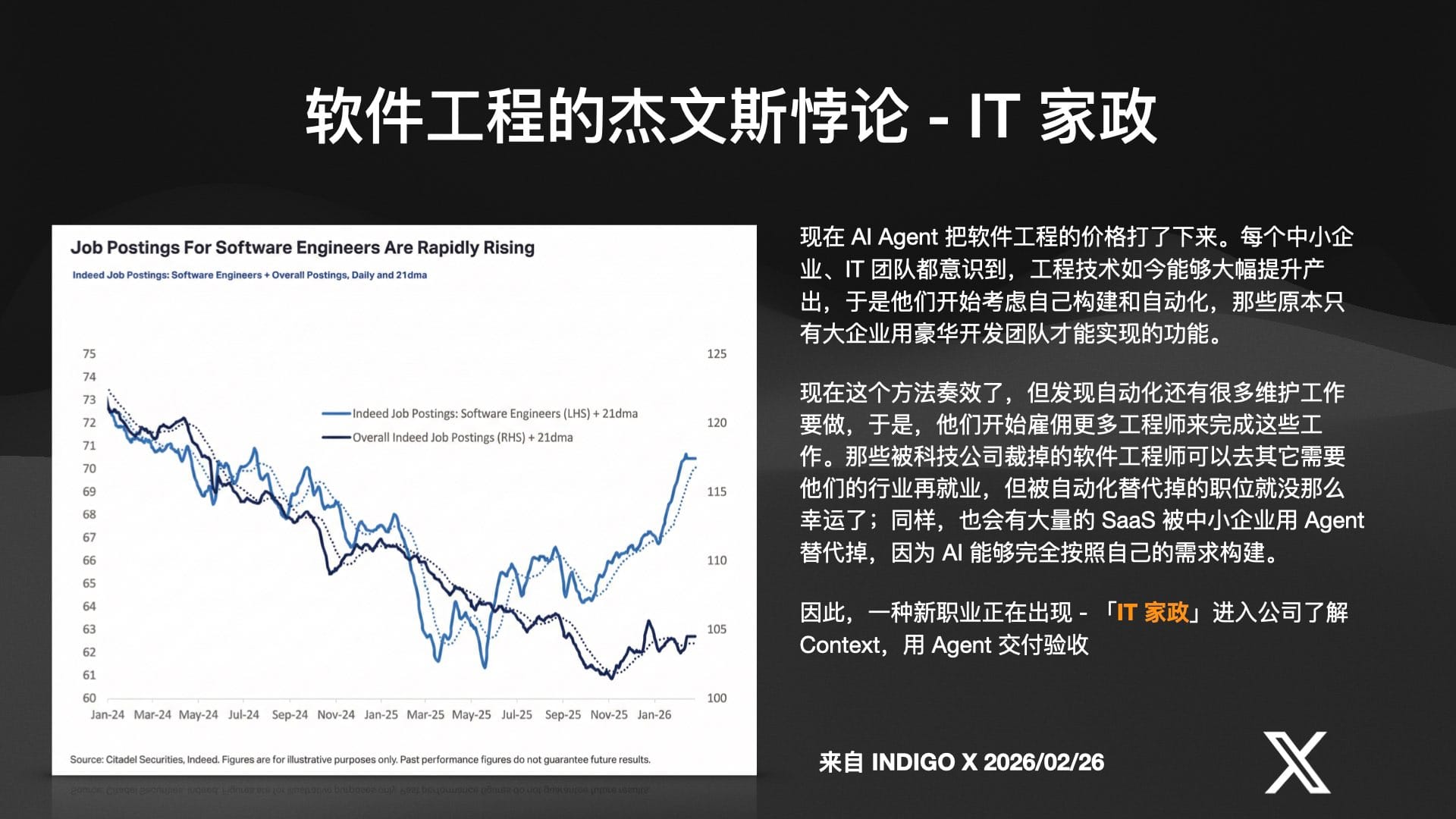

这是一种听上去很温柔的转变。杰文斯悖论在 AI 时代会再演一次——AI 把工程师的「单位价格」打下来,更多原本雇不起工程师的中小企业反而开始大规模雇工程师。我观察到一个新职业正在湾区兴起:「IT 家政」——这些人进入一家公司,理解 context,用 Agent 交付源代码,然后离开。这是 Palantir 当年 FDE(Forward Deployed Engineer)模式的进化版。这个职业大概有五年左右的窗口期,五年之后,连这部分也会被 Agent 学会。

真正在推动「物理世界 AI」的,全世界只有 Tesla 一家公司。

其他人都在说,只有他们在做。Tesla 这一季度的财报里有几个关键数字:汽车毛利率 19.2%,创新高;FSD 订阅 130 万,全美 Tesla 车主大约 400 多万,FSD 渗透率超过 30%。但股价反而跌了,原因是 Elon 公布了一个 250 亿美金的投入计划——造芯片、扩工厂、建 TerraFab。

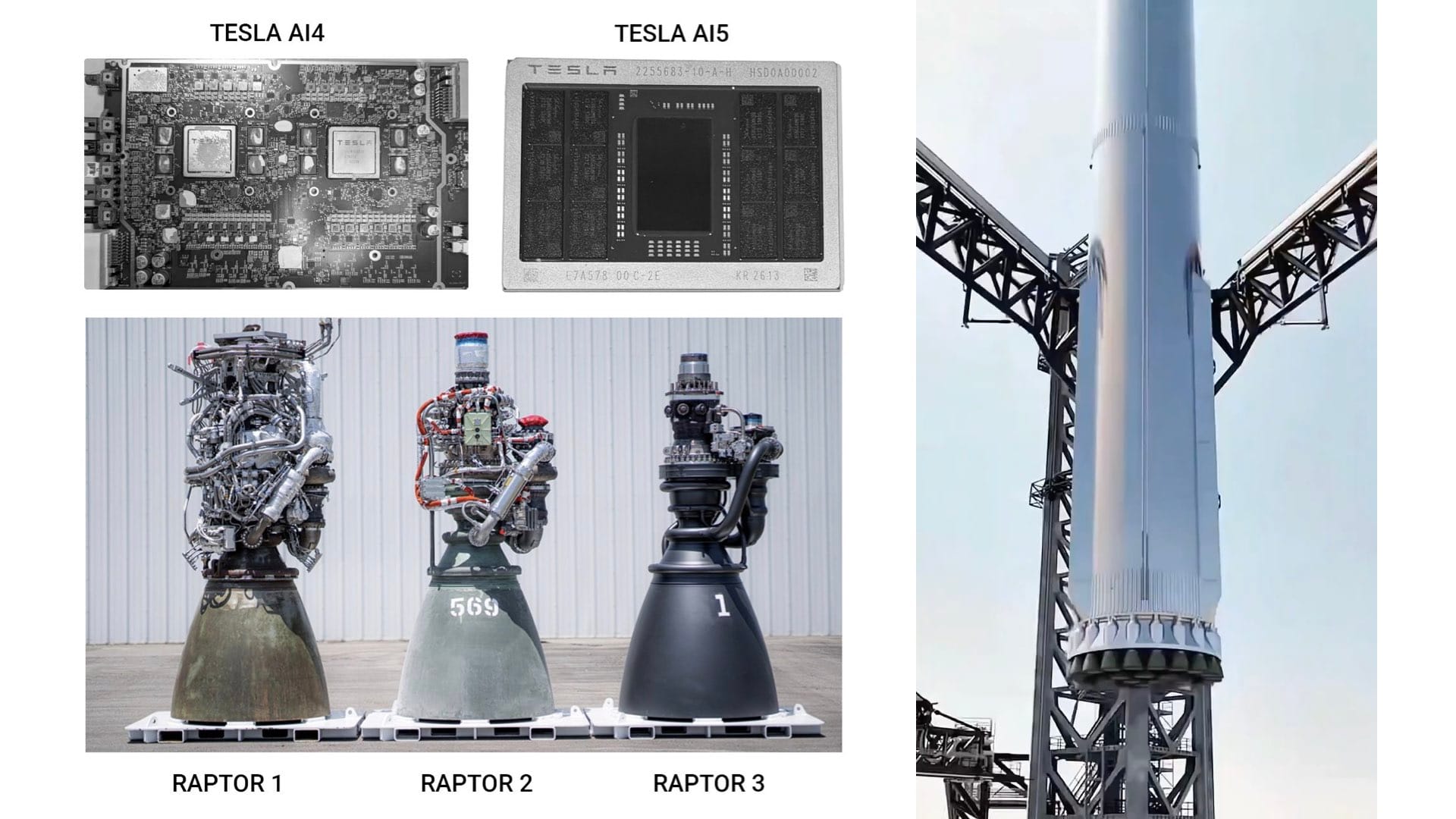

Tesla 现在的路线图是一张紧凑的计划表:Optimus 年中量产但不放量(防抄袭),Robotaxi 年内在 10 多个州运行,AI5 芯片用在 Optimus 和数据中心上,TerraFab 与 Intel 合作。每一项都是几十亿、几百亿美金量级的投入。

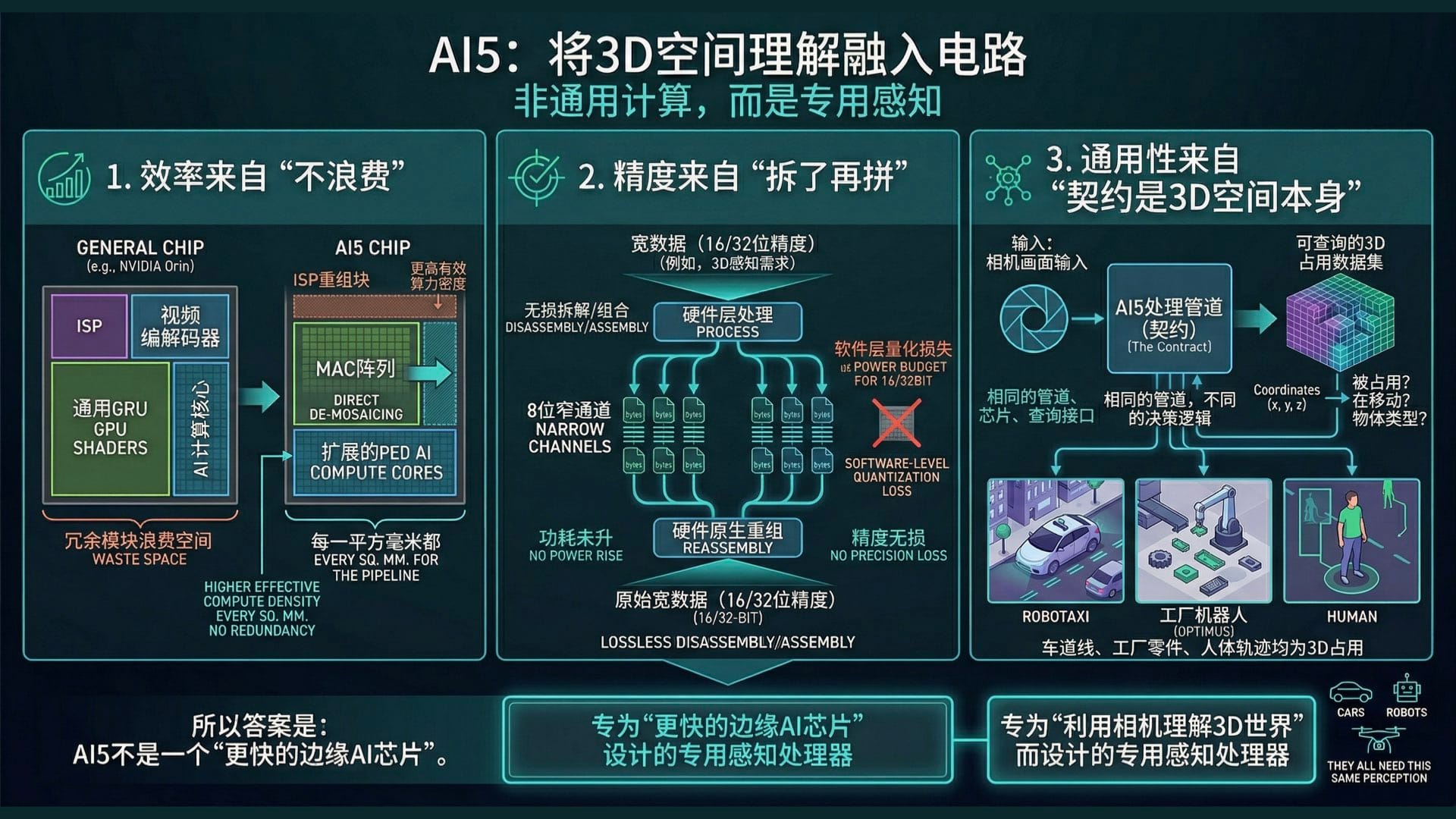

我重点科普一下 AI5 芯片。这块芯片的核心创新是:把 3D 空间感知的神经网络直接做进电路。过去这件事是用软件实现的,用通用的 GPU 来跑空间感知的算法。AI5 不是这样,它把空间感知做成了硬件,用更低的精度(INT8)和八位载通道实现极高的能效比。

这块芯片在体感上像什么?像人类的小脑。人类的小脑就是处理身体在 3D 空间里的运动协调的,它不是在思考抽象问题,它是在做一种结构化、低精度、高频率的感知与控制。AI5 的角色就是这个:边缘 AI 运行的 3D 空间感知专用芯片。它的设计思路与苹果 M 系列类似(垂直整合、专用化),但 Tesla 是第一家专门为「边缘机器人」设计这种芯片的公司。

另一个让我兴奋的是 Optimus 灵巧手——这两周刚公布了专利。这只手不是电机驱动的,是肌腱驱动——把电机做成像手的肌腱一样,绑在手上来拉动手指。这是一个仿生学设计,不是过去那种夹子式抓取器。为什么手这么重要?

我在直播里讲了一个很基础但容易被忽略的知识——人类脊椎下来的运动神经,大约 70% 都给手用。手是处理信息量最大、给大脑负担最大的部位。换句话说,要做好人形机器人,最难的不是身体,是手。

我用了一个比喻:你如果让猴子在舞台上跳舞,最难的不是舞台问题,是猴子的问题。要做好人形机器人,先把手解决掉,舞台不是问题。

至于 SpaceX——五月份装配 Raptor 3 发动机的新 Starship V3 就要试射了。Elon 在物理世界的终极目标其实很清楚:1 兆瓦级别的太空发电、每年向轨道发射 1000 万吨物质、数十亿计的机器人在地表与轨道工作。

Tesla / SpaceX 这一对的最妙之处,在它们之间有一个共同的中间件:太空算力卫星(D3 芯片)。横向的太阳能接收板加散热器,专为高能粒子和极温差环境设计。逻辑很简单——地面盖数据中心有人类矛盾和政府审批,往天上打又安全又快又好。这件事一旦做成,「在哪盖数据中心」这个产业问题会被重新定义。

还有一件事一定要提:TerraFab。Tesla 在德州、与 Intel 合作的巨型晶圆厂,目标是把光刻、研磨、制造、测试一体化——像改进软件一样改进芯片。

这是 Tesla 的「全栈控制」逻辑的最后一块拼图。我的判断是:未来所有科技巨头都得自己控制芯片产能。硬件 + 算力 + 模型 + 应用 = everything。把任何一层交出去,都会在五年后变成战略性问题。

这一段我把投资视角的最近思考一次性讲清楚了。

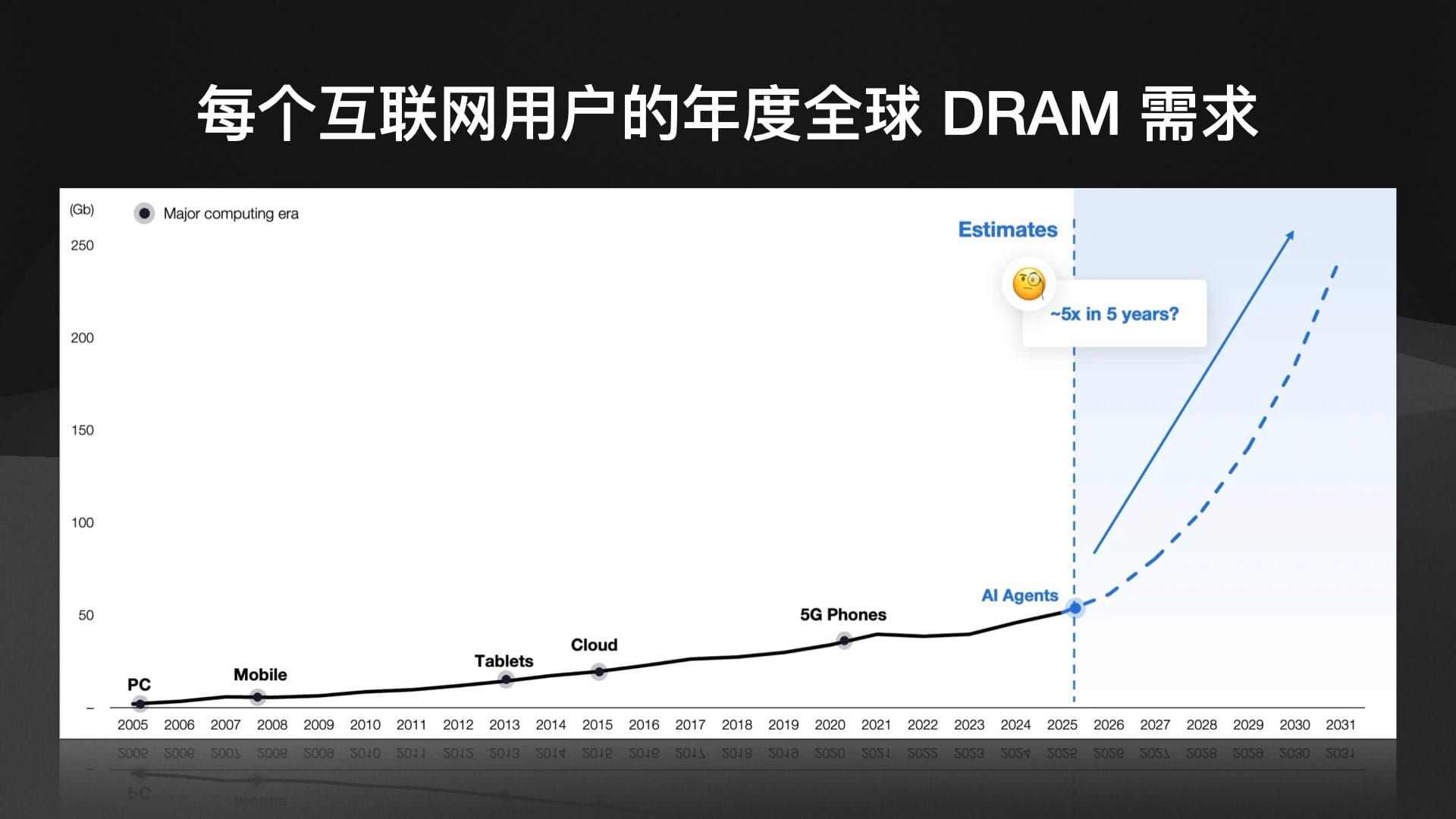

先说一组宏观数据。DRAM / HBM(高性能内存)正在严重短缺——你拿一张 NVIDIA 的卡拆开看,里面除了 GPU,剩下的几乎全是高性能内存条。未来五年,DRAM 的需求会有 5 倍量级的增长,HBM 是这一波增长里最贵、最稀缺的部分。这不是周期性短缺,是结构性短缺。

我从 2023 年就开始反复念叨一句话——今天再念一次,因为这两年它一次都没错过:这个时代,投资远离碳基消费,只投硅基消费。

什么意思?人口不增长,碳基消费天然有上限。一个人一天吃三顿饭,再怎么 GDP 增长也吃不到第四顿。但硅基消费——算力、Token、模型推理——是指数级增长的。一个 Agent 的「胃口」可以在几个月里翻 10 倍、100 倍。算力的需求曲线和人口无关,只和智能的扩张速度有关。

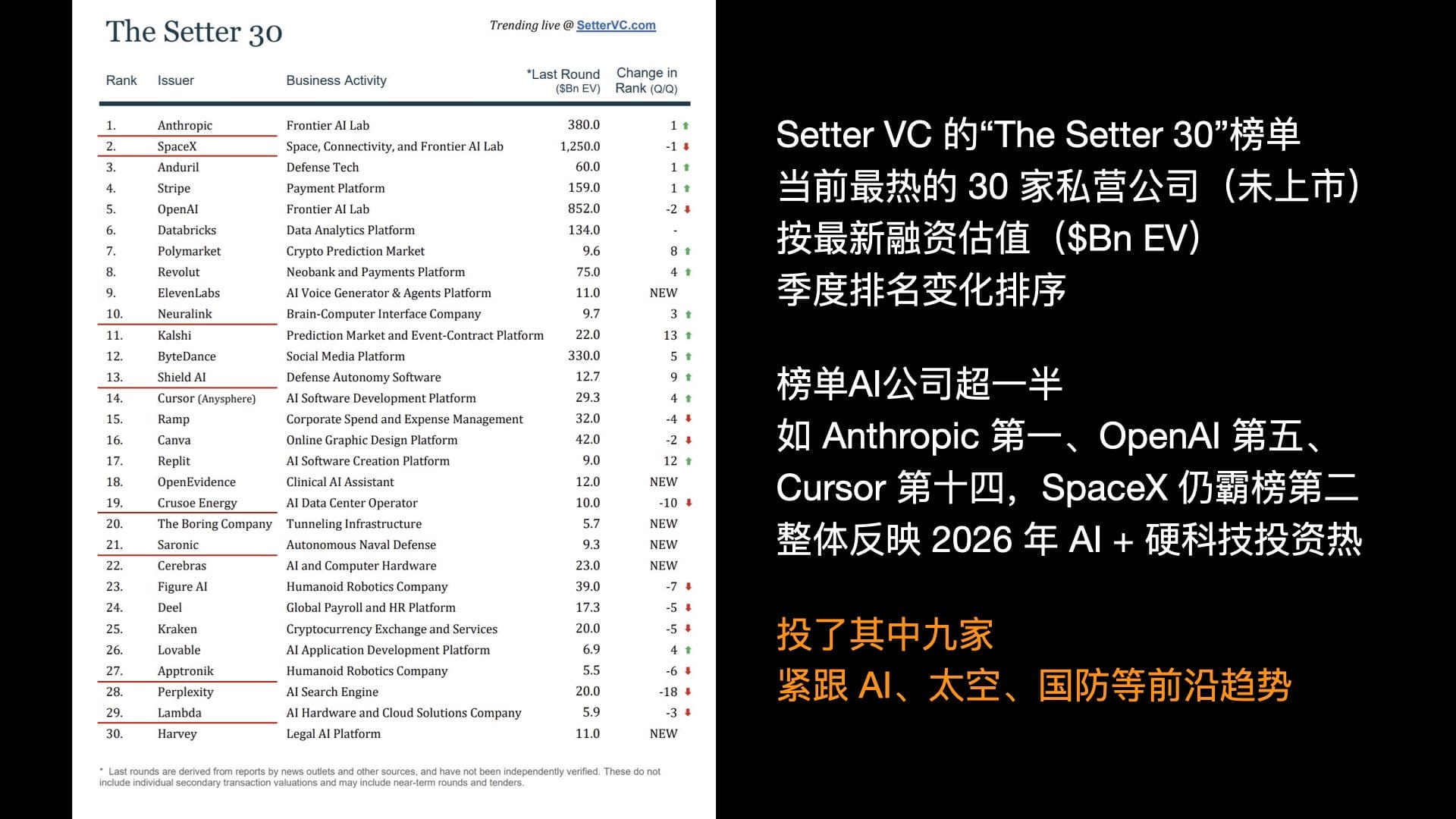

这条原则把我过去几年的投资标的捋得很清楚——为什么我们的基金把超过 70% 的仓位都放在了 AI 模型、AI 基础设施、太空、国防这几条线上。

一级市场的最新数据来自 Sutter(一个比较有名的市场榜单):今年和明年最热门的 5 个赛道分别是——模型 AI 公司、太空、国防、AI 应用、FinTech。今年下半年到明年上半年,会有一波非常密集的 IPO 潮。

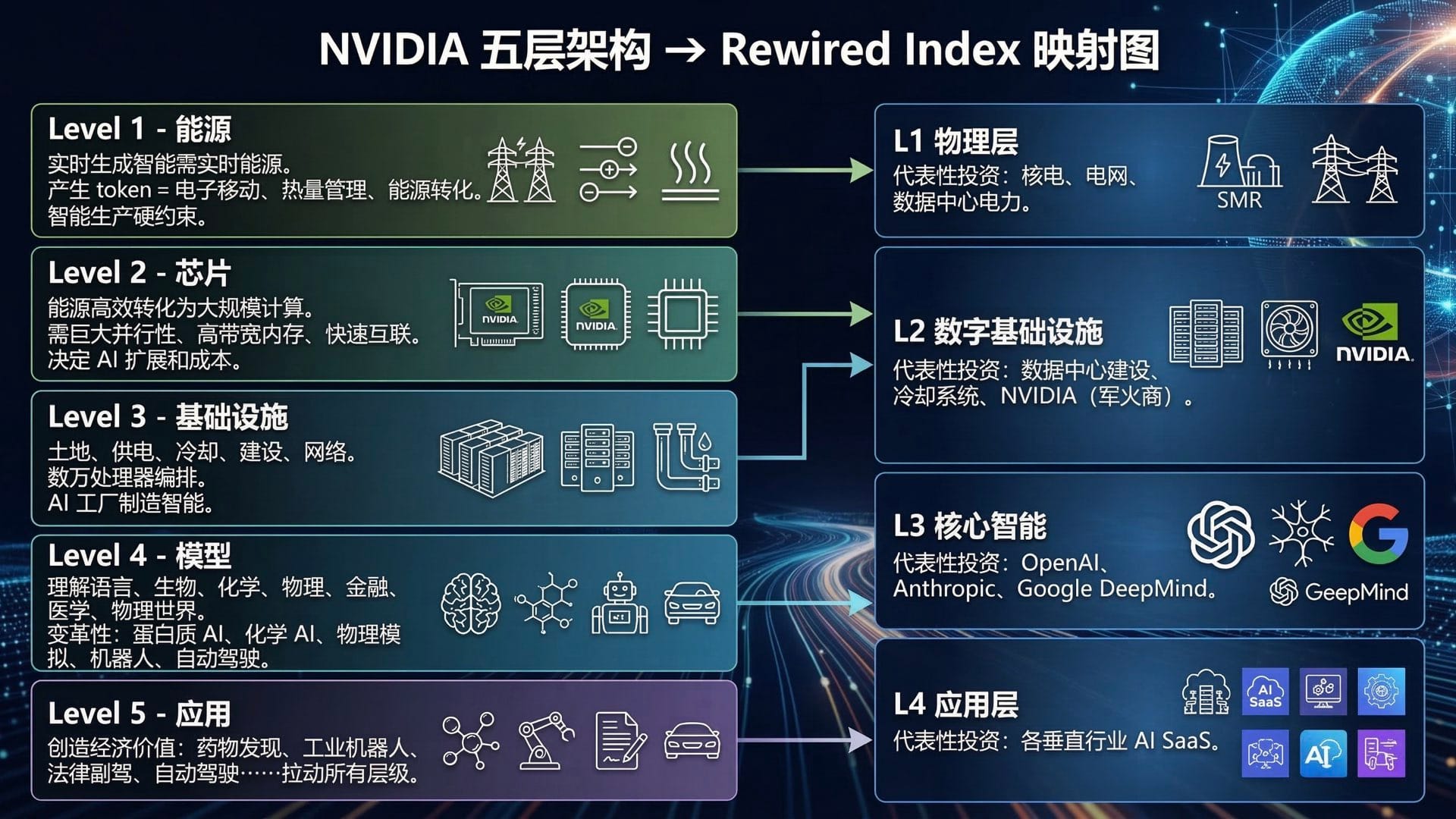

我自己整理了一套我叫做 Rewired Index 五层架构 的投资框架,对应的是 Jensen 在 GTC 那张五层图,但用我自己的语言重新组织过:

最底层是物理层——电力、矿产、稀土、土地。这是 AI 所有上层建筑的基座,过去十年被严重低估的一层。

往上一层是数字基础层——数据中心、Stablecoin、金融数据网络。这一层是「数字世界的水电煤」。

再往上是核心智能层——OpenAI、Anthropic、Google DeepMind、Tesla、NVIDIA。这就是我反复说的「卖最贵 Token」的那五家。

最上面是应用层——所有「转卖 Token」的公司。

我前两天发了一个帖子说得更直接:AI 应用里只有两种商业模式——卖 Token 和转卖 Token。模型公司卖最贵的 Token(且永远不会降价,因为永远会有「最好的下一代模型」继续卖最贵价格);应用公司的本质就是「把 1 块买回来的模型变成 10 块卖出去」——卖的不是软件,是交付物。

如果你做应用,你要问自己一个问题:我转卖 Token 的「加价空间」在哪里?是品味?是 context?是分发渠道?是私域数据?是合规? 没想清楚这一题,应用层的故事很难成立。

时间线上我的判断是这样的:Robotaxi 三年后流行;太空、机器人、AI Science、量子是 5 年后的故事;国防 + Robotaxi 是当下进化最快的赛道。机器人训练已经显出明显的泛化能力,差不多 1 到 2 年后会到达「机器人的 GPT-3.5 时刻」——一个不是最完美但已经足够好用的转折点。

我最近在看 DeepMind 一位科学家写的文章——他描述的曲线是:通用智能即将到达 → 进入「集体智能时代」(10 到 15 年)→ 库兹韦尔《奇点更近》预测的 2040 年「集体智能 + 意识上传」。

这条曲线如果只看一两年是看不到的,要看十年。这一段最后我想给一个名字——未来不再叫互联网(Internet),它叫 Intelligent Network(智能网络)。这是一个从「连接信息」到「连接智能」的范式跃迁。

这一场直播信息密度大、压迫感重,所以我特意把最后三十分钟留给了一些更慢、更柔的内容。

我先放了一段 Rick Rubin 的独白——音乐圈最有名的制作人之一,他制作过 Beastie Boys、Johnny Cash、Adele。他在那段视频里说:

I have no technical ability... So what are you being paid for? The confidence that I have in my taste, and my ability to express what I feel.

我没有技术能力,那别人为什么要付钱给我?因为我有信心——我的品味,和我表达自己感受的能力。

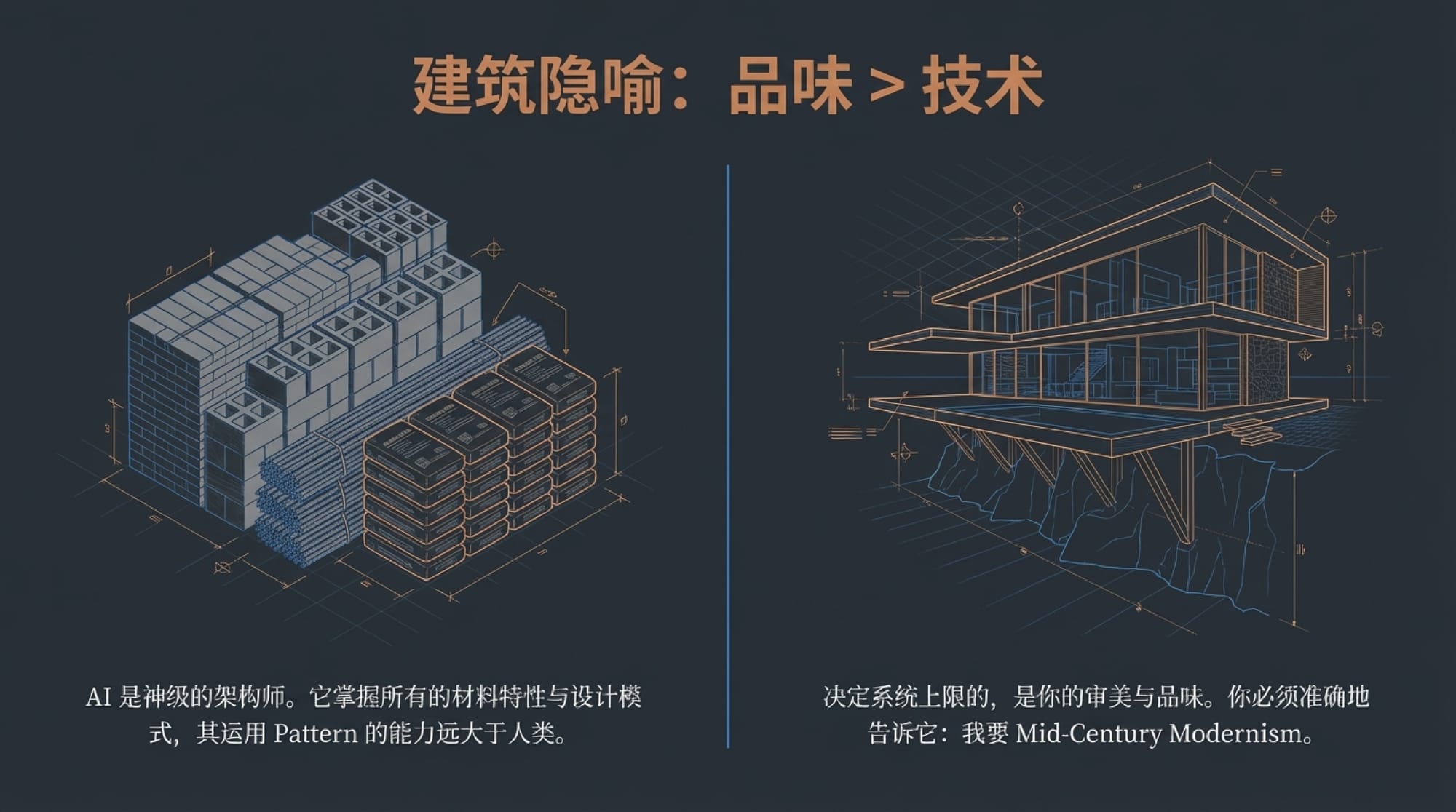

这就是我心里 AI 时代「人」的核心能力的最准确的描述。我不会写代码,但我知道什么是好代码;我不会设计,但我知道什么是好设计。AI 时代的核心能力是选择和表达——不是动手能力,是动心能力。

Rick Rubin 最近还做了一件让我很感动的事——他和 Anthropic 合作,把《道德经》用音乐符号重新表达了一遍。这件事的隐喻很美:用最古老的智慧,配最前沿的工具,做出来的东西不是科技,是诗。

接下来我想讲判断力。

我前几天读到一篇文章里有一句话,我抄了下来——判断力不是分析能力的产物,它是分析能力的前提。这句话非常关键。AI 时代我们以为分析能力会被解构,但其实分析能力是 AI 已经具备的部分——AI 把分析能力压缩成了一个无限便宜的商品。真正稀缺的不是分析,是在分析之前的那个判断——「我们应该分析什么?什么值得被分析?」

我把这件事拆成了两层:人类负责动态的良知,AI 负责静态的良知。

什么意思?人类在每一个具体的、不确定的、有伦理含量的、有情感张力的时刻,做出动态的判断;AI 把这些判断沉淀下来,规模化复制——这是 AI 时代的「大规模生产」。人类的工作是不断把动态判断喂给 AI,让它做静态的扩展。

这就引到了我直播里讲过的一个反直觉的建议——不要让 AI 替你写作。理由有三个。

第一,写作是思考。写作不是为了写完,而是为了「走进混沌、带着清晰的结构走出来」。让 AI 替你写,等于让别人替你健身——肌肉是别人的,不是你的。

第二,信任是有代价的。一个人如果总是在传播没经过自己脑子的 AI 生成内容,他在社交关系里的信任度会断崖式下降。

第三,AI 在写作中的合理用途:研究、核实、快速记录与转录、想法生成、找你看不到的瑕疵、提高效率。但结构、开头、立场、用词的味道——这些都得是你自己的。

我自己写文章,开头和结构永远是自己写的,AI 只在中间填一点细节。这是我对自己的一种纪律。

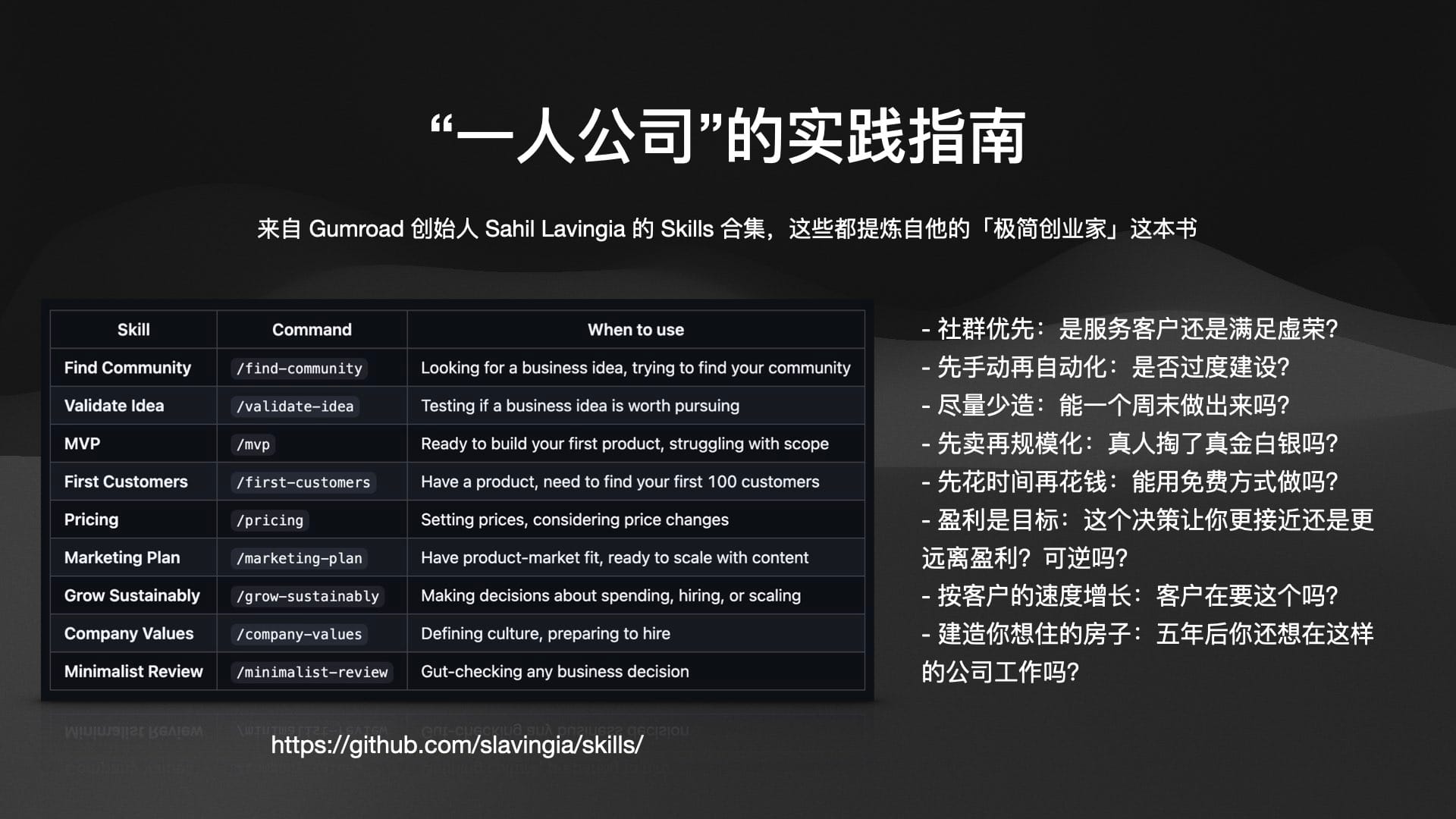

直播的最后我推荐了一本书——Sahil Lavingia(Gumroad CEO)的《极简创业家》(The Minimalist Entrepreneur)。它的几条原则放在 AI 时代特别值得重读:社群优先、先手动再自动(不要过度建设)、先卖再规模化、先花时间再花钱、盈利目标、按客户增速成长、造你真正想住的房子(5 年后还想做这件事吗?)。

最后一段我想留给「全球智能危机」这个话题。

如果 AI 大规模取代人类劳动 → 白领危机 → 劳动力危机 → 金融危机 → 全世界进入通缩。这条逻辑链是成立的,每一步都已经有很扎实的论据。

但我相信人类。我们最大的优点是乐观和创造知识。

我反复回到这句话:AI 是终极的压缩器,它负责学习和推演;我们负责分布之外的探索。AI 处理已知,人类处理未知。这是我们这一物种过去 30 万年里最稳定的核心能力,而且正好是 AI 当前架构最难复制的部分。

还有一句更朴素的话——稀缺的不再是知识,而是学习的欲望。在一个所有信息都触手可及的时代,谁还有学习的欲望,谁就赢了。

最后一句话我想送给所有看到这里、心里多多少少还有一点焦虑的人:焦虑是一种对未知事物的模糊恐惧。打开盖子看它如何工作,你就会把焦虑转换成掌控感。

不要回避 AI,不要假装这件事跟自己无关。打开盖子。

直播的最后一小段,是关于 Rewired 这个项目的更新。

rewired.mx 已经正式上线——虽然很多内容还在持续填充。

整个 Rewired 由三个项目构成:

这三个项目共享一个 Rewired 品牌——Index 提供框架,Book 输出思想,Community 是给读者、给社群、给企业的统一入口。

社群的核心话题是一个三角:投资 + AI 进化 + 企业 AI 范式转型。矩阵结构是「媒体 + 社群 + 工具」。新增的内容包括周刊(每周邮件列表)、工作坊(线上线下,5 月公布课程目录)、真实 AI 案例采访(小公司用 AI 提效率的真实故事)、Rewired Index 投资决策控制台(6 月上线)。

会员分级很简单:免费(媒体内容)/ 付费(工作坊内容、线下课程优惠)/ 高级付费(Rewired Index 自动投资工具)。

线下据点这一年的计划是:温哥华(已有)、三藩(6 月)、上海(6 月回国设立)、东京(年底)。

工作坊的初步课程清单包括:AI 共生思维课(101)、个人知识系统设计、AIGC 实战、企业应用(专门为企业定制工作坊)。

我自己给社群的口号是两句话——一句是 2024 年底就在念的「科技加速 + 主权个人」,另一句是我自己写的中文版「AI 共生的思维进化」。这两句话,是我所有这些事情真正的底色。

这一场直播叫「校准」。我很喜欢这个名字。校准不是一次性的动作,它是一种持续的姿态。当世界以这种速度变化的时候,你不可能在某一天「想清楚了」就停下来——你只能保持校准的姿态:观察、思考、行动、回顾、再校准。

如果今天这一场直播能给你留下三件事,我希望是这三件——

第一,从 chat 到 agent——把你和 AI 的关系,从「我问 AI 答」升级到「我设目标,AI 替我做」。

第二,从碳基到硅基——把你的注意力、时间、资本,从一个增长见顶的人口经济,转向一个指数级增长的算力经济。

第三,从分析到判断——AI 已经把分析能力压缩成商品,真正稀缺的是判断力、品味、和提出好问题的能力。这些只能向内寻找。

剩下的事情,慢慢来。打开盖子,看 AI 如何工作。你会发现,焦虑就这样变成了掌控感。

下一场 Indigo Live 见。

这是 Indigo Live · 0427 月末直播的完整文字整理,由 Indigo 主讲。

2026-05-10 12:34:12

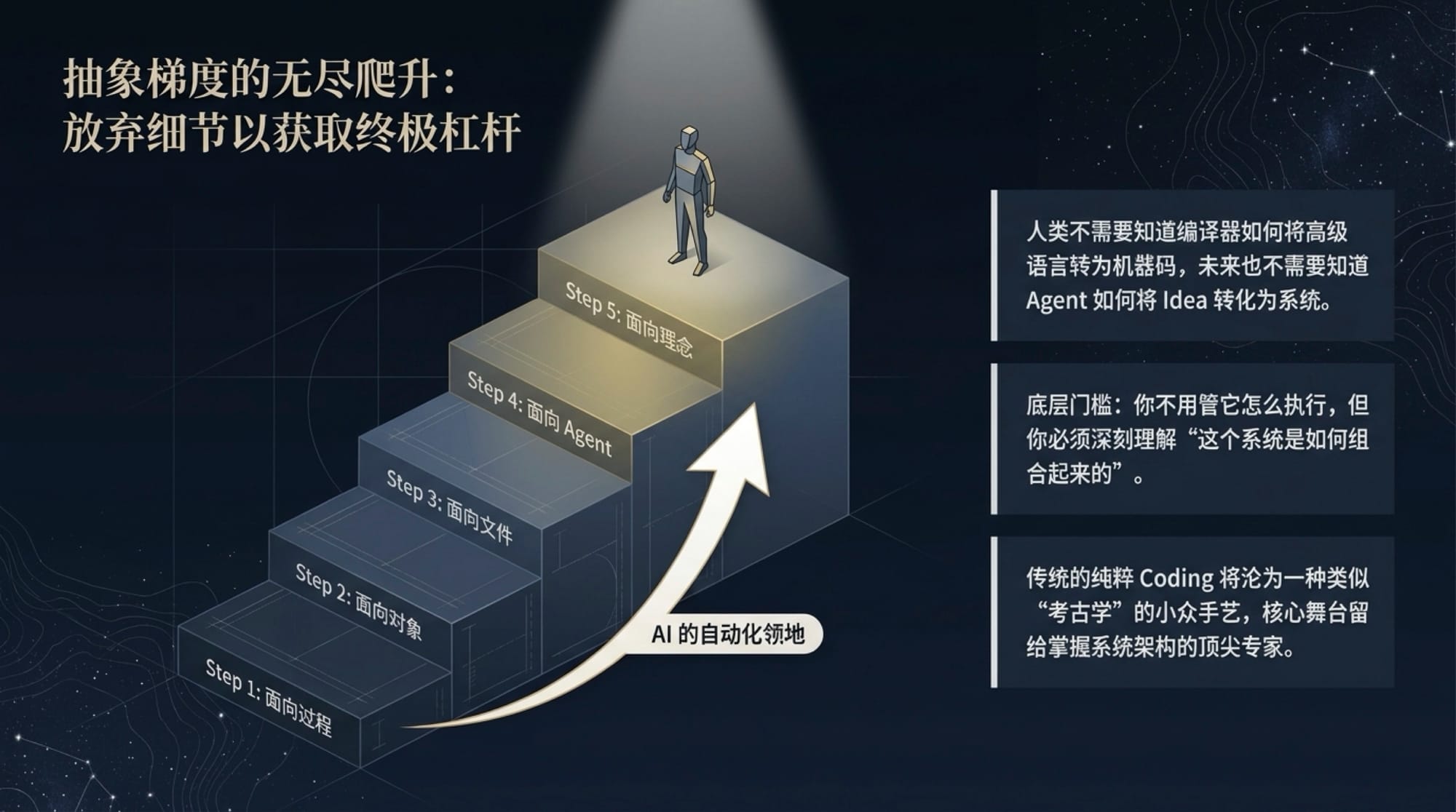

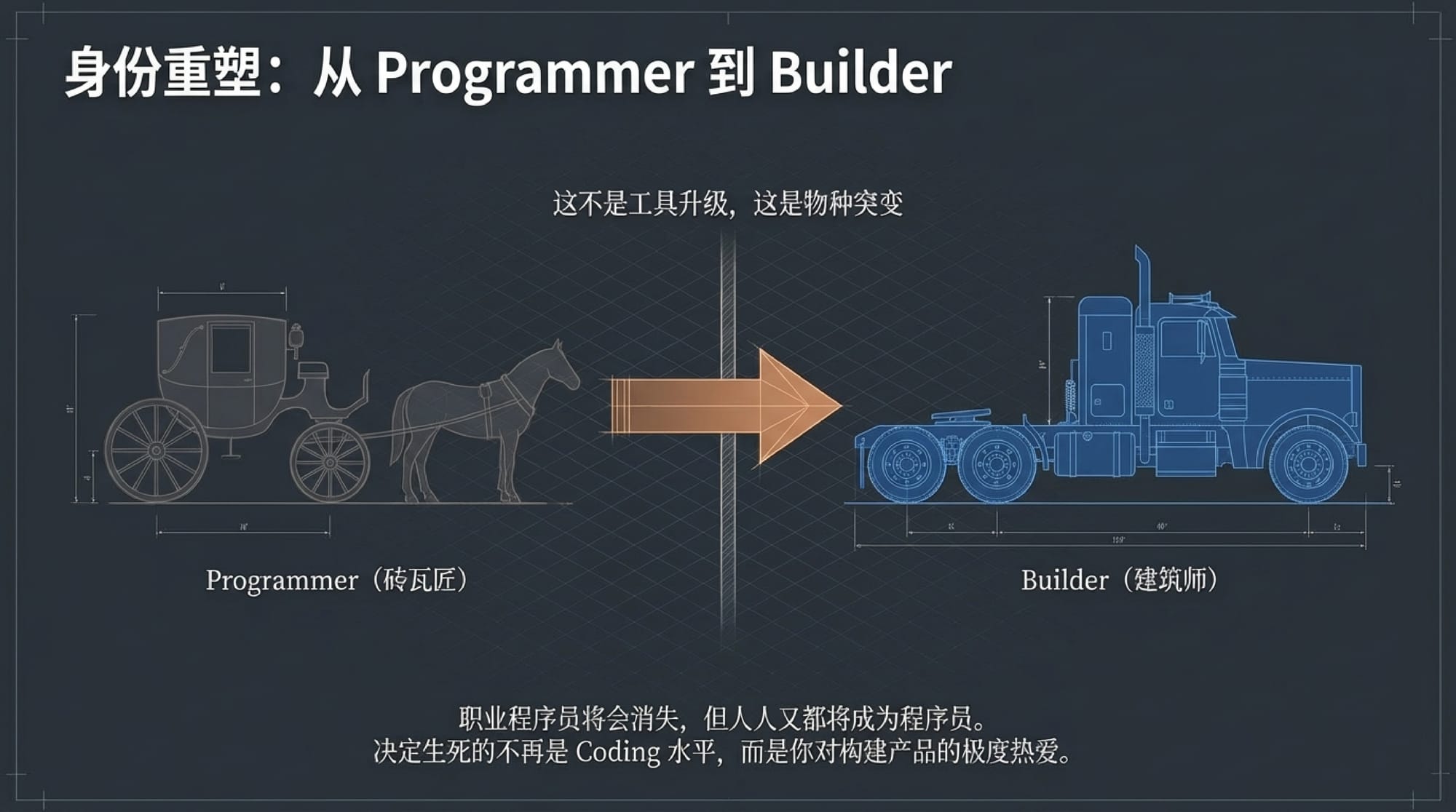

如果说 2024 年底大家还在围着 o1 和"推理式计算"打转,那么仅仅一年零四个月之后,整个软件工业的 narrative 已经变成了 Agent Harnessing、Skills、面向 Agent 编程,以及"我们到底还需不需要程序员"。

这一期 Indigo 请到的嘉宾是 Sonya——本科经济学、第一份工作做投行、转码进 Meta 做搜索推荐、办过 AI 峰会、现在在做 AI Pharmaceutical 的项目。她是少数同时穿越过"投行—工程—AI 应用—生物医药"的女性技术人,所以这场对谈既能落到代码哲学的细节,又能拉远到组织、社会、人类意义这一层。

两人聊了五十多分钟,从 Vibe Coding 一直聊到星辰大海,但中间有一条非常清晰的主线:当编码这个动作本身被 AI 接管之后,人类剩下的位置在哪里? 答案不像很多硅谷推文里说的那样简单——既不是"被替代",也不是"被解放",而是被推上了一个更高、也更陌生的抽象台阶——成为治理者。

Apple Podcast & Spotify 播客 | 小宇宙播客

时间戳

下面是这一期的完整整理,配合时间戳,可以当作一份"AI 时代职业转型的判断地图"来读。

Sonya和 Indigo 上一次录节目是 2024 年 12 月,从那时到今天,AI 编程能力大概是"每个季度翻倍"——一年下来就是 2 的 4 次方,16 倍的纯能力跃升。

Indigo 一开口就让 Sonya 说说她从 Meta 工程师视角看到的变化,Sonya 的第一句回应是:"我真的觉得,天变了。"[09:09]

她用了一个很重的比喻:一年前那种一行行写代码的年代,现在回头看就像石器时代。[09:34] 她自己已经开始 Vibe Coding——讲一段话,让模型生成整个项目。当然不是每一行代码都能比拼得过人类顶尖程序员的优雅、精简、安全,但对于绝大多数实际的 Coding 工作,甚至对最顶尖的程序员,整体效率是被显著拉高的。

Indigo 在这里抛了一个数字感:从 2024 年底大家还在聊 o1 那种"推理式计算",到现在智能体已经能持续工作四五个小时,模型能力基本上每个季度翻倍。一年下来——2 的 4 次方,16 倍。这已经不是线性,是指数。

而且更可怕的是,这种加速本身正在自我加速:现在的 AI 已经在帮自己写代码、自己迭代版本。Indigo 顺着这个引到 Anthropic 这家公司的形态——为什么 Anthropic 发版本这么快?因为它整个公司是非常扁平的,全员都在用 AI Coding 软件,所有人都在为"让 AI 加速进化"这件事服务。Anthropic 是一种新形态的组织。

这就构成了整场对话的第一个底层事实:编码这件事的产能边界已经移位了。剩下的一个小时,他们都在解一道题——既然产能已经不在写代码这一步上了,那它在哪一步上?

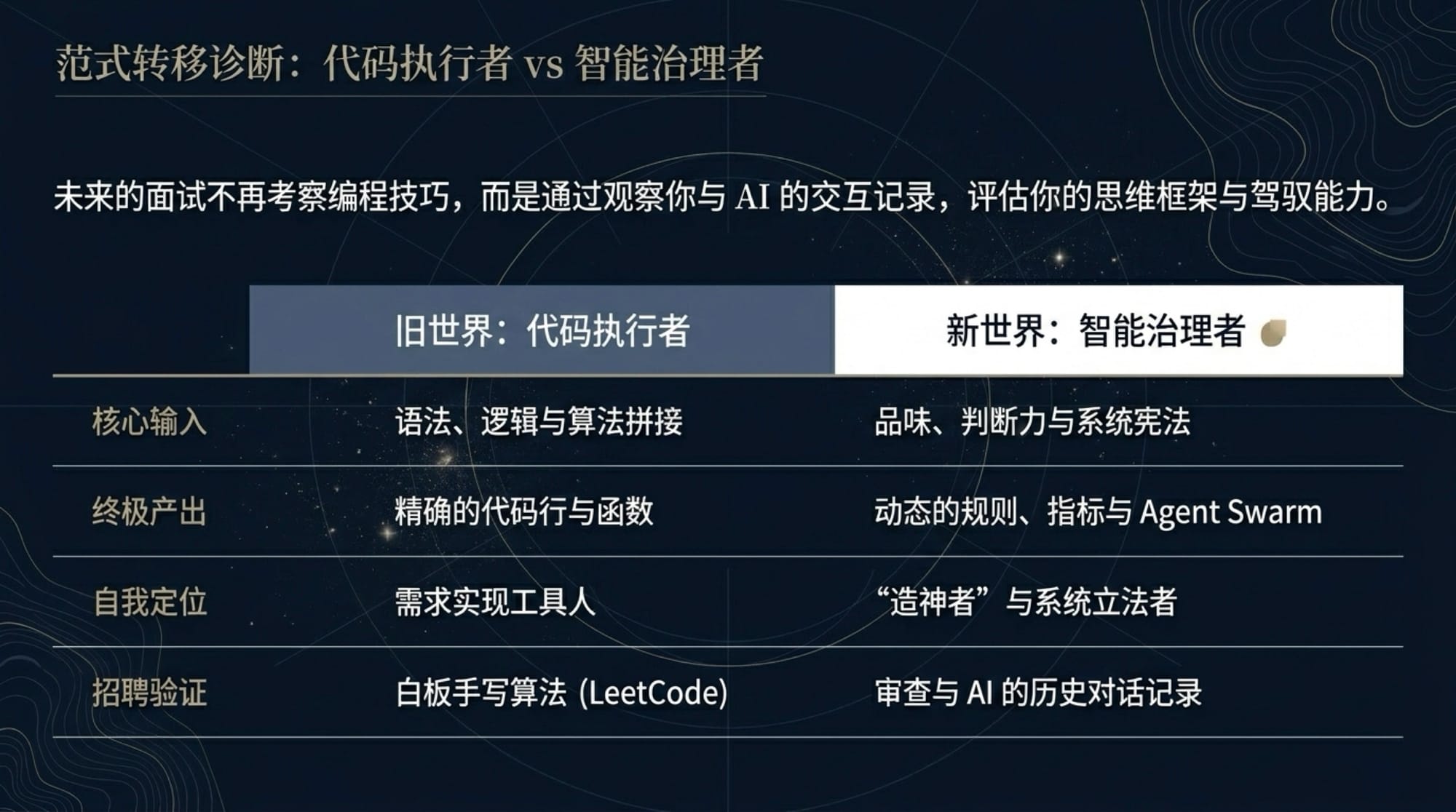

现在程序员的关键工作不再是 Line by Line 写代码,而是给 AI 设计一个 Harness(驾驭框架),让模型自己去自我进化、自我净化。这件事更像哲学家做的工作——你设计一个理念,让 Code 在这个理念下自己长出来。

Sonya 提到一个最近被频繁讨论的词——Harnessing,"驾驭"。OpenAI 写过一篇 Agent Harness 的文章,Anthropic 也越来越多用这个词。它的意思是:单纯一个 LLM 就像一颗赤裸的 CPU,本身没有上下文、没有记忆、没有外设。要让它干活,你必须给它一整套"约束 + 工具 + 上下文 + 文件系统 + 网络 + IO + 规则"——这一整套加起来,组成一个让模型能持续运行的运行时框架。

她提了 Andrej Karpathy 那张著名的"LLM 像 CPU"的图,并且补充道:当时画那张图的时候 Harness 这个概念还没出来,现在套上 Harness 的概念,整张图就清晰了——LLM = CPU,Harness = 一台围绕 CPU 设计的计算机。

这一层一旦看清,程序员的工作就变了:

"更像是一个哲学家,去设计一个理念,然后让 Code 在遵守这个理念的情况下,去自我净化。" [12:06]

Indigo 在这里把这个比喻往前推了一步——人类变成了在造每一个 Code Product 的"造神者"。[12:19] 你不再决定它的每一行实现,但你决定它"应该是什么样的存在"。

这件事的难度并不比写代码低,反而更高。因为你不是在解一个有标准答案的小题,而是在为一个会自己生长的系统设定它的"宪法"。比如说,你设计一个推荐平台,那它的 Philosophy 是什么?什么样的推荐机制是有益的,什么是有害的?你不再去手动 hardcode 一堆算法,而是要设计一套理念,让 Agent 自己去生成这些算法——但这些算法又必须始终符合你最初的理念。

Sonya总结说:未来的工程师有两层身份——一方面是系统设计师(数据怎么流、算法平台怎么交互、安全漏洞怎么处理),另一方面更重要的,是理念设计师。

这就引出了下一个、也是这一期最锋利的一个问题。

理念定义的核心是判断"什么是好的"。但要真正知道什么是好的,你必须曾经亲手一步步做过——否则你的 Reasoning 是漂浮的,没有根基。这是 AI 时代人类最容易丢掉、也最致命的一种能力。

Indigo 在这里讲了 Rick Rubin 那段最近很火的录音——"我不会写代码,但我知道什么是好代码"。[18:57]

听起来很玄。但 Sonya 立刻接住了:

"我觉得 Indigo 点到了一个非常重要的点。以后我们人类知道什么是好的,比能不能自己 Exactly 写出好的,会更重要。 但是大家不要小看这件事——你要去学'什么是好的',其实是非常难的。" [19:06]

她抛出一个反向问题:如果你不会写,你怎么知道什么是好的?

举一个最简单的算法例子:我以"谁最多人点赞"作为推荐目标。短期看似乎没问题,但如果让这种算法长期主导一个平台,那这个平台会被什么样的内容主导?这其实需要你既懂算法、又懂内容生态、又懂人性的累积反应。一个没有任何亲手做过算法的人,没有跌过坑、没有看过这种 Metric 在三年时间维度上扭曲一个产品的过程,他凭什么去判断这是不是一个好算法?

更危险的是 Hallucination。在自己的领域里,你还有直觉能感觉到"AI 这句话好像不对";但只要换到陌生领域——比如药物剂量、医疗诊断、法律——你完全没有能力判断 AI 说的是不是对的。AI 让你吃 100 毫升某种东西,你不知道这对一般人是安全的、对某种人群却是极度危险的。

Indigo 在这里把"直觉"这个东西拆开了:直觉本质上是一个非常复杂的内在模型,是你一步步亲手做过、犯过错、修正过、复盘过之后,沉淀下来的东西。

"你犯过错误,然后你修正过。" [22:42]

Sonya 顺着这个思路讲了一段非常重要的话:

"其实我觉得会是人类一个非常困难的事情。就是如果持续地、在每个领域都保持顶尖的专家,会变成非常重要的东西。 否则我们所有东西都待会给 AI 来评判——这真的安全吗?" [21:59]

这是整场对话第一次出现"危险"这个词。它不是关于 AI 失控的危险,而是关于人类自己丢掉判断力的危险。

这里和 Indigo 后面提到的另一段话呼应得很紧——他朋友的那句话:

"开车技能可以 Degrade,但思考的技能是不能 Degrade 的。" [44:14]

自动驾驶用多了,开车技能退化是可逆的、可补的;但思考能力一旦退化,你连"AI 说的对不对"都判断不了,这是一种单向坍缩,没有回头路。

编程的抽象层次正在不断爬升。我们经历过面向过程、面向对象、面向文件,今天进入面向 Agent,未来会到面向 Idea。每一次爬升,都意味着我们放弃下一层的细节,但获得更大的杠杆——只要你还知道"系统是怎么组合起来的"。

为了缓和"判断力危机"这个有点沉重的话题,Indigo 主动给出了一个更乐观的视角——这一切其实是抽象层次的自然演化。

我们今天不需要知道编译器怎么把高级语言变成机器码、机器码怎么在 CPU 上执行,但是还是有人知道。我们只是从"必须知道"变成了"在更高层操作"。[22:33]

他给了一条非常清晰的演化曲线:

未来你给系统的不是一份 .py 文件、一份 .cpp 文件,而是一个目标、一个 Agent、甚至直接一个 Idea。[26:00] AI 已经聪明到只要你"提示它一个 Idea",它就能帮你实现。

但这里 Indigo 留下了一个关键的认识论 bound:

"下面我就不用管它怎么执行了,但是——我得知道这个系统是怎么组合起来的。" [23:33]

这就是新一代"程序员"——或者更准确说,新一代 Builder——的最低门槛。你可以不写每一行代码,但你必须理解系统的组合方式、各模块的边界、它们之间如何彼此影响。否则你只是在外包给一个比你聪明的黑箱,而黑箱产生的灾难你既看不出来,也修不了。

Sonya在这里给了一个特别有画面感的猜想:

"可能就像以前我们大部分人都是农民——不是因为农业很高级,而是种粮食必须这么多人。但现在,可能只需要少数人掌握这个技术,再压缩到每个领域只需要更少的人去掌握核心。但这些人会需要是顶尖的 Experts。" [24:09]

她接着补了一个很妙的隐喻——剩下的那一小部分对 Coding 还有执着热情的人,会变成像今天的考古学家一样,专门去研究"代码到底是怎么写出来的"这件事,作为一种 hobby、一种 craft,但不再是社会主流职业。[27:48]

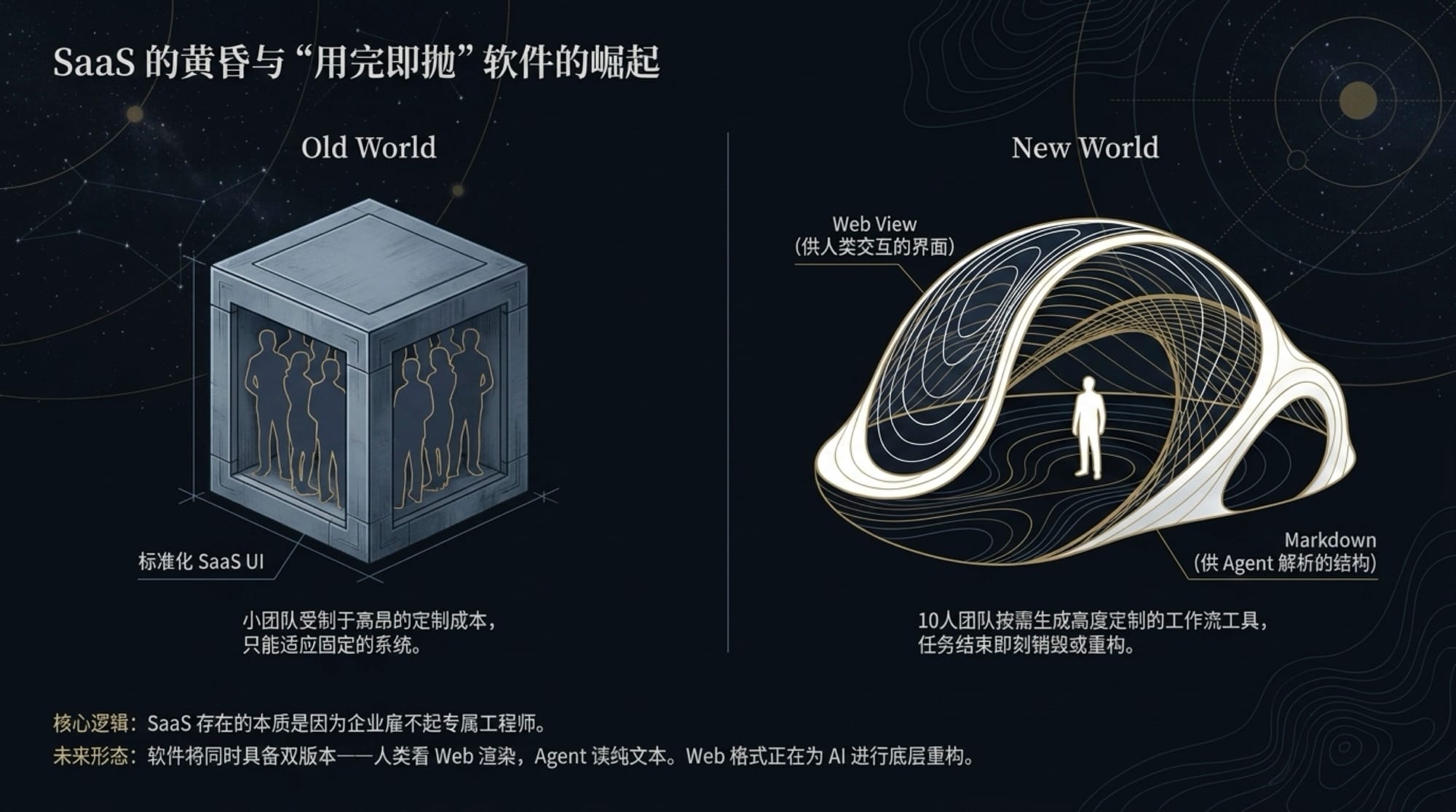

这一代 SaaS 之所以存在,是因为大多数公司请不起 10 个工程师为自己定制软件。但现在,任何一个 10-20 人的小团队,都可以让 Agent 按需为它现写一份软件,用完甚至可以扔掉。SaaS 公司的存活空间正在被压缩到非常窄的一个区间。

Indigo 把节奏带到了一个商业层面的判断:

"这个时代的软件都是标准化的——SaaS 也是标准化的。那是因为很多人没法请很好的团队去定制化我的需求。但是接下来会有一个变化:任何一个小团队,都可以让 Agent 按照我的需求去产生软件。" [28:51]

这个观察对今天的 SaaS 投资是降维打击。一个 10 个人的小公司过去只能用 SaaS,因为它请不起独立的工程团队;但现在,它可以让 Agent 临时生成一份完全为它的工作流定制的软件,用完即抛,或者持续迭代——完全定制化你想要的,不再 stick to 你那固定的 SaaS 页面。

Sonya在这里加了一个非常关键的子话题:面向 Agent 而不是面向人类的开发。

她举的例子是:以后网页可能会有双版本,一个 Markdown 版本(给 Agent 看),一个 Web View 版本(给人类看)。原因很简单——人类看 HTML 渲染那种"用户界面"是高效率的,但 Agent 不需要图片、按钮、动画,它需要的是结构化、可解析的文本。Web 的格式正在为 AI 而重构。

紧接着 Indigo 分享了他自己的实践——他用 AI 做股票投资,搭了 4 个 Agent,每个 Agent 一个角色:

• 一个 Agent 负责观察 Marketing 情绪、宏观新闻;

• 一个 Agent 专门评估每只股票的买入和卖出点;

• 一个 Agent 负责抓取所有公司新闻;

• 一个 Agent 负责仓位平衡。

但他没有把它们拼成一段固定的程序——相反,他让每个 Agent 把执行结果写成 Markdown 文件,其他 Agent 去读这些 Markdown 来获得上下文。甚至还专门拉了一个 "Critic Agent" 来 Criticize 当前 Agent 的判断。最后再叫一个 Agent 把所有 Markdown 渲染成网页给"老板"(也就是他自己)看。

这就是"以文件为中介的多 Agent 协作"——一种轻量、透明、可审计的 Swarm 架构。Indigo 自己评价:

"我肯定没找到更好的 Agent 通讯方法,但是让他们用文本通讯,就很好了。"

由此引出一个值得记下来的隐喻:未来每个人都是一个资本家——只不过他调动的不是人力,而是 Agent。Indigo 早上和朋友聊到的判断:"未来人类只剩两种:人均创始人 / 人均 Boss,以及人均资本家。剩下的人,他们的工作是 投票、投钱、投 Attention。"

今天的 Agent OS 本质上是 Unix 哲学的升级版——所有东西都是文件、所有协议优先文本、所有交互都是读写。Skills、Memory、Context、Personality——全部都可以沉淀成 Markdown 文件,被组合、被复用、被传承。

Indigo 在这里给了一个非常 Indigo 式的判断:

"我建议现在所有人用 Agent 的、想做 Agent Harness 的人,重新回顾一下 Unix 哲学。"

Unix 哲学三件事:

1. Everything is File —— 所有东西都是文件。

2. 能用文本就不用二进制 —— 所有协议、存储、交互优先文本格式。

3. 确定性优先 —— 能用代码解决的,就用代码解决,不让 AI 重复生成。

这三条今天看回去,简直是为 Agent OS 量身定做的。

为什么 Claude Code 这么流行?因为它给你创造了一个 Workspace,里面有 Memory、有 Soul、有 Skills——全部都是基于文件的。[35:31] Agent 进到这个目录里一看,几秒钟就读懂了:你是谁、你想要什么风格、你处理过什么任务、你的 SOP 是什么。

Sonya补充了一个很新的角度:Unstructured Data 在 LLM 时代不再是"难处理的",反而成了"最丰富的"。[36:12] AI 可以从你过往处理过的所有文件里,反向 Extract 出你的风格、你的常规 SOP、甚至你的 Rare Case 处理方式。

Cursor 最早做了 Rules 文件这种概念,Claude 学过去做了 Claude.md。两人在这里给出一个判断——

"思维目录就是一个电脑上的 Folder,就好像是一个 APP 一样。Agent 加上 Folder,它就能够干活了。"

这就是为什么 Skills 概念最近这么火——它把"你的某项能力"整理成一个可被组合、被搜索、被调用的 Markdown 包,下次类似任务来了,AI 不用从头思考,直接调对应的 Skills。

由此 Sonya 抛出了一个非常意味深长的判断:公司在收集你的"风格"。

"公司在看你怎么跟 AI Interact,然后去学习你、复制你。可能你处理同一个 Case 比我特别优——那就让 AI 学习你的方法。" [38:00]

Indigo 接住这个观察立刻类比到招聘:

"我觉得接下来招工程师应该这样招了——你不用考他这些编程技巧、代码,你考他怎么和 AI 聊天的。把他和 AI 的对话记录给我看一眼,我就知道你是什么风格的人。" [38:14]

这是 Coding Interview 的下一个版本——从"看你能不能写算法"到"看你能不能驾驭 Agent"。

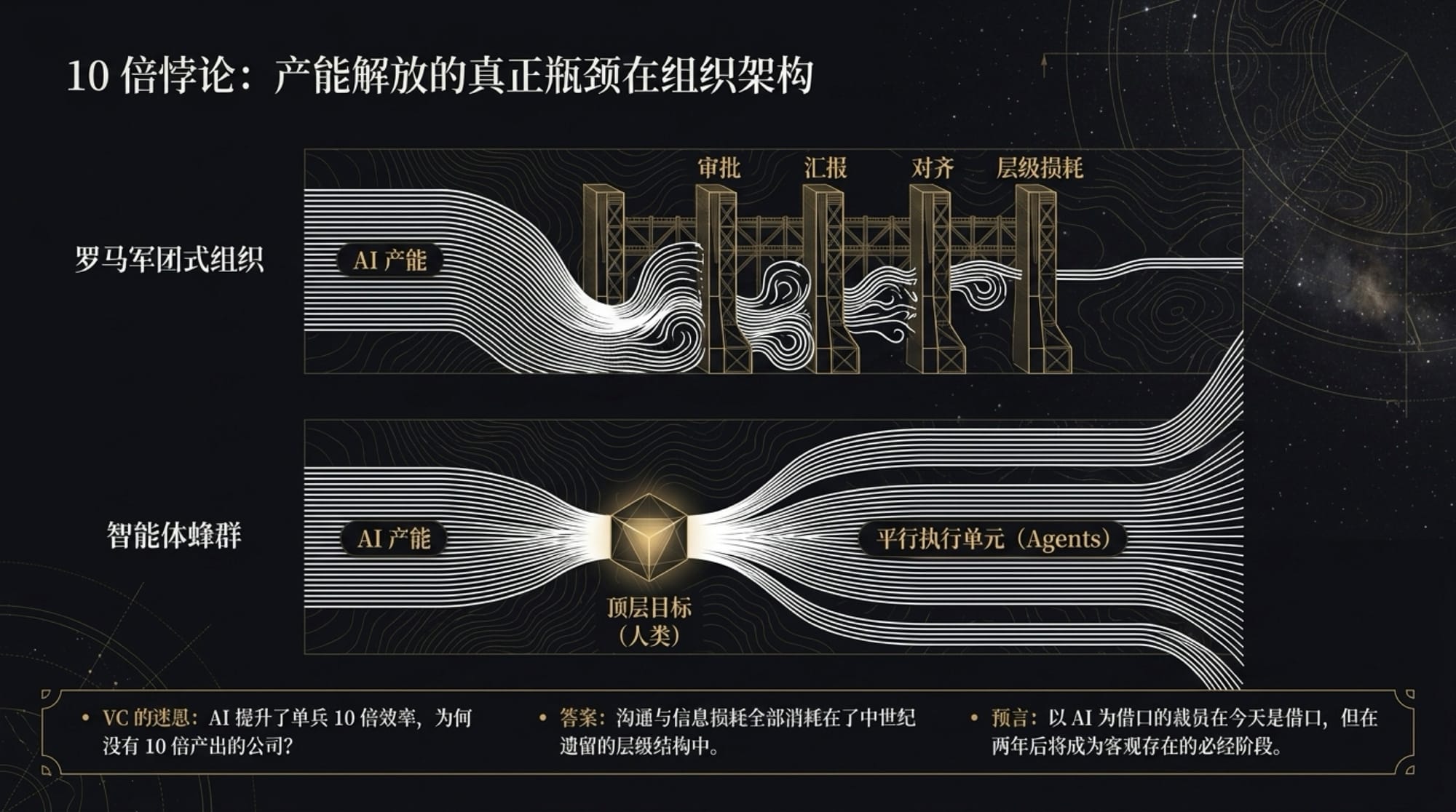

现在 VC 圈最热的一个问题是——AI 把单兵效率提了 10 倍,为什么我们没看到 10 倍产出的公司?答案是:组织结构不是 10 倍的。沟通损耗、审批层级、罗马军团式的指挥链——这些都把 AI 的效率消化掉了。Anthropic 这种扁平化、Agent Swarm 化的组织,才是 10 倍产出的真正解。

Indigo 在这里直接抛出 VC 圈的迷思:

"为什么 10 倍的效率,目前我们还没有看到 10 倍的产出?" [39:40]

Sonya的回答是: 因为组织不是 10 倍的。沟通都损耗在组织的结构里面去了。

她展开了:现代公司的组织结构其实从罗马军团传下来——一级二级三级一直往下传,每一层指令传递都会损耗,下一层的人还要 Prove 自己存在的价值。指挥层带宽天然不够,没法直接指挥前线的每一个执行单元。

但是 Agent 不一样——Agent 可以直接穿透指挥到前面的每一个执行单元。[41:50] 它就是一个 Swarm。Claude Code 默认能并行启动 6 个、10 个、甚至 100 个子 Agent,唯一限制是 Token 消耗速度,也就是钱够不够,不再是模型能力或人力的问题。

这意味着公司形态会变:原来 5-6 层的指挥链,未来可能压缩成 2 层。老板有一个最大目标,下面直接是 Agents,Agents 自己分配子 Agents——所有的"数字端"工作(代码、设计、文档)全部由 AI 处理。

这里 Indigo 引用了 Marc Andreessen 最近的一句话:现在很多公司号称是用 AI 作为借口去裁员;现在是借口,但过两年就不是借口了。

Sonya顺着这个判断的反面,提出 Amazon 最近的反向操作——亚马逊几次大事故后,要求人类必须审核 AI 生成的代码。但她自己的判断是:

"这只是一个阶段性的问题。要真的靠人脑去审核所有东西,那太慢了,那会变成一个新的 Bottle Neck。" [41:01]

人类在新组织里的角色,被推到了"边缘"——不是贬义的边缘,是物理意义上的边缘:

"AI 再怎么好,他在现实世界中没有 Experience、没有接触。所以人更多的是去做情绪关怀、做沟通、做体验、做接触。 给 AI 跑腿,把现实数据收集回来传给 AI。就相当于我们是小脑——大脑慢慢被 AI 替代了。" [43:31]

这是一个非常具体的画面:未来人类的位置,是 AI 这个"分布式大脑"的小脑和外周神经。

当一个人不再亲手经历"一步步做"的过程,他失去的不是某种执行技能,而是判断力本身。未来世界会两极化——少数顶尖 Expert 会变得极其稀缺、极其重要,因为只有他们能跟模型做 Alignment、做审查;剩下的人会被推向情感、关怀、生活的另一极。

Indigo 在这里认真讲了他朋友那句话:

"开车技能可以 Degrade,但思考的技能是不能 Degrade 的。"

但是 Sonya 立刻接住——问题恰恰在于,一个人如果没有一步步去做过这些东西,空泛的 Reasoning 是不扎实的,很容易被 Mislead。

她描绘了未来的两极:

• 一极是顶尖专家:能做 Alignment、能做最后一道审查、能判断"AI 说的对不对"。

• 另一极是大量的人:把 Attention 放在生活和关怀上,承担情绪劳动、现实接触、社交体验的部分。

但她随即指出一个更深的悖论——

"人是不能够被逼迫的。我不能逼你成为一个顶尖的专家。" [14:14]

如果整个社会变得很富裕(每个人的物质需求都被自动化的生产解决了),那它就有点像今天的"人人都是富二代"。富二代会做什么?观察今天的富二代你就知道了——寻找刺激、寻找意义。

这就走到了对话最沉重的地方:

"如果说工作不需要了——大量人,其实生活真的没有意义了。" [26:49]

"好的价值观可能会变得更重要。" [46:04]

Indigo 把这一段拉回到一个更宏观的历史尺度:人类两三百年工业革命下来,意义感都是建立在"劳动和生产"之上。突然这五到十年,工作不需要了,意义体系还来不及重建。打猎种田、农业生产、工业生产、智力劳动——一层层都被替代之后,除非我们的脑子能开发出新的东西,否则就是空窗。

未来的"工程师"如果还存在,他做的事情是 Governance——不是 Line by Line 写代码,而是设计一个系统的理念、Metric、推荐机制、平台规则。每个人都会成为他所负责板块的"总督"。Taste 和 Judgment 比 Execute 更重要。

Sonya 把这个判断说得非常具体。她给未来工程师定义了三件事:

1. 设计 Philosophy —— 我们认为"什么是好"。

2. 定义 Metric —— 用什么来衡量"是否真的好"。Metric 一旦设错,整个系统就会扭曲

3. 持续审视 —— 现在设计的系统是否真的 Truly Serve 我们最初的 Purpose。

也就是说,工作的核心 input 不再是代码,而是 Taste(品味)+ Judgment(判断力)。

她顺便给出了 Anthropic 之所以代码模型领先的非工程解释:他训练数据挑得好、目标清晰、不分心。

"Anthropic 不会像 OpenAI 那样跑乱了——东想做生图、西想做视频。它就一心做代码 Agent。" [59:02]

Indigo 给了一个特别精确的比喻——每个人都是总督:

"每个人都是总督——这里有一个小国家给你管理,应该怎么搞。" [50:14]

不同的"国家"会有不同的治理风格:

• 有些平台会很 Extreme,主打博弈、刺激;

• 有些平台主打温暖、Softness、Encouraging;

• 有些主打专业极简——

而工程师/Builder 的任务,是为这个"国家"立法、定 Metric、做治理者。

这个变化对就业市场的影响是双向的:

• 第一阶段(短期):传统程序员数量会减少,因为大量低层次的写码工作被 AI 直接吸收。

• 第二阶段(中期):随着每家小公司、每个个体都能拥有为自己定制的软件,软件需求的总量反而会爆发。这时候市场需要更多 Builder/治理者,但他们的雇佣形态会变——不再是某个大厂的全职员工,而是 Contract、多公司服务、20% 给一家、20% 给另一家。

Sonya 给了一个让 Indigo 印象很深的总结:有一部分人会变得更累、有一部分人会变得更闲。累的是那些被多个 AI 任务追着等审核、等决策的治理者;闲的是不需要承担治理责任的大多数。

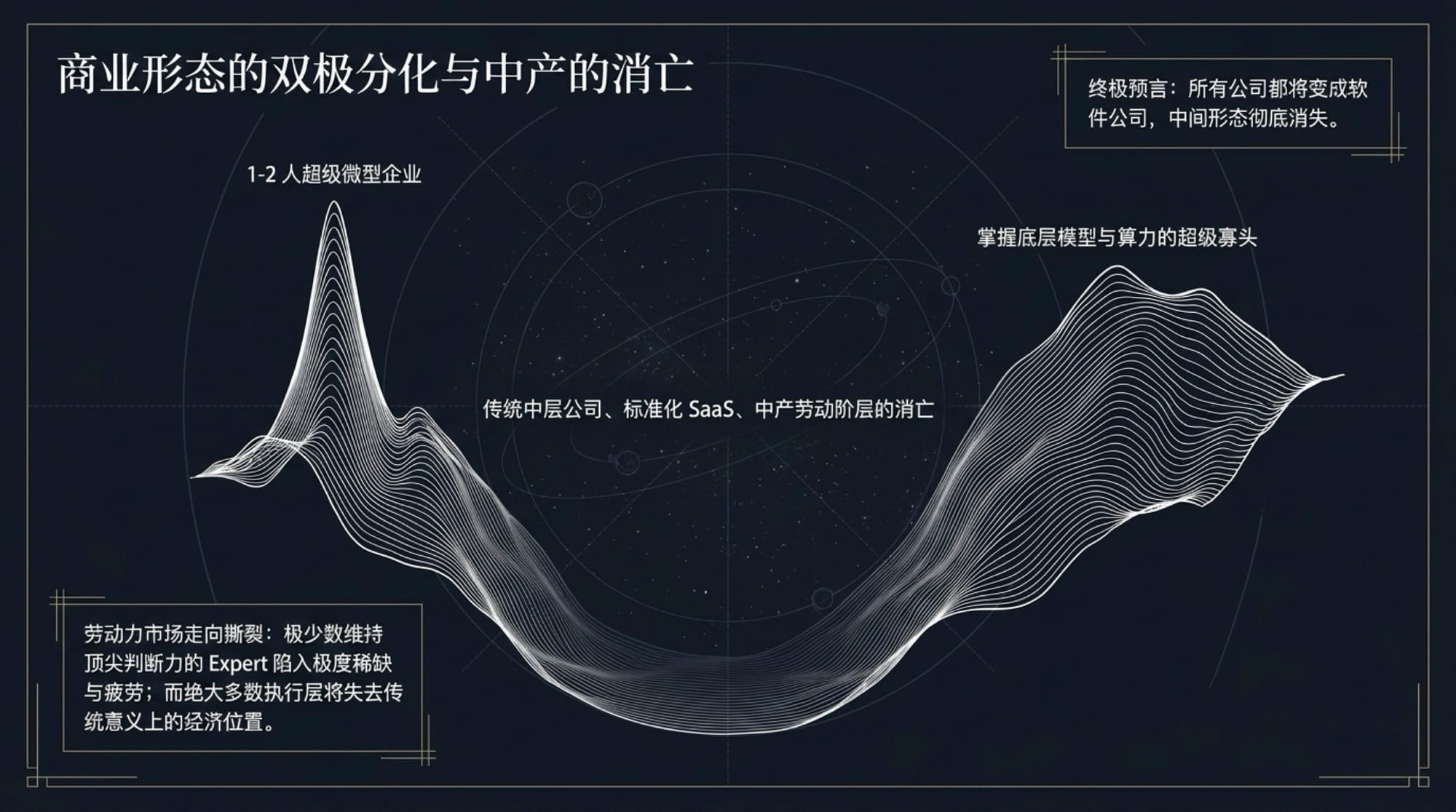

未来的公司形态只剩两端——一两个人的小公司,和巨型公司,中间形态消失。社会层面表现为中产阶级坍塌。唯一能避免社会崩塌的方法,是把生存底线变高(UBI)+ 向外探索新疆界。否则我们会困在地球上、意义空虚、没有下一代。

对话进入收尾,Indigo 给出了一个他自己得出的 punchline:

"任何一个公司都会变成软件公司——任何一个业务都变软件。然后在这个里面,只会存在'一两个人的小公司'和'巨型公司'。中间形态消失。"

Sonya立刻同意,并且把它接到社会层面:这就跟今天的社会一样——中产阶级坍塌。

那怎么办?两人的判断惊人地一致——唯一的方法是把生存底线变高:

"拯救这个社会,唯一的方法就是你把生存底线变高。UBI 啊、什么的实现——大家有一定的收入基础,然后在这上面去实现价值。不然这个社会就坍塌掉。" [54:29]

这是经济侧的解。但 Indigo 觉得这还不够。他给了一个更大尺度的设想——人类的意义危机,最终需要靠"星辰大海"来解决:

"Elon Musk 帮大家解决一个意义危机——你还是往星辰大海去探索,才能解决我们的意义问题。你要发现宇宙才行。不然我们就会困在这个星球上,意义空虚,慢慢没有下一代,然后真的就没有了。"

Sonya 补充说:现在外太空探索能力还远远不够,必须先把它做到让"每人 Assign 一个外太空项目"成为可能的程度。

最后这一段把整场对话从"AI 和编码"拉到了"人类和宇宙"的尺度。它不是为了 dramatic,而是因为前面那条逻辑链——

编码 → 抽象层次升级 → 程序员变治理者 → 公司形态两极化 → 中产坍塌 → 意义危机

—— 走完之后,必须要找一个出口。要么是"提升底线"(经济解),要么是"扩张空间"(物理与意义的解)。两者其实都不是 AI 给的,反而是 AI 留给人类自己的功课。

如果让我从这一小时里只挑五句话带走,会是这五句:

1. "知道什么是好的,比能写出好的更重要——但要知道什么是好的,你必须曾经亲手做过。"

2. "开车技能可以 Degrade,但思考的技能是不能 Degrade 的。" —— 抽象层次的爬升不能跳过"亲手做"这一层,否则爬上去是悬空的。

3. "为什么 10 倍效率没有带来 10 倍产出?因为组织不是 10 倍的。" —— Agent Swarm 这种新型组织,是产能解放的真正瓶颈所在。

4. "以后只剩两类人——人均创始人 / 老板,和人均资本家。剩下的人投票、投钱、投 Attention。" —— 这是对未来"分工"的一种刺眼但精确的概括。

5. "任何一个公司都会变成软件公司。中间公司消失。" —— 这是对 SaaS 投资逻辑、对中产阶级未来、对整个组织演化最锋利的一句判断。

第六句留给所有读完的人——好的价值观会变得更重要。这不是装饰性的结尾,而是意味着:当工作不再决定你是谁,你信什么就会比你做什么更重要。

整理:2026-05-08 · 节目原始来源:Indigo Talk EP47 · 嘉宾:Sonya

2026-04-27 08:18:04

Indigo 西岸巡讲最后一站,覆盖创造者品位、AI 投资框架、Agent 时代的结构性变化、企业架构坍塌与个人定位。

Rewired 社群线下分享会,西岸三场巡讲(西雅图、湾区、温哥华)的总结篇。

时间戳

如果你只想看 AI 行业又有什么新发布,这场分享不是为你准备的。这是一场刻意把镜头拉远的演讲——Indigo 把过去三个月所有的躁动(湾区研究员的焦虑、Workday 的暴跌、Anthropic 突然估值齐肩 OpenAI、Meta 的扁平化裁员、Jack Dorsey 让 6000 人直接向他汇报)压进同一个解释框架里:这不是周期性波动,而是劳动力市场被 AI 重写的开始。

他从 Paul Graham 2002 年那篇《Taste for Makers》起手,把"品位"作为整场分享的精神锚点——美与简洁不是审美偏好,而是揭示事物本质的一种确定性方法。然后顺着这个锚点,他把投资判断、组织演进、政府变迁、个人选择,一层一层地铺开来讲。最后落到一个不太轻松的结论:未来的世界会在两级分化的杠铃上分裂,要么成为放大 AI 的高手,要么成为完全自动化的中位生产者,中间地带最危险。

这是一篇值得读得慢一点的整理。

Rewired 这个社群名字本身就是答案——重新连接,应对一个被 AI 重新组织的世界。

Indigo 把这一站特意安排在温哥华的 Tesla 展厅,不是巧合。来的人基本都是 Tesla 粉丝、Tesla Holder。换个场地是一种象征:之前的活动都在自己办公室,这次跑到 Tesla 来,是因为 Tesla 在这场分享里不是一个公司案例,而是一个时代美学的标本。

他开场就把场子里的紧张感勾了出来:过去三个月变化非常快,如果不在 AI 行业里也许感觉不出来,但只要你在湾区,焦虑都写在脸上了——"研究员都说自己在给自己挖坟,挖到 2028 年他们都没什么事做了。" 这是一个轻松调侃出来的判断,但背后是严肃的。他点出了核心矛盾:AI 实验室在跑得越来越快,其他行业被远远甩在后面,二者之间出现了一条巨大的 Gap,而 Gap 永远意味着机会。世界已经很乱了,要重新组织起来,所以社群的名字叫 Rewired——重新连接的社群。

未来三到五年,绝大多数 AI 应用都会被基础模型直接吃掉;要么投得更深(Infra、Robotic、Defense、Science),要么投得更"端到端"(全栈 AI 公司),中间的纯应用层是死亡谷。

他先简短回顾了自己的来路:微博出来的、Web 2.0 时代的人,孵化和投资过 Airwallex(B2B 跨境支付)、Hostex 等公司。2021–2022 年开始投 SpaceX,2023 年成立 Brilliant Phoenix 基金,进入了一期、二期。最有代表性的是 Anthropic——2023 年在 140–200 亿美元估值时进入,"可惜后面没有追加,有追加就好了"。因为这家公司之前一直默默无名,最近才火起来,估值一下子和 OpenAI 齐名了。除此之外,基金还投了:Crusoe(Neo Cloud / AI Factory)、Apptronik(机器人)、PsiQuantum(光量子计算)。

接下来的判断是反直觉的:他几乎不投 AI 应用层。

"我们还是投 AI 的 Infra 和 AI 驱动的 Science、Robotic 和 Defense,这三个主题。因为我觉得这三个会更快……前面的所有 Apps 都会被模型吃掉,都会被模型吃掉。"

逻辑很硬:模型每升一代都会顺手把一批应用层公司碾碎。"昨天 Anthropic 刚刚把 Figma 给扫了,一个工程就把别人干了。" 能存活下来的只有两类:要么小到不在模型的射程之内(火力够不到的小公司),要么大到自己就是端到端的全栈玩家(自研芯片+模型+应用,比如 Tesla、Google、NVIDIA)。中间体量的 SaaS 是最危险的位置。

这是整场分享里第一次出现"杠铃"思维——后面会反复出现。

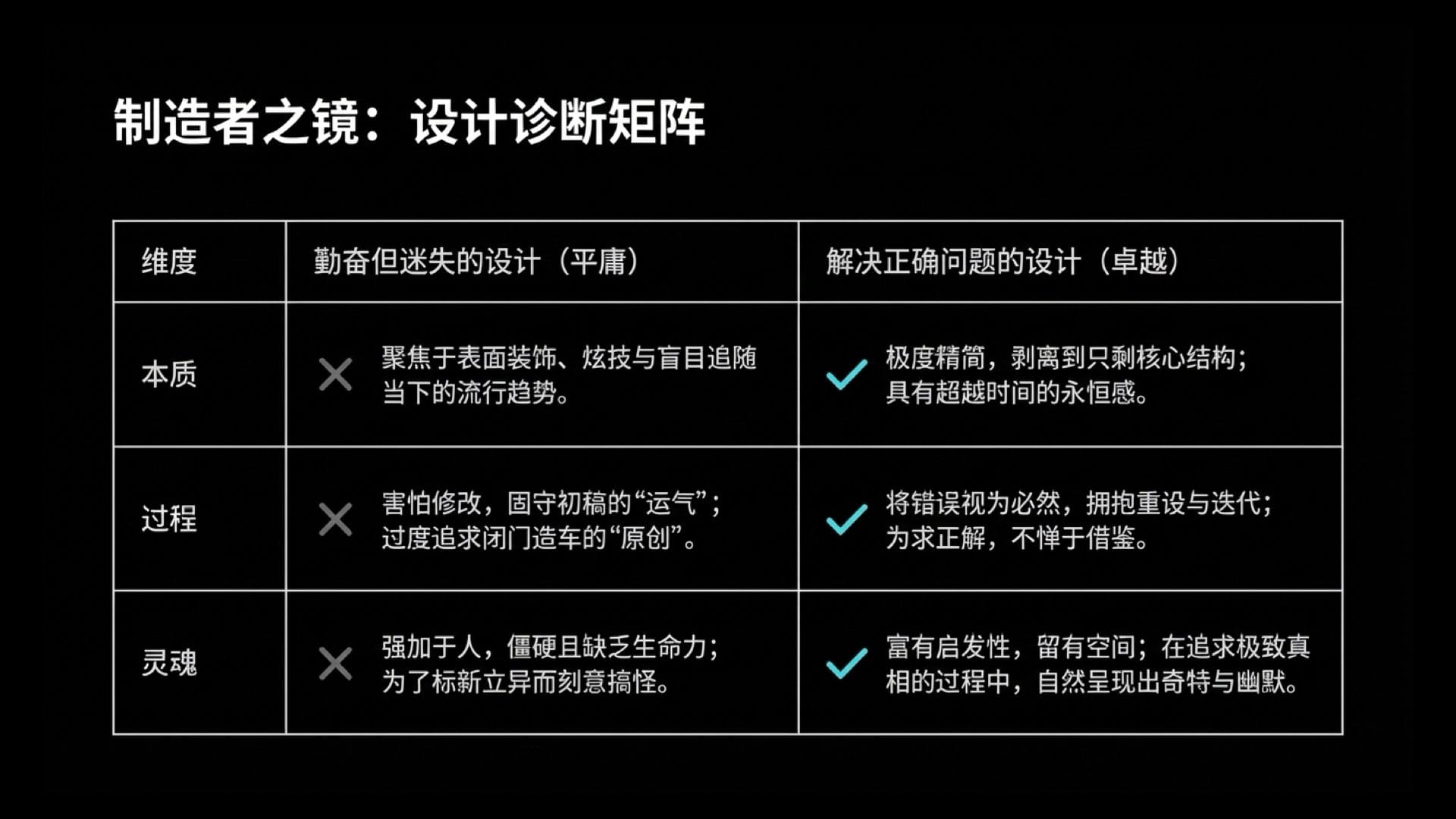

好的设计是精确的科学,不是玄学;美是一种跨学科的通用语言;品位可以训练,并且越来越值钱。

这一段是整场分享精神上的根基,也是 Indigo 自己去年一整年总结出来的关键词——Taste。内容 Based on Paul Graham 2002 年那篇《Taste for Makers》,但加入了大量自己这两三年的案例。

第一个直觉:品位不是个人偏好。

"如果品位只是个人偏好,那'更好'就不存在了。"

任何人都可以定义自己的"更好",但这个世界里确实有一些事物比另一些更好——更高效、更对称、更精准、更简洁。品位的训练,就是去发现所有工作中那种共同的"美"。

第二个直觉:美是一种通用语言,跨界共词。

最优雅的数学公式(E=mc²)、最高效的工程结构、最精准的构图,背后是同一种东西。Transformer 这个架构本身就很美——它简单,注意力机制简单,表达方式简单。"如果说有下一个能够替代 Transformer 的更新架构,它应该也是很优美的。"

他还顺势讲了为什么意大利人——尤其是佛罗伦萨人——做设计特别厉害:从小的美学训练。文艺复兴就是从那里开始的。这种品位训练是可以传递、可以习得的,不是天赋。

第三个直觉:好的设计揭示事物的本质,且必须迭代而成。

很多人误以为第一次发明的东西就是最优的,其实不是。"就像苹果的设计一样。" 真正好的产品都是迭代出来的,第一版往往笨重复杂,是因为人对底层物理理解还不够通透——理解通透之后,设计会自然趋近简洁。

他把这个原则应用到 Tesla 上,这是整段最精彩的部分。

Tesla:物理世界 AI 时代的 iPhone

Indigo 给出了一个非常清晰的类比:

"Apple 是个人消费电子时代最优雅的一家公司,软件硬件完全统一……Tesla 可能会成为智能时代或者太空时代——如果说 EV 电动车只是序章而已——最 Elegant 的一家公司。它自己解决所有问题,端到端解决所有问题。"

在物理世界的 AI 时代里:

他特别提到 Raptor 引擎从 1 代到 3 代的进化——"越来越 Elegant、越来越简单"——验证了"所有好的设计,会越来越简单,会越来越漂亮"这个原理。

他甚至顺势抛出一个比喻:人类最终发明的电子设备,可能会简单到像刘慈欣笔下三体人的"水滴"——所有东西都塞在一个最优雅的晶体结构里。"大自然其实已经给我们设计好了最优雅的结构,我们只是慢慢地用一些很丑陋的工业方式,向大自然致敬而已。"

这段话不只是审美抒情,它是后面所有结论的隐喻基底——简洁、端到端、优雅,是判断一家公司是否在正确轨道上的元尺度。

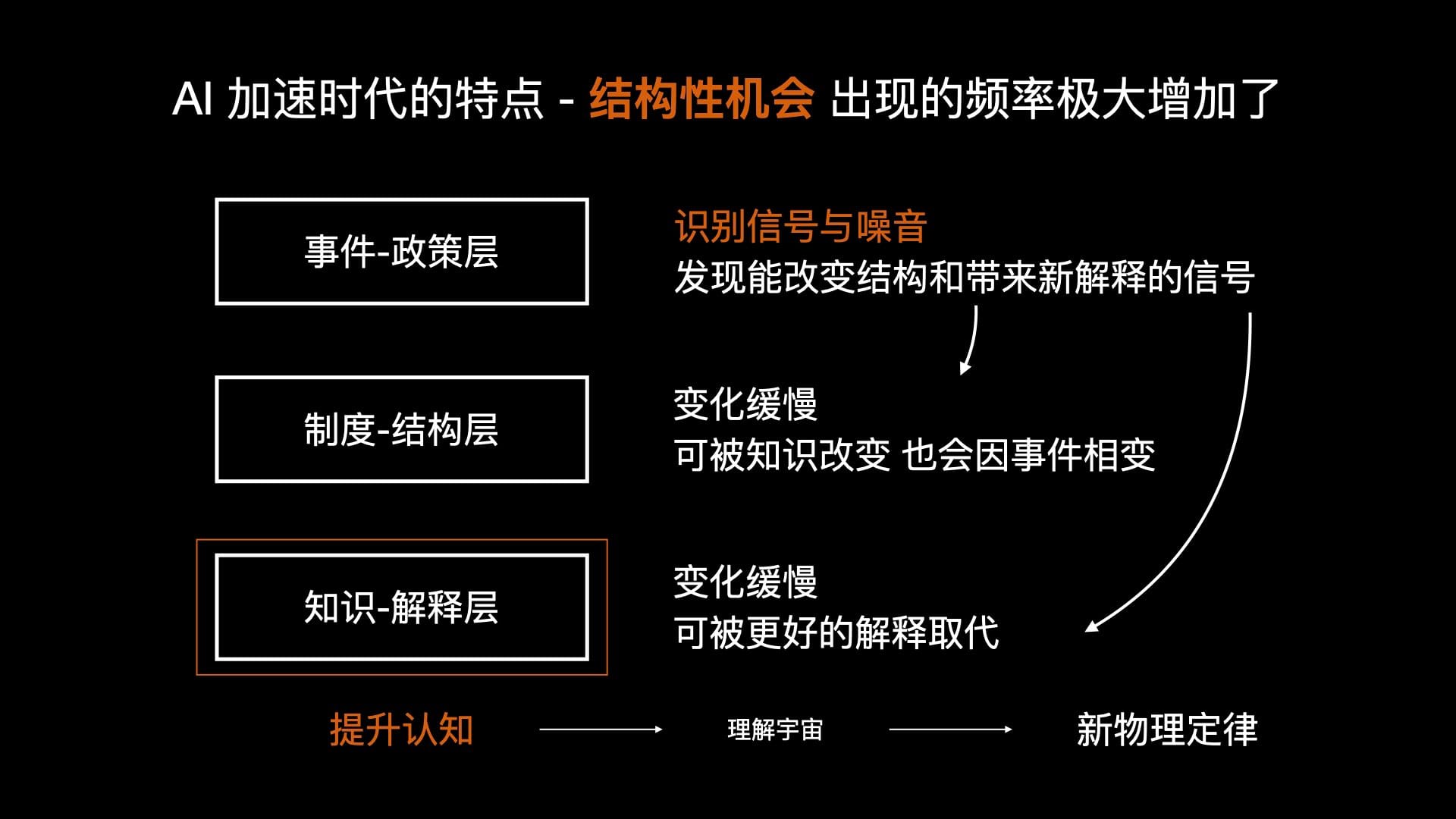

AI 时代的最大特点是结构性机会到处都是,但要分清三个层次——事件层(基本是噪音)、结构层(信号)、解释层(最深层、最慢、最致命)。

这是一段方法论。Indigo 分享了他自己设计的判断框架:把每天的信息流分成三层。

事件层(大部分是噪音):川普的行政令、各国摩擦、股市每日波动、推文政策——基本上"特别是川普周末发的东西,你把它当噪音看就好了,你要是按照那个来炒股,会被炒死。"

结构层(信号):会真正改变行业格局的东西。他举了三个正在发生的例子:

第一,国防体系在重构。伊朗的低空无人机让 Patriot 这种传统防御体系暴露弱点,美国、乌克兰、以色列都在升级反无人机能力。武器升级周期是几十年的事情,这一波不是一次性机会,而是结构性的长周期重置。

第二,数据中心 + 能源 + 太空的连锁反应。"美国现在 40% 的在建数据中心都在被反对、被驳回了。" 居民抗议、地方政府否决、电网吃紧。Elon Musk 的 xAI 数据中心干脆把 Tesla 电池运过去自己发电——临时解法。但更深的连锁是:地面不安全(俄乌冲突里数据中心都在被轰炸),那么太空数据中心的可行性就会被重新认真讨论。SpaceX 上市预期叠加这个趋势,太空领域会变得很热。

第三,半导体把软件的 Margin 全部吃掉。这是他在湾区那站后专门补充进来的结论。

"半导体会把软件的 Margin 全部吃掉。这是我第一个结论。所以半导体现在非常强势,软件非常弱势。股市上已经给出信号了。而且它还会更强,软件会更弱。这个趋势会持续到所有的软件只变成 Infra 了之后,没有逻辑层软件的,这个转换才会停止掉。"

Workday 已经被深度抛售,中等体量的软件公司都在被市场抛弃(拿 Workday 举例子因为现场有位来自 Worksday 的同学)。

解释层(最慢,但威力最大):新物理定律、新生物学发现、新科学范式。这一层平时几乎不动,但一旦动了,就会反过来推翻上面所有层。AI for Science 正在加速这一层——核聚变、量子比特稳定性、生物材料合成——一旦在两年内某个方向出现真正的突破,整个行业会被"重新推倒"。长期投资必须从解释层往上反推,而不是从事件层向下追噪音。

软件市场只有 1 万亿,劳动力市场是 80 万亿。AI 不是上一轮互联网的延续,而像电力时代——它要重写的是全部的人力分工,而不只是某种生产工具。

他用了一个非常关键的历史类比:电力发明之后,整整 20 到 30 年企业效率没有提高——因为大家"用法不对",只是把电机替换原来的蒸汽机,没有重组生产流程。直到福特把自动化生产线发明出来,电力才真正重塑了工业,也才催生了 30 年代的大萧条。

"我们现在 AI ChatGPT 比如说三年吧,五年,我们还没有自动化生产线,这个东西都还不存在……现在只是刚看到一点端倪,2026 年 AI 能够这样工作了,Agent 能够这样工作。后面大规模自动化再来的时候,那就是组织全部解体。"

随之而来的,是他对就业时间表的一组锋利预测:

"现在这点抛售才只是前菜,整个市场会产生很大的一个调整。"

他做了一个不轻松的对照:1930 年代的大萧条,是工厂工人被流水线替换;这一次,是趴在电脑前的白领被替换。"过去 30 年白领,在做电脑前面,你真的没工作了,那就是大萧条。" 但和上次不同,现在政府有央行、有救济机制、有 UBI 工具,可能不会演变成全球性战争。他给出的真正下跌时间点是:可能在 2027 年。

这一段他罕见地用了一句黑色幽默:

"当然大家如果准备好资金,可以做空人类,就能赚钱。"

把 AI 时代的投资版图分成五个垂直层次——能源/材料、算力基建、模型/全栈、应用、前沿探索——并按 2026–2029 年的时间窗口决定权重。

Indigo 把他这一年实践下来的投资框架画成一个分层结构,命名为 Rewired Index。重点配置在底部三层。

第一层 · 能源与材料(最底层):核电、稀土、金属。"在稀土上面,还有一些机会的。"

第二层 · 数字资产与基建:NeoCloud(Crusoe 这种 AI Factory)、数字金融基础设施、Bitcoin。注:Bitcoin 现在因为资金被 AI 吸走,短期表现一般,但长期没有问题。

第三层 · 全栈 AI 公司(核心层、压舱石):Tesla、Google、NVIDIA、Anthropic 这种从自研芯片→模型→应用全做的公司。Tesla 把"应用"直接交付为电动车和机器人,没有走软件路径;Google 全部交付软件。

第四层 · 应用层:自动驾驶、AI 制药、先进制造。先进制造在美国正变热,因为美国本来没什么制造业。

第五层 · 前沿探索:量子计算、太空。最长周期。

按时间分配:2026–2029 这几年,重点应该都在前三层(基础模型、算力工厂、基建),少量布局机器人、Defense 和已有成熟商业模式的 AI 应用。 如果你只把注意力放在第四层 App,多半会被前三层的扩张碾过去。

他还讲到 Rewired Index 已投的若干案例(私募市场可见的趋势):AI、太空、国防三大主题之外,还有一些金融基础设施和极少数 AI 应用(Harvey、Lovable、Eleven Labs)。"AI 应用特别少。"

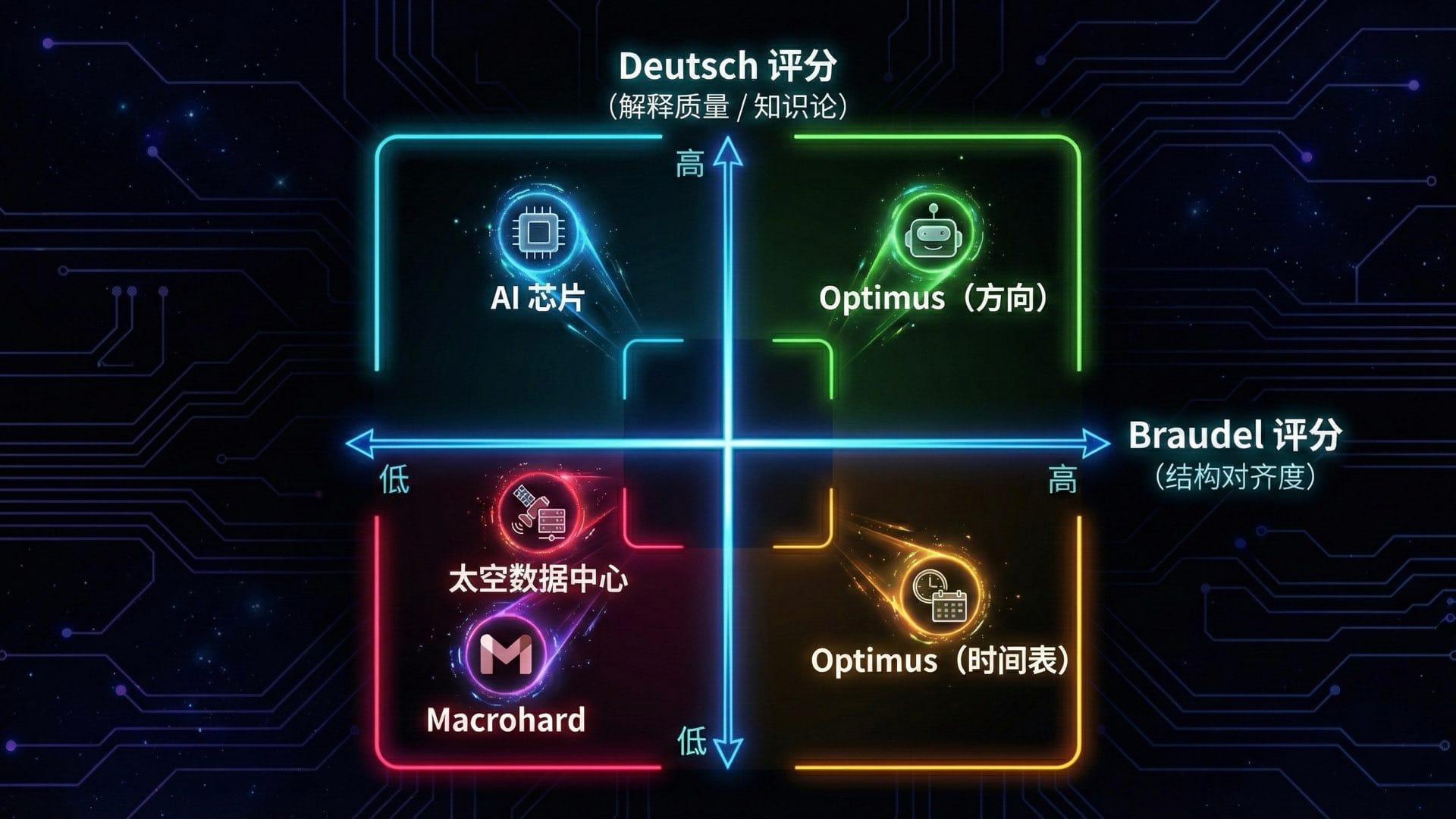

Tesla 是物理世界 AI 时代最优雅的全栈公司;Elon Musk 的方向几乎全部正确,但低估了社会适应的摩擦力。

这一大段是分享中信息密度最高的一节,Indigo 把他对 Tesla 的看法摆得很全面:

业务结构:硬件 Margin 薄、竞争激烈,真正决定股价上行空间的是两件事——FSD(Full Self-Driving)订阅、Robotaxi/Cybercab 运营。MegaPack 储能业务被市场严重低估,是高增长高毛利的隐藏引擎。Optimus 机器人从 2021 年的"演员套装"到 V3,迭代节奏在加速。Cybertruck 在他看来甚至像是为月球和火星设计的车——上去机器人就能直接干活、采矿。

对 Elon 的判断(用 David Deutsch 解释层 + Braudel 长波框架):

他甚至顺势谈到 Apple——Apple 错失了消费电子时代到 AI 时代的过渡。Apple 的所有电子设备都堆叠到一个 OS 上,但 Tim Cook "可能不一定能做这个事情,但 Apple 现在错失了 AI 时代的机会"。Apple 现在几乎没有真正自研的 AI 模型 (云端 + 端侧) 能拿出手。这是 Tesla/SpaceX 阵营的机会窗口。

他也顺手回顾了那本《奇点临近》(Ray Kurzweil)——预言时间是 2045 年,Indigo 翻译过那本书。"2045 年我们就完全这些事情全部躺平、全部就解决了。" 我们这一代人,按"每多活一年就能延长一年寿命"的乐观推算,只要活过 2032 年大概就能赶上这趟车。

他还推荐了一款叫《戴森球计划》的中国独立游戏(重庆团队做的)——把整个文明走向 II 级、III 级文明的产业链都演练了一遍:从挖矿→生产线→芯片→新智能→防御系统→星系级扩张。这种科幻感不是空想,而是这套投资框架向远端延伸的自然结果。

从面向文件的编程到面向 Agent 的编程,软件的"逻辑层"在消失,但"基础设施层"在爆发——Agent OS 会催生一批全新的软件公司。

这一段是 2025 年 10–11 月 Claude Opus 4.5 出现之后整个产业链的真实变化。Indigo 把它直接称为"结构性变化"。

编程范式从 Cursor → Claude Code 切换:以前是面向文件改代码(Cursor),现在是面向意图驱动 Agent(Claude Code),用户根本不关心代码本身的样子,只关心结果。

"软件没有死,但是软件的形态变了。原来的逻辑层在消失,但是基础设施层(Agent Harness)在爆发。"

他举了两个明确推荐的公司(明确说"我没有推荐股票"):

"你可以把现在的语言模型想象成电脑里面的 CPU,但是主板、机箱、内存都得有人做,还有接线的东西都得有人做,最终包成一个产品给人用。"

面向模型编程(Programming for Models)这个新概念也在这一段被点出来:

"现在耗的内存没关系,下一代模型上了之后,把程序给你改了,内存节省了。所以说我们就是面向模型编程。我现在先把它做出来,然后我等半年之后或者一个季度之后,模型升级一个新版本,模型把这个代码给我重写一遍。你只需要现在把你现在的对话记录保存下来就好了。所以说现在很重要的,你的 Prompt 资产,是最重要的东西。"

这是一句颠覆很多老程序员直觉的话——你跟 AI 的所有对话记录,比你写过的代码本身更值钱。"未来没有静态的系统,都是动态的,永远都是动态的系统……我们用的软件都是一个概率系统,如果你想 100% 确定,那你就让概率系统去调用那个 Harness(中间那一层代码层)就好了,剩下的全部都由 AI 来做。"

信息路由——统治了人类社会 2000 年。到 19 世纪有了普鲁士军团这个'军团式管理'是最发达的时候,二战、一直到现在,组织都是这样子的。那么现在的破局点就是:系统具备了全盘的协调能力。一个 AI Agent,它在中间,它能够领导所有的事情。

Jack Dorsey 的那条短视频给了一个标志性瞬间:他试着让公司 6000 人直接给他汇报,中间的协调全交给 Agent。Indigo 觉得 Elon Musk 接下来一定会做同样的事情——以他现在的精力,所有人都直接向他汇报,中间由 Agent 做翻译和分配。

最终决策者甚至可能不是人:

"因为我的意图是要公司赚钱,让我跟 AI 说'你让我公司赚钱',这个东西就是一个特别牛的——可能是以后你找 Claude 和找这种公司,租一个 CEO 级别的模型……你就给他一个考核:你今年要帮我,目标是 300 万美金。"

随之而来的是公司结构本身的二元化——一个公司只剩两种核心模型:公司世界模型和客户世界模型。Palantir 用 FDE(Forward Deployed Engineer,前线部署工程师)模式做的事情,本质就是替大组织建公司世界模型。Anthropic 让 Claude Code 进企业本质也是这件事。Indigo 提到自己以前做微博时一直想做"一种 Agent 驱动的、用来管理整个客户社群的 SaaS / CRM"——"现在还没人做。"

人将退到组织的边缘:

"当智能回归了中心,中间的 AI 协调之后,那人干什么?人就去边缘地带了。人就干——直觉、文化、信任博弈、谈判、伦理道德判断。我们人就做 Social,人就只干一件事情 Social。"

他甚至把这套判断带回了对孩子的建议——孩子刚上大学,他给的选学校标准是:"什么专业无所谓,选 Location,这个 Location 有最好的 Network,然后这个学校最 Social,教授都很活跃。"

联邦政府智商正在变低(人才都去硅谷创业了),但一旦某个国家的政府率先用 AI 接管核心职能,其他国家会被迫跟进;这套替换会从国防→社保→经济规划,一步步推进,可能比企业转型还快。

这一段算是整场分享里最大胆的预测。

"我觉得现在我们所有的政府,北美的、包括欧洲的政府的智商变低了,因为优秀的人才都不去政府了,优秀的人才都去硅谷了,都去创业中心,都去赚钱去了。它不像二战之后政府很厉害——那个时候打仗,最好的人才都给政府服务,美国才有了 DARPA、NASA。你现在 NASA 根本赶不上 SpaceX。你看他做的那个宣传片发火箭,Artemis 那个就像八十年代的宣传片发出来。"

这其实是把"创造者品位"那一段的判断带回来了——一个组织的审美水平揭示了它对底层物理的理解水平。Artemis 和 SpaceX 的视觉差距,本质是组织能力的差距。

他给出的政府演化路径:

"可能我们的政府的变化比企业还快。"

"一旦一个政府这样做了,其他政府又要效仿……欧盟不吓死了吗?……中国政府也会这样的。"

由此他衍生出对未来公司形态的科幻式描述:政府发"特许经营牌照"给个人和企业,拿到牌照的人才有资格租用 AI 模型和机器人公司,并且必须雇用一定数量的人类。其他人靠 UBI 或娱乐生活。

AI 重组之后,公司里只剩三种值得长期投入的角色——垂直专家、跨领域协调者(挖坑的)、Player Coach(教练)。

Indigo 把未来的人才地图直接说得很清楚:

"组织就很简单了,没有各种职位 Title。"

这三种角色的共性是它们都不是被 AI 取代的——它们恰恰是和 AI 互补的环节。垂直专家的直觉、协调者的沟通信任、教练的人际传递,都是 AI 在 2026–2029 这个窗口内最难胜任的部分。

这也是 Indigo 自己做 Rewired 社群的真实目的——不是做企业,而是做一个 Community,让大家提前进入这三种角色之一,"先了解 AI,然后还有可以帮企业去做 Agent 的部署。"

AI 不是平权工具,而是极端放大器;未来世界会在杠铃的两端聚集,中间是死亡谷。

他先做了一个非常精确的描述:AI 是一面镜子。

"你怎么用它,它就更像你。你问的问题很傻,它就很傻;你问的问题很好,它就很好。因为它是按照你的这个平均水平——它是一个回归均值的模型。你一旦触发了它的一些条件的时候,它就很聪明;你总问得很傻的问题,它就很傻。所以高手就能把 AI 用得很好。"

由此分化出两端:

杠铃左端:把 AI 用得最好的高手——最强的创业者、最强的律师、最好的创意人、最有结构的研究者;他们会被 AI 放大成 10 倍乃至 100 倍生产力。

杠铃右端:完全自动化的中位生产者——比如自动化律师事务所,公司注册、合同起草都不用人,"不用什么人做的,都是由自动化的工具,你先不用找律师了。"

死亡谷就在中间:

"你没法掌握 AI,你又没法让 AI 全自动化,那你就是死亡谷,就要玩完,所有公司都玩完。"

"这一次重构,不会有官方宣告,但我在宣告。"

更重要的是,他明确指出转换比想象的更快:客户对自动化服务建立信任,平均只需要"两三次账单"——也就是几个月、最多两三年——一旦发生,转换是雪崩式的。

整场分享的真正落点也就在这里——你来听 Rewired 社群分享,是因为你不想留在死亡谷里。要么成为 Vertical 打通者,要么成为 Coach,要么成为最早把 AI 资产化的高手;中间路线没有出路。

这套框架在不同时间尺度上呈现出的一致性——它们不只是一组观点,更像是同一个底层宇宙观的不同切片。

第一,"美 = 简洁 = 揭示本质"这条线,几乎贯穿全场。从 Transformer 的优雅、到 Tesla Raptor 的迭代、到 SpaceX 与 Artemis 火箭的视觉对比、再到联邦政府的"智商下降"——Indigo 实际上在用同一把尺子在量公司、组织、国家:你的设计有没有趋近本质?如果还在变得更复杂、更冗杂,那大概率是你对底层物理的理解还不够通透。这个框架的强大之处在于,它不需要你看财报,只需要你看这家组织最近一年发布的产品形态——简洁度本身就是信号。

第二,他在悄悄讲一个人类历史上罕见的"反层级化"故事。罗马军团式的层级管理统治了 2000 年,是因为信息只能通过中层一级一级路由。Agent 出现之后,第一次有了一种新型协调器,可以跳过中层、把意图直接转化为分布式执行。这件事的影响远不止 Meta 扁平化——它意味着,未来五到十年我们会看到大量传统组织的"中层"(管理者、协调者、流程岗)整层消失。社会结构、政治结构、教育体系,都将被这个新协调机制重新塑形。Indigo 给孩子选大学的建议——"选最 Social 的"——其实是这个长波趋势的一个非常具体的应用。

第三,"做空人类"这个玩笑话背后是认真的命题。如果你相信他对 2026–2028 年时间表的判断,那么过去 30 年构成中产阶级安全感的几乎所有东西——大学文凭、稳定的白领岗位、阶梯式晋升、年功累积——都会在两三年内失效。重要的不是焦虑,而是认真地问自己:我现在每天做的事情,五年后还有人付钱吗?如果没有,我应该怎么把自己迁移到杠铃的某一端?这是一个比"AI 焦虑"严肃得多的问题,它要求你把整个职业生命周期重新规划一遍。

第一,所有 Apps 都会被模型吃掉,存活的只剩两端。要么小到不在模型射程之内,要么大到自己就是端到端的全栈玩家。不要把钱和时间放在中间体量的纯应用层。

第二,半导体会把软件的所有 Margin 吃掉,直到软件全部变成 Infra。这是当前股市表现背后的结构性原因,也是未来 2–3 年最可靠的投资信号。

第三,AI 不是工具,是劳动力市场——80 倍的 Gap。这一次的变化和电力时代同等量级,不是互联网式的延续。所以投资和创业都要按 80 万亿美元的劳动力市场来重新建模,而不是按 1 万亿美元的软件市场。

第四,最值钱的资产是你的 Prompt 资产。代码可以由下一代模型重写,但你跟 AI 的对话记录、你提取出的意图、你训练好的工作流,下一代模型上来时会被自动放大。从今天开始把这些当资产存好。

第五,准备成为杠铃两端中的一端——要么成为 Vertical 打通者、跨领域协调者或 Player Coach 这三种新组织角色之一,要么成为完全自动化服务的提供者。中间的死亡谷,不会有官方宣告,但雪崩在悄悄发生。

"这一次重构,不会有官方宣告"

2026-04-07 15:08:18

本期邀请课代表立正(孙煜征)回归对谈。我们从 AI 带来的真实焦虑聊起——效率提升十倍,为什么反而更累了?为什么只用 ChatGPT 聊天永远解锁不了 AI 的生产力?Agent 的三大核心能力如何改变工作方式?Skill 为什么正在取代 MCP?大公司、AI 创业公司、传统中小企业,谁才是 AI 时代的赢家?当 AI 能复制你的技能,人的价值在哪里?我们聊到了组织变革、劳动力市场的结构性转型,最终落在一个浪漫的判断上:AI 不是工业革命的延续,而是第二次文艺复兴——成为自己,才是这个时代最大的护城河。

Apple Podcast & Spotify 播客| 小宇宙播客

嘉宾

课代表立正(孙煜征) - Superlinear Academy 创始人,康奈尔经济学博士、曾任Meta / Amazon / 腾讯数据科学负责人。

时间戳

关于课代表立正的「AI Builders」课程

AI Builders 是由课代表立正和鸭哥两位藤校博士主讲的 Top AI 课程,已经持续更新两年多,迭代12期,在Maven 上评分 4.9/5,累计学员3000+。

课程承诺一次购买,终身更新、终身答疑、终身社区。

解锁《INDIGO TALK》播客专属福利:

🔗 免费进群围观(开启终身 AI 学习计划)

🔗 编程入门课(0基础上手,萌新首选)

人民币折扣码 INDIGOAI(¥409 → ¥249)

美金折扣码 INDIGOAID ($59 → $29)

🔗 主课 Bundle(全维度系统进阶)

人民币折扣码 INDIGO(¥7345 → ¥6745)

美金折扣码 INDIGOD ($1048→ $948)

这是一场关于 AI 时代个人与组织如何自处的深度对谈。Indigo 与课代表立正(孙煜征)——康奈尔经济学博士、前亚马逊/Meta/腾讯资深从业者、现全职经营万人 AI 社群 Superlinear——从各自的真实体感出发,聊到了一个核心命题:当 AI Agent 能复制你的技能并自主完成任务时,人的价值究竟在哪里? 他们给出的答案出人意料地浪漫——AI不是工业革命的延续,而可能是第二次文艺复兴的序曲。

AI 让你更快了,但并没有让你更轻松——效率提升带来的不是解放,而是更多的工作量。

对谈从一个非常真实的感受切入。Indigo 坦言,从 2025 年 11 月到 2026 年初这几个月,AI 的能力飞速发展——Claude Opus 4.5 的发布、Claude Code 和 Agentic 工作流的成熟——让他觉得"一下子把很多之前没法做的工作都能串起来做了"。Code 的能力加上 Agent 的执行能力组合起来,使用得当可以带来十倍速的提升。

但十倍速的代价是什么?Indigo 说出了一句扎心的话:"我因为速度变快了,我就更累了。" 这正是经济学中经典的杰文斯悖论(Jevons Paradox)——当某种资源的使用效率提高时,人们不会因此减少使用,反而会因为成本降低而大幅增加使用量。你的成本下降了,你能干的事更多了,然后你就更累了。

课代表对此深有同感。这不是个别现象,而是所有深度使用AI的人都面临的困境。效率的提升不会自动带来悠闲的生活——它只会重新定义"正常"工作量的基线。

如果你和AI的交互仅限于聊天窗口的问答,你永远无法真正解锁 AI 的生产力。

课代表抛出了一个颇具争议的主张:"想用好 AI 的第一步就是要戒掉ChatGPT。" 这并不是说 ChatGPT 不好,而是说纯聊天式的交互方式本质上就是一个受限的交互模式——就像汽车刚发明时,英国法律要求每辆车前面必须有一个人举着旗走在前面引路。车明明已经可以跑很快了,非要一个人在前面领着走,当然跑不快。

Indigo 的观察更为细致。他发现大约 90% 的人把 AI 当搜索引擎或问答机器用——聊一两轮就走了,得到一个简单答案就结束了。可能只有 5% 的人会想到"我有很多任务,能不能让 AI 帮我做一下"。

这个门槛看上去很低——下载 Cursor 或 Claude Code,告诉它你想做的事情,发现它真的帮你做出来了,门槛就跨过去了。但实际上,大多数人跨不过去。原因很简单:大家天然对编程有恐惧感,看到命令行界面脑子就炸了。课代表说得很通透:"只要跨过去的人都会觉得,哇,原来这个门槛这么低。但是没跨过去的人就会觉得,哇,这个门槛好高。"

Indigo 自己就是一个有趣的案例。他以前做过编程,对命令行界面没有任何障碍,但因为日常工作不需要写代码,之前用 Claude Code 不多。后来他发现,用 Claude Code 不一定要写代码——让它帮做总结、写文章,在一个工作目录里面操作,效果反而比纯聊天好得多。但他也指出,"很多人连工作目录的概念都没有"——只知道电脑桌面,桌面上乱得一团糟。手机用久了之后,这个概念更加稀薄了。

Agent区别于ChatGPT的核心在于多步决策、自我迭代、调用工具——所有后续的发展都是围绕这三个能力在深化。

课代表从头梳理了 Agent 的发展脉络。2024 年底是Agent大爆发的时候——Devin 率先出场,Cursor 紧跟推出 Agent 模式,Manus 后来被 Meta 高价收购,Lovable 等工具层出不穷。整个 2025 年,Agent 的发展极为强劲。可以说,"AI 真正从一个聪明变得有用,都是靠 Agent 的发展。"

那么 Agent 和 ChatGPT 的核心区别是什么?课代表总结为三点:多步决策、自我迭代、调用工具。因为它可以调用工具来学习和完成任务,而且可以执行很多步,在过程中看到自己做了什么、错在哪里,做得不好时能想一个新方法做得更好。这三个能力让Agent可以完成真正复杂的工作。

从这个角度出发,无论是 MCP(Model Context Protocol)、Skill,还是最新的Harness Engineering 概念,本质上都是在为 Agent 创造更好的环境——让它更好地使用工具、更好地多步决策、更好地自我迭代。"原理从头到尾都没有变,只是大家做的越来越深。"

Skill 本质上就是给 AI 的 SOP(标准操作流程),和老板们给员工写的工作手册没有本质区别。

课代表对 MCP 给出了一个颇为直率的评价。MCP 的理想很美好——用统一接口让Agent 可以调用各种工具。但实际上,MCP 是一个非常理想化的协议,它试图把所有工具都变成上下文喂给大模型,这个过程中有很多不精确、不可控的东西,debug也非常困难。所以后来大家用 MCP 就越来越多地在做"hack around MCP"——绕着MCP 的限制走,而不是走它本来设计的路线。

直到 Skill 出来——一个更精确、更有效的调用方式——很多人迅速扔掉了 MCP 转向Skill。

但 Indigo 对 Skill 的解释才是最接地气的。他把 Skill 比作企业的 SOP,这个比喻一下子就把看似高深的技术概念拉到了每个人都能理解的层面。你开一个餐厅,招一个厨师,SOP 要有吧?进门先洗手,锅怎么放,最后怎么收拾,离开时先关灯再扔垃圾,垃圾扔到哪。这完全就是 Skill。一个做得好的 SOP 是不会出错的——无论任何一个员工过来上岗,跟着这个 SOP 就能把任务完成得非常好。

关键转折在于:以前读这个"入职手册"的是人,现在变成了 AI Agent。同一个手册,给人看也行,给 AI 看也行——但AI看了之后执行得更好、更快。

Indigo 分享了一个生动的例子:他把自己即将出版的新书《真本事:从会工作到会赚钱》喂给 Claude,让它转成一个 Skill。半小时后,AI 就把整本书的原理抽象消化,变成了一个可以辅助工作和赚钱决策的可复用框架。

课代表补充了一个重要观察:不同模型对 Skill 的理解能力不一样。模型越强大、训练得越好,对 Skill 执行得越好。就像招员工一样——同一个工作手册,给聪明的员工你更多要求结果、不会太固定动作,给能力一般的员工你会多固定步骤"必须做12345"。

大公司短期受益于分发护城河,AI-native 小公司效率恐怖但缺分发,传统中小企业将迎来迟到的数字化转型红利。

课代表从业务、人才、组织多个维度拆解了不同类型企业在AI时代的处境。

第一种:科技大公司——短期最受益,但组织效率是软肋。 AI 目前本质上是一个增强型技术(Enhancing Technology),你得有现有业务去增强。Google Search 看似被AI冲击,但其实搜索结果变得更好了,Google Docs、Google Meet、Google Slides都因为AI变得更好了。大公司还有人才储备的优势——课代表的课程给腾讯、1Password、DoorDash 等做企业培训,发现大公司的人在使用 AI 上其实比较深入,思想转变也特别快。腾讯作为世界最大的游戏公司,拥抱 AI 非常深,恨不得所有能用 AI 的都用 AI。但有意思的对比是,美国的游戏公司普遍反对 AI,使用方式还停留在 ChatGPT 复制粘贴。

不过,大公司最终可能面临被颠覆的命运——只是时间线可能是几年甚至更长。

第二种:AI-native 创业公司——效率极为恐怖。 课代表透露,他们在做企业培训时接触到一些非常 AI-native 的公司,这些公司的策略很直接:先给员工培训,能做到"AI Conductor"(AI指挥家)的留下,做不到的全走。他们不要写代码的工程师了——"因为他们觉得代码这个东西不需要真的工程师去写了。" 这样的公司没有历史包袱,结构扁平,人和Agent沟通替代了人和人沟通,效率在局部业务上"吊打大公司"。

课代表用了一个生动的对比:你要么可以开个会讨论产品该怎么做,要么你可以直接把产品做出来——"干嘛要开那个会?"

但大公司有现成的分发渠道(distribution),这是小公司短期内难以逾越的优势。课代表用 Gamma(AI 驱动的演示工具)举例:Gamma 做得再好,也不能在短时间内击败 Google Slides,因为 Google 只要在 Slides 里出一个AI功能,第二天大多数用户都会看到。

第三种:传统中小企业——迟来的数字化转型红利。 这是课代表最有感触的群体。他认识一个亚马逊的 Principal Engineer,辞职后去帮 farmers market 做软件和物流系统。AI 出来后这位朋友非常开心——"我之前能做的东西这么少,现在能做这么多。"

背后的逻辑很清晰:大多数传统企业从未真正经历过数字化转型,因为程序员太贵了。你想做一个有效的数字化管理转型,可能得招十个程序员——哪有几个中小企业负担得起?所以它们只能去买SaaS,共享一个逻辑层。但现在,每个中小企业都可以用AI Agent配一个经过培训的AI Conductor来干这件事,实现自己流程定制化的SaaS。

这意味着 SaaS 市场将被分解——有些可能不存在了,有些往后端 Infra 走了,有些则去赋能那些 AI Conductor。

高价值工作岗位自 1980 年后就一直在减少,AI 加速了这个趋势——但人类总会创造新的需求和新的工作。

Indigo 分享了一个耐人寻味的数据:从美国的研究报告来看,科技进步实际上从1980 年后就在让高价值工作岗位持续减少。只是这些岗位的工资在不断上涨——硅谷程序员从90年代到2000年后赚了很多钱,但整体岗位数量是在减少的。

课代表补充了 Naval(纳瓦尔)的经典论述:代码和媒体是两个最好的杠杆。一方面是自动化完成工作,一方面是传播影响别人。而这一次 AI 带来的冲击在于——这些自动化的工作都不用人来驱动了,AI Agent 能够复制你的技能然后自己完成。那人要做什么?价值更高的工作:抽象、想象力、创作。但这些岗位的需求其实变得更少了。

不过课代表讲了一个很有温度的故事。2018-2019 年在亚马逊的 All-Hands 上,Bezos 被问到是否担心人类未来没有工作。Bezos 的回答是:有一个工种叫"给狗做发型"——你 100 年前跟一个农民说这世界上有这个工作,他肯定觉得你神经病。但现在它是一个高薪职位。人类总是会创造出新的需求和新的工作。

Indigo 对此的态度是:冲击肯定会有,中短期会很大,但长期他是乐观的。他更想指出的是一个底层逻辑的变化——"我们现在的思维模式是被工业时代塑造的,劳动创造价值、提高生产力。我觉得很快我们这个时代就过去了,智能时代不是这样子的。" 意义是什么,比效率是什么,可能更重要。

旧的组织形态是为上一代生产力设计的,新的生产力一定需要新的组织形态。

Indigo 抛出了一个从实践中得来的洞察。他在一个上千人的组织中真实部署过 AI,发现 AI 提效真正面临的是组织结构的问题,而不是工具的问题。

课代表的分析更为犀利。他指出两个核心观察:

第一,大多数企业的问题是"人多事少"。AI 提高了生产力之后,事更少了,但人还是那么多。人多的地方就有江湖——无意义的工作会被创造出来填补大家的工作时间:开会、对齐、计划、review…… 这些都是"创造出来的无意义的工作"。AI 提效之后,这些无意义的工作不但不会被取代,反而会变本加厉——因为没有人愿意承认自己的工作是多余的。

第二,生产关系必须适配生产力。在大公司里,你做一个东西难吗?早就不是了。人可能比事多十倍。在这种情况下,AI 只会让问题更严重。所以很多公司最终会选择一个看似粗暴但有效的方式:裁一半人,然后重新搞。

课代表提出了一个更根本性的观点:我们之前是按技能分工的——你是 PM、你是Engineer ——但现在技能变得极其便宜了,人应该按素质和专长去分工。审美好的去做 Designer 方向的 Builder,数据敏感的去看数据,有 Idea 的去出 Idea——但所有人都应该有 Build 的能力,整个团队要 end-to-end own 一个Product。

工业时代磨平个性,AI 时代释放个性——当生产被自动化,你的个体才是护城河。

这是整期对谈最动人的部分。

Indigo 引出了一个看似残酷的现实:当 AI Agent 替代了你的技能,人留下来的是什么?是 Intention(直觉)、Taste(品味)。用品味和直觉来划分人——这有点像DNA一样,有人天生审美好,有人天生数据敏感。

但课代表给出了一个完全不同的视角。他说:"我觉得这反而是一个回归人性的点。" 工业时代做的事情是什么?是把人的个性全都磨平,然后全都去打螺丝——全都是标准件,每个人都可以互相替换。一个 Designer 和另一个 Designer 可以互相替换。使劲分工,使劲标准化。

但在 AI 时代,这个逻辑彻底反转了。你的底子差,出来一个"特别丑的东西",说不定正好找到一堆喜欢这种特别丑的东西的人。这不是标准的好或不好——这是个性表达。

课代表用一个非常浪漫的类比把这个逻辑推到了极致——他把 AI 看作第二次文艺复兴。

第一次工业革命的整个体系,就是把生产尽可能标准化、流水化,从而最大规模地生产一模一样的东西,然后找最大的市场。要实现这一点,就必须抹平人们对需求的个性化要求。SaaS 也是同样的逻辑——一堆程序员写代码,给很多人用。

但现在这个逻辑都变了。每个企业都可以有自己的 AI 帮它写的软件,输出面向不同人群的、设计各异的东西,去匹配各种各异的人。完全定制化的时代到来了。

"我非常 hope 20 年后的世界会非常的丰富多彩。然后我们 20 年之后回看今天,我们会觉得——那个时候的世界非常的无聊,非常的平庸,充满了对个性的泯灭。"

这是一个极其乐观的判断:当生产被自动化的时候,分发是护城河,你的个体才是护城河,你成为自己才是护城河。

当 AI 在共识上做到极致时,只有非共识的东西才有价值——而社群正是非共识和人感的栖息地。

对谈的最后一个话题聚焦在社群的价值上。课代表的社群 Superlinear 刚发布了独立APP,拥有超过一万名成员,其中大量是硅谷大厂的核心技术骨干。

课代表提出了两个关于社群价值的深刻洞察:

第一,社群不受算法统治。在任何上了规模的平台上,哪怕买菜,Uber都要用算法推荐。算法有算法的偏好,但那不是人的偏好。社群里,大家可以摆脱算法,个性充分展现。

第二,社群承载非共识。AI 在共识(consensus)上可以做到非常优秀,但共识意味着不值钱,因为AI都能做好。只有非共识的东西——那些所有共识之外的观点和创作——才是下一个时代真正有价值的东西。社群正是非共识的培养皿。

从更现实的角度,课代表认为社群是学AI的最好地方。上一个课上完了,第二天可能就忘了,行为几乎没有改变。但如果身边的人全都在天天学 AI——小王今天用 AI 解决了问题,小李用 AI 干了一件事,小孙分享了一个 AI 见解——"你在这种地方你怎么可能学不好AI?" 社群改变不了你的物理环境,但它可以成为这样一个地方。

Indigo 把社群的价值上升到了更高的维度。他认为在 AI 越来越发达的世界里,人感(人的存在感和连接感)将变得越来越稀缺。Agent 越多,人类越稀缺,人感越稀缺。你每天一定要找到一个能够刷存在感的地方——不然人生就没有价值和意义了。

他在自己的社群里就能感受到这种人感——一个焦虑但一直在行动和分享的大叔,一个真实脆弱但充满动力的女生——这些人他都没见过,只看过头像,但人感扑面而来。

Indigo 甚至做了一个大胆预言:未来 3-5 年,AGI 诞生前后,小型社群将大流行。这不是因为社群是一个好的商业模式,而是因为人需要一个地方被连接在一起——"提供一些避风港,我们把一些人给连在一块,提供这种避风港。"

课代表最后分享了一个动人的个人故事。2023 年他写了那篇著名的"关于 ChatGPT 最重要的五个问题"之后,意识到自己的数据科学工作不会存在了。他第一反应不是焦虑,而是去想"什么工作会存在"。他甚至跟深圳一个餐厅老板谈好了技术转让、准备好了资金、跟家里都说了要开餐馆。后来一位朋友劝他,餐厅很难做出真正的差异化。于是他转向了社群——"在 AI 时代,有什么东西是 AI 拿不走的?有什么东西是很难被取代的?有什么东西有它的个性存在价值?社群就是其中之一。"

这期对谈表面上在讨论 AI 工具和技术趋势,但真正触及的是一个更深层的哲学命题:当机器接管了"做事",人的价值就必须从"做事"之外去寻找。这不是一个悲观的结论——相反,它可能意味着人类终于有机会从工业时代"打螺丝"的宿命中解脱出来,去追求真正属于个体的东西。

值得注意的是,Indigo 和课代表都不是纯理论派——一个在温哥华做投资和中小企业 AI 落地,一个在硅谷运营万人社群和企业培训。他们的判断来自每天和真实的人、真实的企业打交道的体感。当两个如此深度参与 AI 实践的人同时说出"成为自己才是护城河"这样的话时,这不是鸡汤,而是经过检验的观察。

关于使用 AI: 停止把 AI 当搜索引擎。下载 Cursor 或 Claude Code,告诉它你想做的事,让它帮你做出来。跨过这个门槛,你对AI的理解将彻底改变。Skill 就是给 AI 的 SOP——你已经会给员工写工作手册了,现在把读手册的"人"换成 AI Agent 就好。

关于职业发展: 不要再问"AI 会不会取代我的工作",要问"什么是 AI 做不好的"。答案是:非共识的创造、人与人的连接、品味与直觉的表达。未来的关键角色不是程序员,而是 AI Conductor——能编排多个 Agent 持续工作、推动业务的人。

关于企业战略: AI提效的最大障碍不是工具,是组织架构。旧的组织形态为上一代生产力设计,新的生产力需要新的组织。传统中小企业将迎来史上第一次真正的数字化转型机会——因为程序员不再昂贵了。

关于人生意义: 当生产被自动化,分发是护城河,个体才是护城河。工业时代磨平个性,AI 时代释放个性。找到你的社群,保持你的人感,成为自己——这可能是 AI时代最重要的生存策略。

2026-03-26 11:38:49

这期 Indigo Talk 邀请了 ArcBlock 的创始人老冒(@mave99a),一位在软件行业深耕二十多年的硬核工程师。他坦言 AI 编码能力已经全面超越人类,并在公司强制推行"零人类代码"规则。对话深入探讨了 AI 时代的编程方法论——为什么应该告诉 AI 你要什么而不是怎么做,为什么传统的 CI/CD 和 Code Review 正在失去意义,以及为什么后端比前端更容易被 AI 替代。从一人一产品的团队模式,到 SaaS 行业的颠覆,再到区块链作为 AI Agent 信任基础设施的未来图景,这场对话为所有 Builder 提供了一份来自实战前线的认知升级指南。

Apple Podcast & Spotify 播客| 小宇宙播客

老冒(冒志鸿)— ArcBlock 创始人兼 CEO,前微软工程师,2017 年创立ArcBlock,专注去中心化应用开发平台

这是一场让人不断被颠覆认知的对话。老冒,一个在软件行业摸爬滚打二十多年、自认"写代码是一把刷子"的硬核工程师,坦然承认AI在编程能力上已经"把我秒成渣了"。但这期节目真正有价值的地方不在于这个结论本身,而在于老冒从实战中提炼出的一整套与AI协作的方法论——从建筑设计的类比到Intent-Driven Development的提出,从团队重组的实践到对整个软件行业未来形态的判断。如果你是一个正在思考如何在AI时代重新定位自己的Builder,这场对话值得反复咀嚼。

今天的大语言模型在纯粹的编程能力上已经超越了任何人类工程师,这不是预测,而是已经发生的事实。

老冒开场就给出了一个让很多程序员不太舒服的判断。他说自己一直是个"蛮自负"的工程师,觉得编程水平不错,真刀实枪做过无数项目来证明自己。但到了去年,他不得不面对一个"很悲哀的事实":无论是编程、设计还是整个实现的水平,他已经完全不如 AI。

这个转折点大概发生在 Gemini 3 发布前后。而到了 Opus 4.6 的时代,老冒用了一个很形象的说法:"那绝对把我秒了,就是把我秒成渣了。"

更让人震惊的是他在公司里推行的 Hard Rule:过去三个月,ArcBlock产出了大量代码,但人类写的代码是零——一行都没有。"如果哪一个人还手写了一行代码,手写了一个 Check-in 的 Commit Message,他就有麻烦了,我得去找他。" 这不是一个实验性的尝试,而是一条强制执行的公司规定。

那些还觉得 AI 写代码不如自己的工程师,老冒的态度很直接:that's impossible,那只是因为你用错了,你不会用它。他打了一个千里马的比方——你有一匹千里马但骑不到千里,第一个要想的不是这马不行,而是你自己会不会骑马、马喂饱了没有。今天的 AI Code Agent 也是如此:当输出不好的时候,首先想的应该是"我错在哪里"。

老冒说到一个经典的程序员笑话:软件工程师是最好的 Husband,因为出现问题的时候,他们想的第一句话永远是"我错在哪里"。从当年程序 Crash了找自己的 Bug,到现在大语言模型输出不理想时反思自己的指令——这个思维习惯其实是一脉相承的。

AI Code Agent的架构能力已经是"神般的存在",但要让它做出一流的作品,你自己得有品位。这就像造房子——你不需要知道怎么设计,但你得有审美。

这一段是整场对话中最精彩的类比之一。老冒用 Indigo在 温哥华的房子举例:砖头水泥混凝土玻璃钢,材料就那些,但为什么有的房子一看就有Taste,有的土豪砸了更多钱却一看就没品?区别不在于材料和施工,而在于业主的审美和设计师的理解力。

软件架构也是同样的道理。老冒说,今天的 AI 用最好的模型(比如 Anthropic 的Opus 或 Codex),从变量命名到代码格式,到 Design Pattern 的使用,都是"非常优秀的水平"。但如果让它做系统架构层面的设计,那就"不仅仅用优秀"来形容了——"他是一个神般的存在"。

但这里有一个关键的前提条件:你得触发它。

就像一个顶级建筑设计师,他什么风格都懂——Contemporary、Mid-Century Modernism、Modern Farmhouse——但如果你什么都不说,他只能给你一个平庸的方案。当你告诉他"我不喜欢 Contemporary,太像水族馆了,我要 Mid-Century Modernism"的时候,他脑子里的画像瞬间就出来了,地中海式的、农舍风格的全部被过滤掉,精准匹配到你要的东西。

Code Agent 也是一样。你只要在 Prompt 里写上"我要写的代码需要风格优雅",它就能在高维空间里把"优雅"映射成具体的代码风格。如果你什么都不提示,完全有可能写出面条代码。提到 Design Pattern 的时候,老冒特别强调:"他用 Pattern 的能力是远大于人为的。"

这里老冒引入了一个非常有洞察力的解释:大语言模型本身就叫 Transformer——"我们就是干变形的,我们就是干风格迁移的。"它的工作方式本质上就是把一种维度升维、然后迁移到另一种维度。自然语言迁移成代码语言,一种风格迁移成另一种风格。只要训练数据足够,这个匹配可以非常精准。但你得告诉它:我想从A到B,这个A和B是什么。

当前流行的 Spec-Driven Development(SDD)是一个误入歧途的方向。真正有效的方法是Intent-Driven Development——告诉AI你的目标,而不是微观管理它的执行过程。

这可能是老冒在这期节目里提出的最具争议性的观点。现在 AI 编程圈子里很流行SDD(Spec-Driven Development),就是写一个非常详细的规格说明书,让 AI 按照这个Spec来执行。老冒认为这是错误的方向。

他用了一个 OKR vs KPI 的类比来解释。SDD 就像 KPI 文化——老板 Micro Management,规定你几点上班、销售怎么做、市场怎么弄。如果老板能力特别强,把 Spec 写得极其清晰,也许能挣到钱。但更大的概率是出现"KPI 做得极好,但干的事情没有任何毛用"的窘境。

而 Intent-Driven 就像 OKR——我的 Objective 是什么,Key Result 是什么,至于怎么达到,那是执行者的事。"我是个老板,我要赚钱。怎么赚钱?这事我不 Care。你这团队给我把钱挣回来就行了。"

老冒指出了 SDD 的根本问题:今天的大语言模型已经很聪明了,"它不是个牛马"。当一个智商可能不如AI的人类去写非常详细的Spec来指挥AI时,就像一个不那么聪明的老板在 Micro-manage 一群比他聪明的员工——那些员工(AI)会困惑:"老板怎么这么愚蠢?"

但老冒立刻补充了一个深刻的洞察:在大公司里,员工觉得老板愚蠢、老板觉得员工不行,大概率双方都不是真的愚蠢——根本原因是上下文丢失(Context Loss)。一个想法从老板的脑子里分解出去,到了执行者的上下文中,因为大量信息丢失了,看起来就变得"很愚蠢"。

SDD 的问题正是如此:你用人管人的方法去管 Code Agent,把任务拆得过细,每次拆分都在丢失上下文。而AI本身是一个"超级员工",比人的能力强100倍,根本不需要你去拆分任务。"你要告诉他我要什么,啪,做完了。怎么做的、怎么拆的,全部都想得一清二楚,比你想的还要清楚。"

Indigo 也分享了自己的实践验证。他在用 Claude Code 的时候有一次让它下载YouTube 字幕并转换成文章,完全没有告诉它具体流程。结果 AI 自己找到了GitHub上最常用的库,测试了哪些字幕可用、哪些不可用,确定了优先级——全部自主完成,而且比Indigo之前想的流程好得多。"如果说我之前还帮他想一些流程,你要这样做这样做,完全不需要。他可能比我想的好多了。"

老冒用一句话总结了这个转变的核心:"你要告诉他你要什么,别告诉他怎么做。"

善用 AI 的员工可以拥有 100 倍的产出,但用得不好,破坏力也是 100 倍。传统软件工程的 CI/CD、Code Review 等实践正在被颠覆。

当 Indigo 问到 AI 对团队结构的影响时,老冒给出了一个让人振奋但也让人警醒的回答。

他在公司里推行的原则是把AI当成"伙伴"而不是"工具"——拟人化地看待它。ArcBlock 现在的团队里"有一堆AI和一堆人"。如果配合得好,效率是惊人的:一个善于驾驭AI的优秀员工,产出是普通人的 100 倍,"而且还没有沟通问题"。老冒一个人就相当于有 100 个比他还强的人组成的团队,"就在现在,就是就在跟你说话,就我一个人",同时有 20 个 Agent 在并行干活。

但硬币的另一面是:一个糟糕的工程师如果用了 AI,他的破坏力也是 100 倍。过去一个差的程序员,因为有 Code Review,因为他本身干活就慢,破坏力是有限的。但现在每个人都能产出 100 倍代码量,一个直接的问题就出现了——代码的 Merge 变成了噩梦。"过去是 10 个接口对接一下,现在是 1 万个接口。过去我改了你 50 行代码,我们讨论一下;今天我给了你 5000 行代码,甚至 5 万行代码,你怎么弄?你根本弄不过来。"

正是因为这种认知,老冒在 ArcBlock 做了一系列"离经叛道"的决定。他在公司 Blog上分享了这些实践,评论的人都觉得"你这个想法非常离经叛道",因为基本上全部都是软件行业的 Anti-Pattern。

具体来说:他们撤掉了所有的 CI(持续集成),也不再做人类 Code Review。他的逻辑是:AI 写的代码已经经过了内部的自我测试和 Review 流程,几乎不可能出错。你用另外一套系统再验证一遍,结果当然是对的,这有什么意义?只会造成等待,变得更慢。"我的 AI 帮你 Review 你的 AI"——几十个 AI Agent 已经形成了一个自组织的 Team,有的在写代码,有的在做计划,有的在做测试,有的在做Review。

他还提到了每个产品"一人一产品"的模式。这个灵感来自一家叫 every.to 的公司——表面上是科技媒体,实际上是一家软件公司,9 个工程师做了 5 个产品,基本上一个人负责一个产品。老冒第一次看到时觉得"全部都是软件行业的 Anti-Pattern",但随着自己实践得越多,越觉得"这可能就是最对的"。因为当你自己已经是 100 个 Agent 了,再来另外一个人只会增加协调成本。

程序员这个职业会消失,但人人又都会成为程序员。真正的身份转变是从 Programmer 变成 Builder。SaaS 将被个性化软件颠覆,但大公司反而有更大的优势。

老冒花了很大篇幅来阐述这场变革对整个软件行业的冲击。他的判断出人意料地冷静和辩证。

首先是关于大公司。很多人觉得AI会让大公司被小团队颠覆,就像马斯克说要做一个 Macrohard 来替代微软。老冒认为这只对了一半:代码确实可以被替代,但微软还有大量的企业组织关系、已有的客户资源——这些不是代码能解决的。"从这个角度来讲,对微软这样的公司来说,实际上不是一个威胁,实际上是有更大的优势。"

他用了一个特别生动的比喻来形容这个行业变迁:从马车到重型卡车。历史上从马车到汽车,赶马车的人失业了。但汽车从汽车到重型卡车,赶马车的人也无法直接开重卡——这需要完全不同的技能。今天的AI编程也是如此:不是"马车变成了更快的马车",而是一种全新的物种出现了。

对于 SaaS 行业,老冒的判断更加激进。他认为会有一个短暂的窗口期,大量"优质价廉的老 Style 软件"涌现。一个一人公司确实可以做出秒掉五年前二三十人公司产品的软件。但这个商业模式不可持续——因为获客成本的增长可能比开发效率的提升还快。"以前市场上就 10 款软件,现在市场上有 1000 款软件。GitHub 的提交数飙升,iOS 的 APP 商店飙升,但你的推广渠道没变多,还变便宜了——实际上变得更差了。"

最终,老冒认为 SaaS 这种标准化软件形态可能会被彻底改变。未来每个软件都是个性化的——"我家里的软件和你家里的软件完全不一样,但它都能满足我们各自的功能"。SaaS 的壳(UI 和 Logic层)会被 AI 生成取代,而 Database 和 Infra 层仍然需要。

关于程序员群体的命运,老冒给出了一个温度很高的观察:关键不是 Coding 水平有多高,而是你对工程这件事有多热爱。"我在过去这几个月的时间里面,我找到了我在大学时代日以继夜写代码的那种感觉,而且比那时候爽得多。" 那些真正热爱软件的人,不管水平高低,都会在 AI 时代如虎添翼。但那些只是因为"软件行业有钱赚"而入行的人,挑战会非常大。

Indigo 帮老冒做了一个精准的总结:过去有 Designer、Programmer 这样的分工,现在统一成了一个词—— Builder。"你不管用什么方法去构建,构建者是一个特别适合这个时代的身份。人人都是程序员,程序员这个职业会消失掉,但人人又都成为程序员。"

社交媒体上流行"前端被干掉了"的说法其实是一种误解。对 AI 来说,设计数据库、网络协议、分布式系统比做网页要简单得多。

这是整场对话中最反直觉的一个论断。社交媒体上经常有人喊"AI 把前端干掉了",因为像 Gemini 3 这样的模型做前端看起来确实很炫。但老冒的观点完全相反——对今天的 AI 来说,设计个网页其实是最困难的事情。为什么?因为前端涉及到大量的审美判断、用户体验细节和视觉呈现的微妙之处,这些恰恰是AI还不够精准的地方——可控性没那么好。

而设计一个数据库、设计一个网络协议、设计一个分布式系统?"那是比做网页对 AI 来说简单得去了。" 因为这些后端系统有明确的逻辑规则和最佳实践,AI 学习起来更高效、执行起来更精确。所以老冒笑着说:"不要说什么前端被干了,后端早就被干的不成样子了。"

同时 Indigo 观察到一个有趣的就业市场数据:2025 年第四季度,美国开放招聘的程序员岗位反而变多了——在第三季度触底之后出现了一个拐角式的反弹。老冒的解释是双向运动:大厂确实在裁掉初级和中级码农,但市场上还有大量中小企业以前想都不敢想能雇一个工程师。"老板买了 3 个SaaS,想搞一个 AI 技能把 3 个 SaaS 组合起来定制化完成业务——之前绝对不敢想的。现在老板说我需要顾问,需要程序员,哪怕不全职也可以。"

也就是说,Builder 这个角色正在渗透到各行各业,帮助传统企业完成定制化的软件需求。

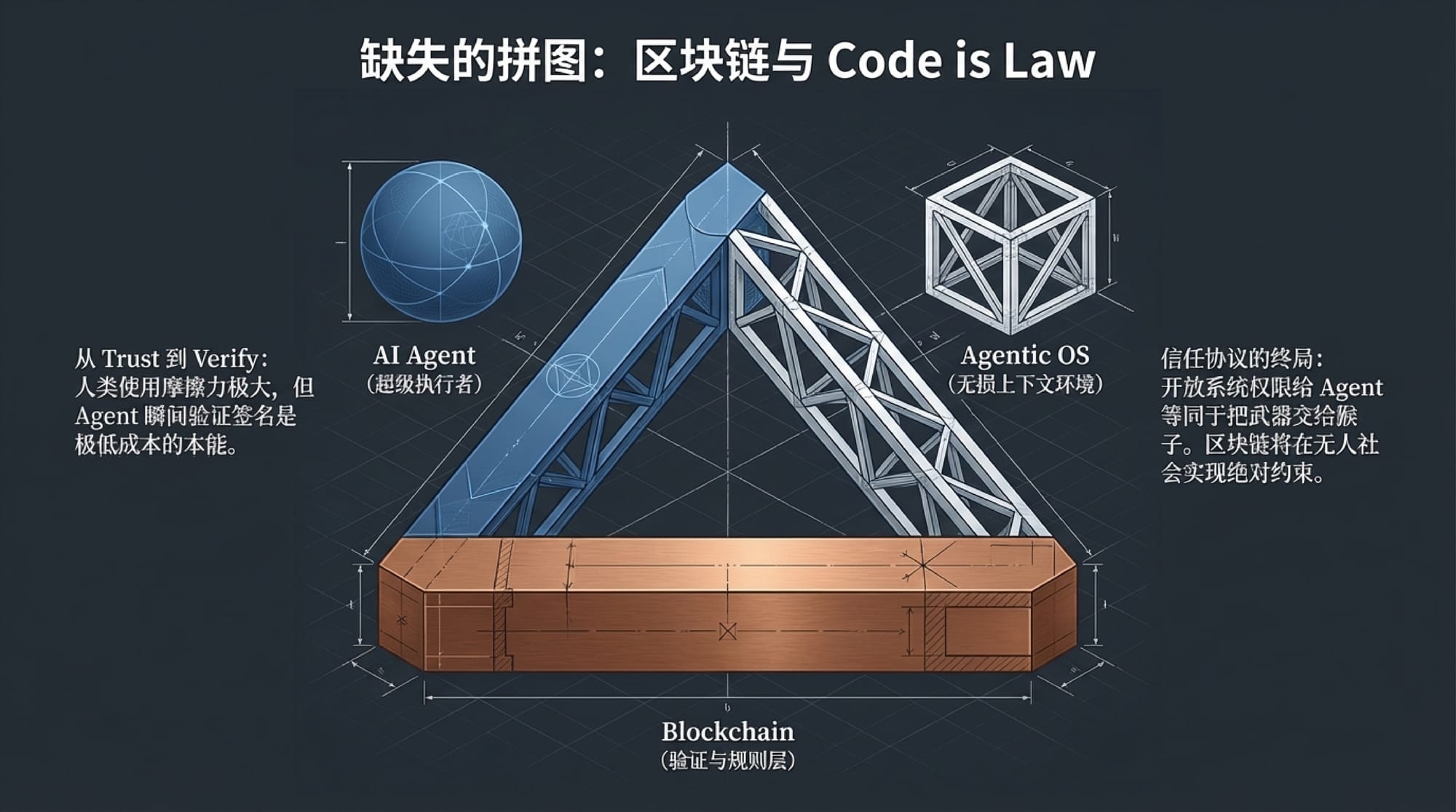

当前的操作系统和文件系统是为人类设计的,AI Agent 在其中是"二等公民"。ArcBlock 提出的 Everything is a Context 哲学和 Agentic File System,以及区块链作为 AI Agent 的信任基础设施,将重塑整个软件基础架构。

对话的最后一部分进入了老冒作为 ArcBlock CEO 的主场——AI 时代的基础设施应该长什么样。

他指出了一个很多人忽视的问题:今天我们所有的 Infrastructure——操作系统、文件系统、开发工具——都是为人类设计的。AI Agent 在其中是"二等公民"。我们需要用 Playwright 之类的工具让 Agent 去读懂人类的界面,需要在文件夹里放 Agent.md来给 Agent 提供上下文——"这些都是一个二等公民干的事情"。

ArcBlock 做的事情是把 Agent 变成"一等公民"。他们发表了一篇学术论文,提出了 Agentic File System 的概念——一个专门给 AI Agent 使用的文件系统。其核心哲学是把 Unix 系统的"Everything is a File"扩展为"Everything is a Context"(一切都是上下文)。这篇论文在圈子里引起了不小的反响,被多个 AI 领域的大V推荐。

但更大的图景是区块链与 AI 的结合。老冒的观点是:区块链在 AI 时代有了全新的、也许是真正的应用场景。过去区块链最大的摩擦力是用户体验太差——钱包搞不定、操作太复杂。但这些东西对Agent来说根本不是问题,"太简单了"。

区块链的核心价值是什么?是 Verification(可验证性)——Don't Trust, Verify。在人类经济中,Trust(信任)是最高成本的东西。区块链通过密码学让验证变得快速和低成本。过去人类用区块链的时候,虽然技术上可以自己验证签名,但绝大多数人(包括老冒自己)从来没真正手动验证过——我们只是"相信程序,相信钱包"。但 AI Agent 可以真的去验证:立刻写一段代码来验证签名是不是对的,全部搞得定。

这引出了最后一个关键议题:AI Agent 时代的安全和信任。老冒提到了 OpenClaw(小龙虾),认为这类给 Agent 开放完整系统访问的工具虽然个人可以玩玩,但团队层面绝对不敢用——"我在Mac Mini上装了一个,就封闭在一个文件夹可以访问就好了,这东西太危险了。" 他甚至引用了马斯克的比喻:这相当于把 AK47 给猴子。

最后,老冒提出了一个贯穿整场对话的终极概念:Code is Law。这个概念最早出自互联网协议设计时代——互联网就是个对等网络,一切靠协议来执行规则。后来区块链把互联网"升级"了一下,加入了交易和价值存储的能力。而在 AI 时代,Code is Law 将用来为 Agent 建立规则和约束。

"过去这几年的 Blockchain 发展,一方面带来了赌场和一些金融的东西,但我觉得更多的是为 AI 时代打下了坚实的基础。" 老冒甚至提出了一个有诗意的观点: Blockchain 是个未来的技术,不小心在 2009 年被比特币带到了人类社会——它的真正使命,也许要等到 AI Agent 时代才能完全展现。

这场对话触及的问题远远超出了"AI编程"的范畴。往深了想,有几个值得持续关注的方向:

第一个是"上下文即一切"的哲学延伸。老冒反复强调上下文丢失是沟通失败的根本原因——无论是人与人之间、人与 AI 之间、还是多 Agent 之间。这意味着未来最有价值的基础设施,可能不是更快的计算或更大的模型,而是更好的上下文管理系统。

第二个是 Builder 经济的制度性影响。当软件开发的门槛大幅降低、个性化软件成为常态,现有的 SaaS 订阅模式、软件版权体系、甚至计算机科学教育都需要根本性的重构。

第三个是 AI Agent 社会的信任架构。当越来越多的 Agent 代替人类做决策和执行任务,谁来保证 Agent 没有被恶意注入?谁来验证 Agent 的行为符合预期?区块链提供了一种可能的答案,但这个领域才刚刚开始。