2026-03-14 08:00:00

感觉就在这几个月,Claude Code 这样的工具开始在身边火了起来。1 月份自己用 Cluade Code 搭配 kimi-k2.5,刚开始只是用来在 mac 上安装软件和修复环境。

上周终于通过美区 iOS 订阅 20 刀的服务,可惜没过 1 周账号就被封了。后来,改成订阅 ChatGPT Plus 服务来使用 Codex。现在开始用这些服务来完成之前一直没有做完的,导出 Logseq 笔记成为博客文章的脚本。如果你有想法,token is all you need!

另外遗憾的是,公司内部各种安全限制只能用 kimi-k2.5 这样的开源模型,而且各个平台都是 agent 时代之前的产品,总感觉等这些平台接入 coding cli 生态的成本,远高于重新搭建一套。

2026-02-18 08:00:00

Day 1-2

Day3-5

Day 6

+

2026-02-17 08:00:00

推荐系统传统召回是怎么实现热门item的打压? - 知乎 (zhihu.com)

2026-02-17 08:00:00

广告竞价划分 #card

2026-02-17 08:00:00

品牌广告往往是一个广告系统发展初期的广告模式,基本流程是广告主先付钱,平台保证曝光,如 cpt,gd 就是典型的品牌广告,前者没什么好说的,固定的广告位在特定位置强出就好了;后者则一般会涉及到库存预估和库存分配两个问题 #card

上面的做法只是在解决 gd 广告的保量问题,但是随着优化的精细化,除了保量,还需要考虑一些其他问题,如 #card

如果额外考虑以上这两点,#card

综上, {{c1 gd 广告}} 需要考虑保量、效果、溢价率以及对效果广告的挤压,因此建模时也需要把这些因素考虑进去。

2026-02-17 08:00:00

+

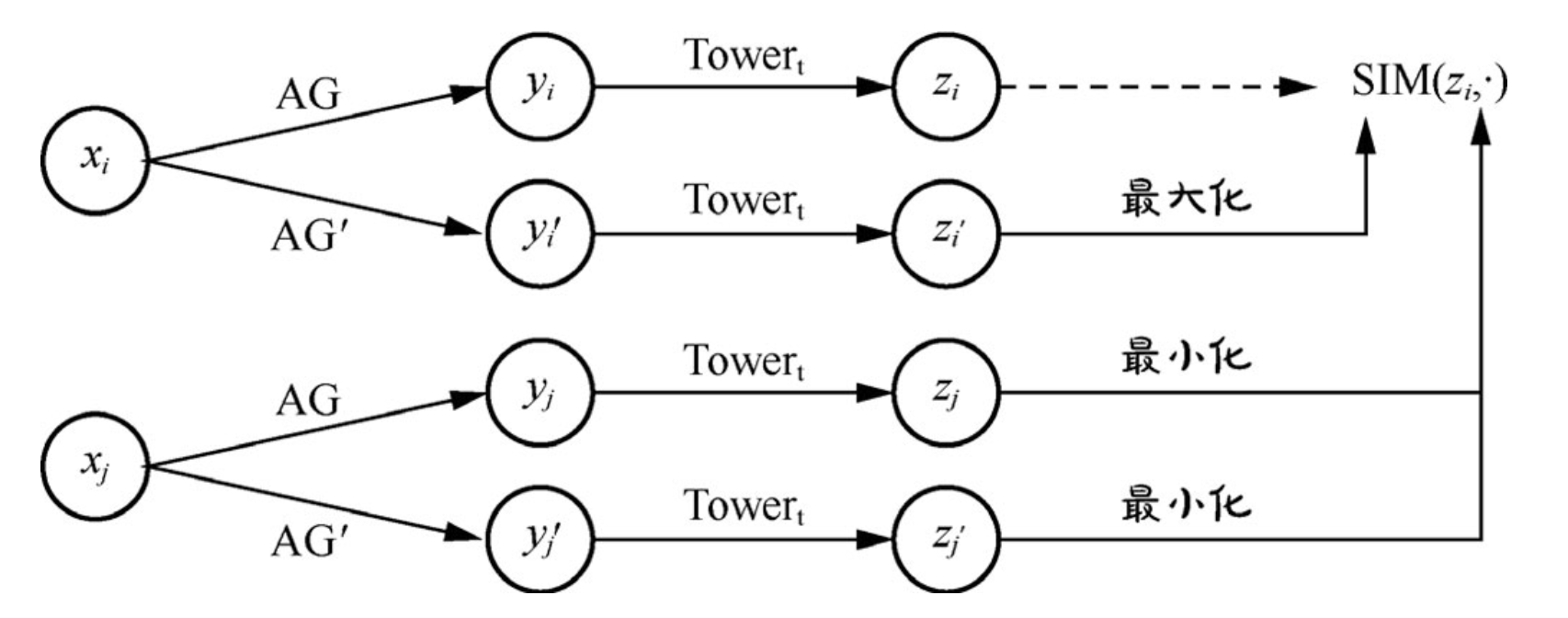

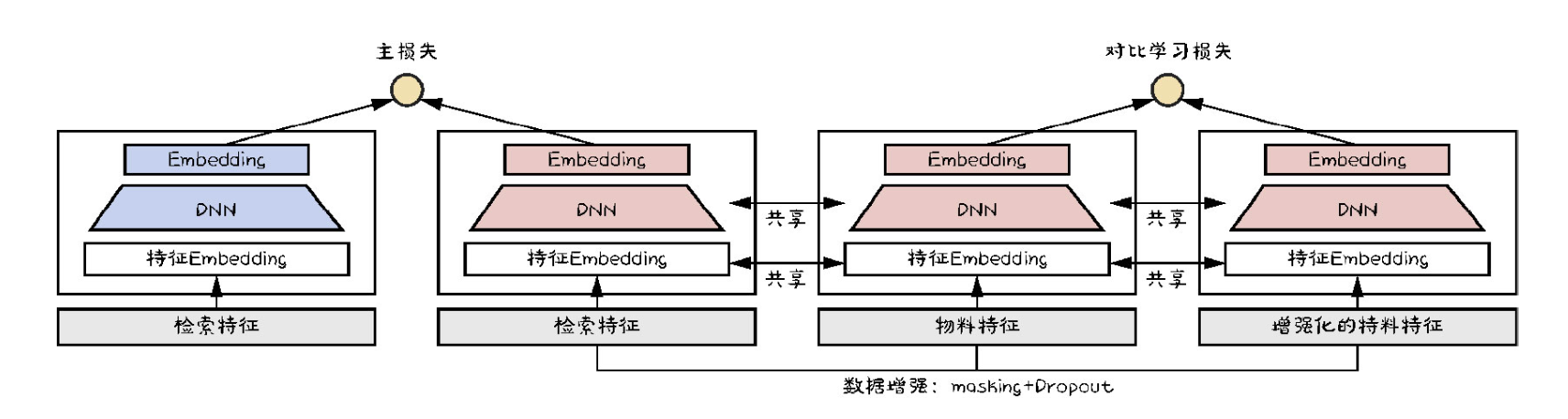

+ 随机特征遮蔽(Random Feature Masking,RFM) #card

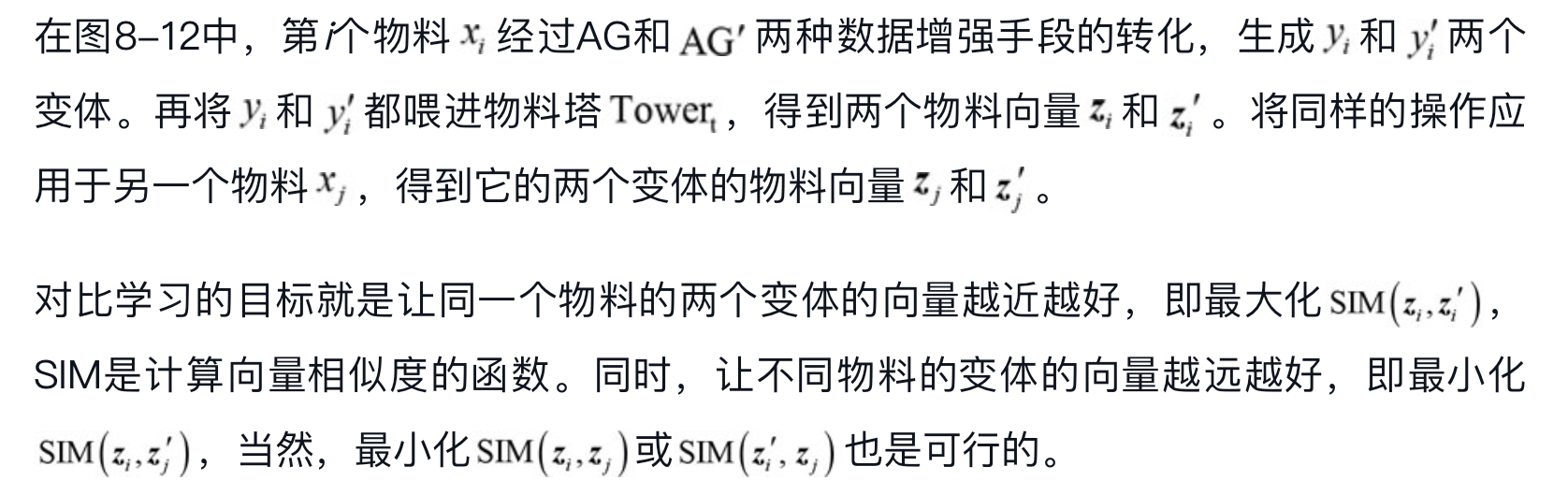

+ a 将一个物料的所有Field随机拆分到两个变体中去。

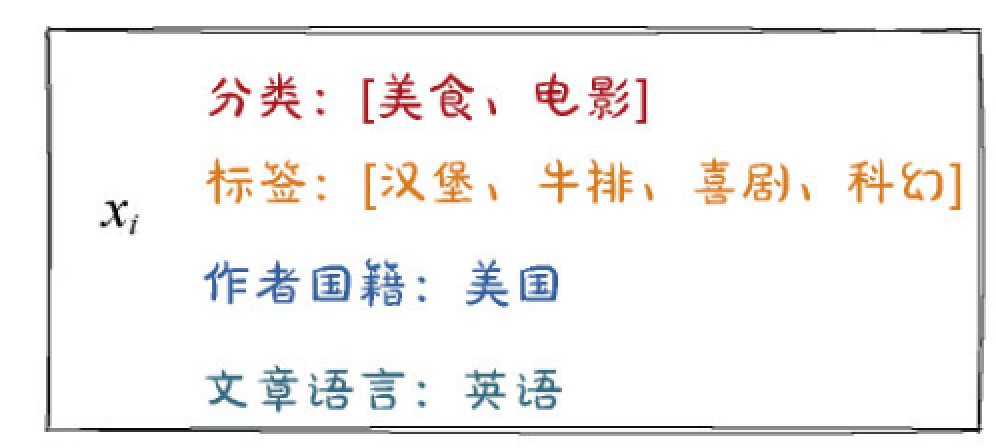

+ 关联特征遮蔽(Correlated Feature Masking,CFM) #card

+ 将一个物料的所有Field拆分到两个变体中,但不再是随机拆分,而是将强关联的Field拆分到一起。

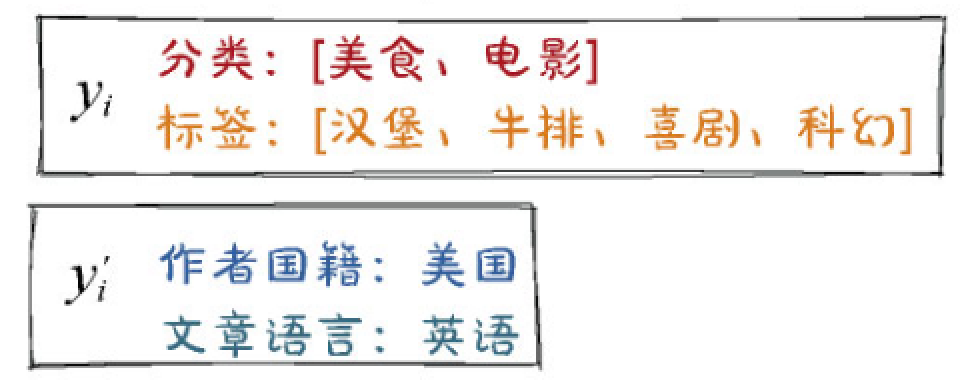

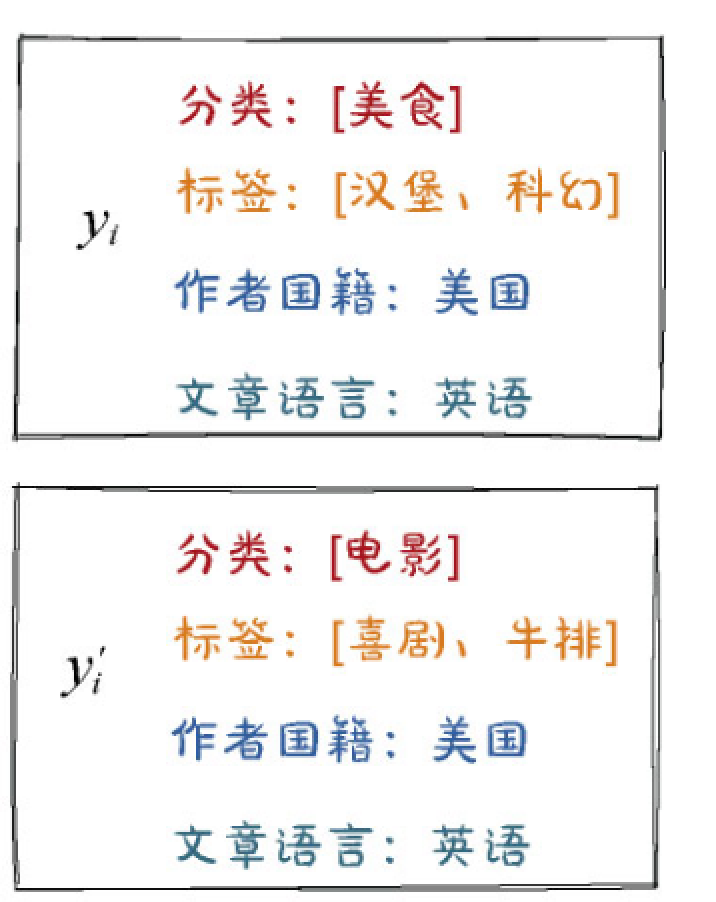

+ 如图8-13(b)所示,“分类”与“标签”都是描述文章内容的,都拆分到变体[插图]中;“作者国籍”和“文章语言”与作者属性强相关,都拆分到变体[插图]中。

+ 至于各Field之间的关联程度如何衡量,可以人工指定,也可以通过计算“互信息”提前准备好。

+ 随机丢失(Dropout):#card

+ 不再拆分Field,而是将一些多值Field(比如分类、标签)中的特征值随机拆分到两个变体中

+ 物料塔、物料特征的Embedding这些参数是被主辅任务共享的,唯有如此,才能达到 {{c1 纠偏}} 的目的。