2026-05-19 13:00:00

我是一个对音乐播放体验有点执念的人。自从搭建了 [[Navidrome]] 自托管音乐服务器,我就开始了一段漫长的客户端寻觅之旅。在 iOS 上,我几乎把能找到的 [[Navidrome]] 客户端都试了一遍,甚至为了体验更好而付费购买了 [[音流]]。但最终,我还是删掉了它们,把 [[Narjo]] 固定在了屏幕上。

在流媒体服务大行其道的今天,还在折腾自建音乐库的人,往往有些相似的执念:想要拥有自己的音乐,不依赖平台,不受版权下架的困扰,或者单纯就是喜欢把喜欢的 FLAC 文件存放在自己的硬盘上。[[Navidrome]] 就是这样一个开源的自托管音乐服务器,轻量、稳定,支持 Subsonic API,所以理论上所有兼容 Subsonic 的客户端都可以连接它。

问题在于,”兼容”只是入场门票,而体验才是核心。iOS 上能用的 Navidrome 客户端并不少,但真正做到让人用得顺手的寥寥无几。大多数客户端要么界面陈旧,停留在十年前的设计语言里;要么功能堆砌,导航逻辑混乱;还有一些干脆就是把 Web 界面套了个壳,交互完全不像一个原生 iOS 应用该有的感觉。

在我的寻觅过程中,[[Amperfy]] 是我第一个认真使用的客户端。它功能完整,支持离线缓存,也有基本的播放控制,作为一个免费的开源项目,确实值得称道。但它的界面让我觉得有些拥挤,信息层级不够清晰,切换专辑和浏览曲库的流程不够顺滑。[[Substreamer]] 的情况类似,功能可以用,但交互逻辑让我时不时需要多按几次才能找到想要的东西。

后来,我入手了音流。作为一款专门面向中国用户的 Navidrome iOS 客户端,它在本地化和 UI 打磨上明显花了心思。首次打开时,它的界面确实漂亮,对齐感强,颜色搭配也舒服。我用它有一段时间,也觉得够用。但用着用着,我开始注意到一些小摩擦:某些操作需要多一步确认,某些列表加载有时显得不够流畅,以及一些我说不清楚的”不对劲”——就是那种打开 App 之后,感觉操作动线与自己的直觉有微妙偏差的感受。

就在这个阶段,我发现了 [[Narjo]]。

打开 Narjo 的第一眼,我就感觉到有些不一样。它的界面用的是深色主题,专辑封面被放大展示,字体选择和排版间距都是那种”照顾过的”状态,不是为了塞更多信息而牺牲视觉呼吸感。最重要的是,常用操作都在拇指能自然触达的区域,这是很多音乐播放器容易忽视的细节。

Narjo 对 iOS 生态的集成让我印象深刻。它支持锁屏小组件,可以在桌面直接看到当前播放的曲目;支持 CarPlay,开车时不需要掏出手机;支持 Siri 指令控制,以及 iOS Shortcuts 的自动化接入。这些不是”有聊胜于无”的功能点,而是真正能在日常使用中减少摩擦的设计决策。这背后体现的是开发者把 Narjo 当成一个认真的 iOS 公民来打造,而不是单纯移植一套功能表。

在音质和播放控制层面,Narjo 支持交叉淡入淡出(crossfade)和无缝播放(gapless playback),这对于听专辑的完整体验来说很重要;内置的 EQ 调节功能可以针对不同耳机调整音色偏好;歌词同步显示的效果也很精准,配合深色界面,有一种恰到好处的沉浸感。

离线缓存的逻辑做得比较聪明。可以设置缓存上限,Narjo 会根据播放记录自动管理哪些内容需要保留,不需要手动管理一堆离线文件。这个细节省掉了我不少麻烦——之前用其他客户端,时不时需要手动清理缓存,Narjo 让这件事变得透明。

UPNP/DLNA 输出的支持也是我没想到的惊喜。家里有一台支持 DLNA 的音箱,以前需要通过其他 App 才能推送,现在直接在 Narjo 里就能选择输出设备,切换播放端的体验变得完整了。

我没有贬低 [[音流]] 的意思,对于很多用户来说,它是一个非常成熟的选择,中文界面和对国内用户习惯的针对性设计也有其价值。但对我个人来说,Narjo 在两个维度上胜出:一是与 iOS 原生能力的深度整合,Narjo 更像是”为 iPhone 设计的”,而不是”在 iPhone 上可以用的”;二是整体交互流的顺畅程度,我很难用一两个功能点来描述这种差异,但就是那种打开 App、找到想听的歌、按下播放的整个流程里,Narjo 让我产生的阻力更少。

折腾自托管音乐服务的人,通常不缺耐心,但真正好的工具应该让人花时间在音乐本身,而不是操作界面上。Narjo 目前还在 TestFlight 测试阶段,这意味着它还在持续迭代,也意味着它有可能在未来引入订阅或一次性付费。但就目前的体验而言,它已经是我用过的所有 iOS Navidrome 客户端里最让我满意的一个。

如果你也在用 [[Navidrome]],还没有找到一个用起来顺手的 iOS 客户端,Narjo 值得一试。

2026-05-16 13:00:00

最近我一直在思考一个问题:AI 编码工具越来越多,但为什么每次切换工具或开启新会话,都感觉像是从零开始?我用 [[Claude Code]] 写了一段时间,又想试试 [[Gemini]] CLI,但每次都要重新解释项目背景、编码规范、当前任务进度。这种重复性的”上下文喂养”工作,慢慢变成了一种隐性负担。

直到我发现了 Trellis,才意识到这个问题其实已经有人在认真解决了。

Trellis 是由 Mindfold AI 开发的一个开源框架,定位非常明确:让 AI 编码代理真正具备生产就绪能力(production-ready)。它的核心理念是把开发规范、任务上下文和项目记忆统一存储在代码库中,让任何支持的 AI 平台都能自动获取这些信息,而不是每次手动复制粘贴。

从本质上说,Trellis 是一个”AI 代理的工作协议层”。它不替代任何具体的 AI 工具,而是在这些工具之上建立一套共享的约定和存储机制。开发者写一次规范,团队中所有人的 AI 代理都能受益;记录一次任务背景,下次换平台或换人接手时,AI 依然能理解当前进度。

目前 Trellis 声称支持 14 个 AI 编码平台,涵盖 [[Claude Code]]、Gemini CLI、OpenAI Codex、Cursor、Windsurf、Cline 等主流工具,基本覆盖了现在开发者常用的选择。

在没有 Trellis 这类工具之前,AI 辅助开发存在几个非常实际的痛点,相信很多人都踩过。

第一个是上下文丢失问题。每次新开会话,AI 都不记得上次的内容。你需要重新解释项目结构、告诉它你们团队不用 var、提醒它接口命名要用驼峰式。这些碎片化的重复沟通,看似小事,累积起来却非常耗时。

第二个是跨平台一致性问题。假设你用 Claude Code 开发,同事用 Cursor,另一个同事用 Copilot,那三个人的 AI 助手都在按各自的”理解”写代码,最终合并时风格差异、规范冲突在所难免。

第三个是任务追踪缺失。AI 写代码很快,但它不知道”整个功能的实现计划是什么”、”这个 PR 的审查意见有哪些”、”上次做到哪一步了”。没有结构化的任务信息,AI 的输出往往是局部正确但全局脱节的。

Trellis 针对这三个问题都给出了对应的解决方案。

Trellis 在项目根目录下创建一个 .trellis/ 文件夹,里面分三个子目录各司其职,设计非常清晰。

.trellis/spec/ 存放编码约定和项目规范。你可以在这里定义代码风格、架构决策、命名规范、禁止使用的模式等内容。Trellis 会在每次 AI 会话启动时自动注入这些规范,让 AI 始终按照你们团队的标准工作,而不是按照它自己的默认偏好。

.trellis/tasks/ 是任务中心。你可以把产品需求文档(PRD)、功能实现计划、代码审查意见存储在这里。当 AI 开始处理一个任务时,它能先读取完整的任务背景,而不是盲目地从当前文件猜测意图。这让 AI 的工作更有方向感,输出的代码也更符合整体设计。

.trellis/workspace/ 保存项目记忆。它会记录历史会话中的重要决策、已解决的问题和关键背景信息。这样下一次会话,不管是你自己接着做,还是换个 AI 平台,都能基于真实历史而不是空白状态开始工作。

这三个目录的内容都是普通文本文件,可以纳入版本控制,团队成员都能贡献和修改。一个人优化了规范,所有人的 AI 助手都同步受益,这是 Trellis 设计中我最欣赏的一点。

Trellis 的安装非常简单,通过 npm 全局安装即可:

npm install -g @mindfoldhq/trellis@latest

然后在你的项目目录下初始化:

trellis init -u your-name

-u 参数指定你的用户名,用于在项目记忆中标记是谁添加了哪些信息。初始化完成后,.trellis/ 目录会被创建,里面有基础的模板文件供你填写。

之后的工作流很自然:在 spec/ 下写你们的编码规范(可以从现有的 .cursorrules 或 CLAUDE.md 迁移过来),在 tasks/ 下创建功能任务卡,然后打开你喜欢的 AI 编码工具开始工作。Trellis 负责在会话开始时把相关信息注入给 AI,你只需要专注于具体问题本身。

对于已经有 CLAUDE.md 或者 .cursorrules 的项目来说,迁移成本很低。可以把现有的规范内容直接复制到 .trellis/spec/ 下,Trellis 会统一管理这些信息并适配到不同平台。

我觉得 Trellis 真正发光的场景是多人协作。个人开发者用它能省去不少重复沟通,但团队使用时带来的价值会被放大几倍。

想象一个典型场景:产品经理把需求写成一个 tasks/feature-xxx.md 文件提交到仓库,后端工程师的 Claude Code 读取后按照 spec/backend-conventions.md 中的规范实现接口,前端工程师的 Cursor 读取同样的任务背景后按照 spec/frontend-conventions.md 写组件,代码审查的意见也记录回 task 文件。整个过程中 AI 始终在同一个”知识库”下工作,而不是各自为战。

这种模式下,团队对 AI 工具的依赖不再是个人行为,而是变成了一种可以持续演进的集体能力。规范越来越完善,记忆越来越丰富,新成员入职后 AI 助手也能快速提供高质量的辅助,因为它已经”学到”了这个团队的工作方式。

Trellis 解决的问题听起来不算惊天动地,但它戳中了 AI 辅助开发工作流中一个真实而长期被忽视的薄弱环节:AI 工具本身越来越强,但工具之间、会话之间的连接性一直很弱。把规范和记忆从每个工具的私有配置中解放出来,存到代码库里统一管理,这个思路既简单又务实。

对我来说,Trellis 最大的启示不只是这个工具本身,而是它背后反映的一种工程思维:AI 代理不应该是用完即弃的临时助手,而应该是可以积累知识、与团队共同成长的协作者。把这种积累机制做好,才是 AI 辅助开发真正成熟的标志。

如果你也在使用多个 AI 编码工具,或者在团队中推广 AI 辅助开发,Trellis 值得认真了解一下。项目地址在 GitHub:mindfold-ai/trellis。

2026-05-13 13:00:00

做产品的人都绕不开一个问题:用户到底在用我的产品做什么?他们在哪一步流失,哪个功能最受欢迎,新版本上线后行为有没有变化。回答这些问题需要数据,而收集和分析这些数据,往往需要堆砌一大堆工具——用 [[Mixpanel]] 做事件分析,用 [[FullStory]] 录制会话,用 [[LaunchDarkly]] 管理功能开关,用 [[Optimizely]] 跑 A/B 测试。每个工具都要单独集成 SDK,单独管理账单,数据还分散在各处,关联分析几乎不可能。

我在寻找一个能把这些能力整合起来、又不让数据流向第三方的解决方案时,发现了 [[PostHog]]。

PostHog 是一个开源的产品分析平台,2020 年创立于英国,目标是把产品团队需要的数据工具全部放进一个产品里。它的 GitHub 仓库完全公开,代码量巨大,背后有真实的商业化运营——他们提供云端托管版本,同时也支持你把整套系统部署在自己的服务器上。

与 Mixpanel、Amplitude 这类纯 SaaS 产品分析工具相比,PostHog 最大的差异点有两个:一是功能广度,它把过去需要多个工具才能覆盖的能力都内置了;二是数据主权,自托管模式意味着用户行为数据不需要离开你自己的基础设施。对于需要处理敏感数据的企业,或者对数据隐私有要求的团队,这一点非常关键。

PostHog 的功能体系比大多数竞品都要宽,理解它的方式是把它当成一个产品数据基础设施平台,而不是单一的分析工具。

产品分析是它的核心。你可以通过埋点或者无埋点自动捕获用户行为,然后用漏斗(Funnel)分析转化路径,用留存图追踪用户的回访规律,用路径图看用户在不同页面或功能之间的流转情况。这部分的体验和 Mixpanel 非常接近,对熟悉主流产品分析工具的人来说几乎没有学习成本。

会话录制(Session Recording)让你能够回放真实用户的操作过程。不同于一般的屏幕录制工具,PostHog 的会话录制是事件驱动的,可以直接和分析数据关联起来——比如你发现某个漏斗步骤流失率很高,可以直接点击查看这批用户的会话录像,看他们究竟遇到了什么问题。热图功能也集成在这里,点击热图和滚动热图都支持。

功能开关(Feature Flags)是另一个让我印象深刻的模块。你可以基于用户属性、百分比、地区等条件精细化控制某个功能的可见范围,灰度发布时极为有用。功能开关可以直接与分析事件绑定,不需要额外配置就能看到开关不同状态下的用户行为差异。

A/B 测试(Experiments)建立在功能开关的基础上。你定义实验组和对照组,指定目标指标,系统会自动进行统计显著性计算,告诉你哪个变体表现更好。整套流程内置在 PostHog 里,不需要像以前那样把实验平台和分析工具分开管理。

用户调研(Surveys)是相对较新的功能,支持在产品内弹出问卷,收集 NPS 评分或开放式反馈,数据同样汇入 PostHog 的数据仓库,可以和行为数据一起分析。

数据管道(Data Pipelines)功能支持把 PostHog 采集到的事件实时同步到外部数据仓库,比如 BigQuery、Snowflake、Redshift,或者从外部系统导入用户属性数据。这让 PostHog 能够融入更复杂的数据栈,而不是成为数据孤岛。

PostHog 提供两套部署方案:PostHog Cloud(官方托管)和自托管版本。

自托管走的是 Docker Compose 路线,官方提供了一套完整的配置文件,在配置合理的 VPS 上一条命令就能跑起来。数据库用 ClickHouse,事件处理走 Kafka,整体架构相当现代化。ClickHouse 在列式存储上的优势让 PostHog 能以较低的资源消耗处理大量事件数据。

我在一台 4 核 8GB 的机器上跑过自托管版本,每天处理几十万事件问题不大,查询响应速度也挺快。真正对服务器要求高的是 ClickHouse 的内存消耗——事件量上来之后这块的资源需求会明显增加,官方建议生产环境至少 4 核 16GB 起步。

自托管的另一个好处是成本可控。PostHog Cloud 的定价是按事件量计费,免费层每月有 100 万事件,超出后按阶梯计费。对于用户量不小的产品,云端费用会积累得相当快。自托管虽然需要运维投入,但边际成本主要是服务器资源。

相比 Mixpanel 和 Amplitude,PostHog 在分析深度上没有明显短板,但在某些高级分析功能上(比如预测性分析、机器学习驱动的洞察)目前还没有跟上。不过对于大多数产品团队的日常需求——漏斗、留存、路径、用户分群——PostHog 完全够用。

功能开关和 A/B 测试对比 LaunchDarkly 和 Optimizely,后者更专业,支持更复杂的实验设计和更精细的流量管理,但价格也相当不菲。PostHog 的这两个功能对于中小规模的团队来说足够,省去了另外集成专用工具的麻烦。

会话录制和 FullStory、Hotjar 比起来,易用性稍逊,但核心功能完备,更重要的是数据不出去。如果你之前用 Hotjar 主要是为了看录像和热图,PostHog 完全可以替代。

PostHog 解决的核心问题是工具碎片化——产品分析、会话录制、功能开关、A/B 测试,四件事在一个平台里全做了,数据天然打通,不需要靠导出 CSV 再手动关联。对于一个快速迭代的产品团队来说,这种集成度带来的效率提升是很实际的。

开源加自托管的组合则解决了另一个越来越被重视的问题:数据去哪了。不管是出于合规要求还是对数据资产的珍视,把用户行为数据放在自己可控的地方,是一个值得认真考虑的选择。

如果你正在为产品选型数据工具,PostHog 值得认真评估一番,尤其是你有自托管能力、团队在乎数据自主权的情况下。它不是在某一个维度做到极致的专用工具,但作为覆盖面最广的开源产品分析平台,目前没有什么竞争者。

2026-05-13 13:00:00

用 [[Claude Code]] 写代码时,一直有一个令人微妙不适的摩擦:每当 Claude 完成一轮工作,控制权就回到了我这里,我需要再次发出指令,告诉它”继续”“再检查一遍”“还有这个文件没改”。对于那种需要跑很多轮才能完成的任务——比如把一个模块从旧 API 迁移到新 API 直到所有测试通过,或者逐文件重构某个目录直到符合统一规范——这个”人类中继”的环节就显得相当机械,本质上我只是在不停地按确认键。

[[Claude Code]] 最新推出的 /goal 命令针对的正是这个场景:你描述一个完成条件,Claude 就跨多个 turn 持续工作,每轮结束后由一个独立的小模型来判断条件是否满足,满足则停,否则继续。不再需要人类守在旁边不断催促。

/goal 的核心机制可以用一句话概括:在每轮 Claude 工作结束后,引入一个独立的评估模型来判断”目标是否达成”,未达成则自动触发下一轮,达成则停止并清除目标。

具体来说,整个循环是这样运转的:你输入 /goal 加上完成条件的描述,这个命令本身就直接触发第一轮工作,不需要额外再发一条指令。每轮 Claude 完成工作后,目标条件和当前对话内容一起被发给一个小型快速模型(默认是 Haiku),该模型返回两样东西:一个是/否的判断,以及一段简短的理由解释为什么条件达成或还未达成。如果判断是”未达成”,那段理由还会作为下一轮的参考信息传给 Claude,引导它的后续工作方向。

这种设计有一个微妙但重要的含义:评估和执行是分离的。做事的模型和判断事情是否做完的模型不是同一个,这避免了 Claude 既当运动员又当裁判时可能产生的自我满足倾向。一个 fresh 的评估模型会更客观地判断条件是否真的满足。

目标激活期间,界面上会显示 ◎ /goal active 的状态指示,并且记录目标已经运行了多久。每次评估后,最新的评估理由也会出现在状态栏里,让你随时能看到 Claude 当前正在朝哪个方向努力。

用法很直接,输入 /goal 加上你的完成条件就可以:

/goal 迁移 auth 模块到新版 API,直到所有相关测试全部通过

/goal 重构 components/ 目录下所有组件,确保没有 TypeScript 类型错误

/goal 找出并修复所有导致 CI 失败的问题,直到 CI 全绿

同一个 session 里只能有一个 goal 处于激活状态。如果在目标达成前想中途放弃,用 /goal clear 清除即可,stop、off、reset、none、cancel 这些词也都被接受为 clear 的别名。

不带参数运行 /goal 可以查看当前状态,包括已跑的 turn 数和消耗的 token 数:

/goal

如果已经有一个 goal 在跑,再次用 /goal <新条件> 会直接替换掉旧的目标。通过 /clear 开始新对话也会清除当前的 goal。

会话中断后用 /continue 恢复时,目标本身会保留,但 turn 计数、计时器和 token 消耗的基线会重置,相当于重新开始计算。

Claude Code 里有几种”让 Claude 持续工作”的机制,它们的区别值得理清楚:

/goal 在每轮结束后立即触发下一轮,用模型评估条件是否满足来决定是否停止,条件是用自然语言描述的——适合”做到某个状态才算完”的任务。

/loop 是按时间间隔触发,你设定一个时间窗口(比如每 5 分钟),Claude 会周期性醒来工作一次,停止的时机是你手动叫停,或者 Claude 自己判断工作已经完成——适合”持续轮询”“定期检查”这类时间驱动的场景。

Stop hook 是最底层的机制,/goal 本质上就是对 Stop hook 的高层封装:它在 session 范围内注册了一个 prompt-based Stop hook,每轮结束后调用 Haiku 评估条件。Stop hook 的灵活性最高,可以执行任意 shell 脚本做确定性检查(比如直接跑测试命令),不局限于语言描述的条件,但需要在设置文件里配置,是跨 session 持久的。/goal 的优势在于即时性和便捷性,当下想用就用,session 结束自动消失。

| 方式 | 触发时机 | 停止条件 | 典型场景 |

|---|---|---|---|

/goal |

上一轮结束后立即 | 模型评估条件满足 | 目标导向的多步任务 |

/loop |

设定的时间间隔 | 手动停止或 Claude 自判断 | 定期检查、轮询 |

| Stop hook | 上一轮结束后立即 | 脚本或 prompt 判断 | 确定性验收、复杂条件 |

/goal 和 auto 模式是互补关系,容易让人以为二者重叠。

auto 模式的作用域是单轮内:它自动批准工具调用,Claude 在一轮内不需要你不断点允许就能执行读文件、写文件、运行命令等操作。但一轮结束,控制权就回到你手里。

/goal 的作用域是跨轮次:它在每轮结束后决定要不要再启动一轮,解决的是”我需要不断说继续”的问题。

两者组合使用才是最顺滑的体验:auto 模式处理轮内的工具审批,/goal 处理轮间的连续性,整个任务从开始到完成可以完全不需要人工干预。

/goal 依赖 Claude Code 的 hooks 系统运行,因此有几个前提条件需要满足:当前工作区必须已经通过了 trust 对话框的确认;如果在设置文件里设置了 disableAllHooks 或者管理员启用了 allowManagedHooksOnly,/goal 命令会明确告知你无法使用,而不是静默失效。

在非交互模式和 Remote Control 下,/goal 同样可以工作。通过 -p 参数启动时,设定了 goal 的调用会一直运行到条件满足才返回:

claude -p "/goal 修复所有 lint 错误并确保 build 成功"

用 Ctrl+C 可以中途打断非交互模式下正在运行的 goal。

消耗方面需要留意:每轮结束后都会调用 Haiku 做评估,这部分 token 消耗是额外的。对于条件明确的任务问题不大,但如果条件写得模糊、Claude 一直无法满足,goal 可能会运行很多轮积累不少消耗——写清楚、可验证的条件比含糊的目标更能让 goal 高效停止。

/goal 在功能设计上抓住了一个关键痛点:长任务里最浪费人类注意力的部分,不是看 Claude 工作,而是在每轮结束后判断”是不是还要继续”然后再发一条指令。把这个判断交给独立的评估模型来做,在设计上是合理的——执行和验收分离,减少了”自我感觉良好就停下”的风险。

从 Codex CLI 率先在 v0.128.0 推出 /goal 到 Claude Code 跟进实现,这个命令正在成为 AI 编程工具里的标准能力。对于迁移、重构、批量修复这类需要多轮才能完成的开发任务,/goal 配合 auto 模式能让整个过程接近”设定目标,等待完成”的体验,让注意力从”督促 AI 执行”转向”验收 AI 结果”——这个方向是对的。

2026-05-13 13:00:00

最近在排查一台服务器的性能问题时,我习惯性地打开了 [[htop]],盯着那一列列滚动的数字,试图从里面读出 CPU 负载的变化趋势。说实话,数字本身没什么问题,但当你需要判断”过去几分钟内 CPU 是否有明显的周期性抖动”时,一屏幕的百分比实在不如一条折线来得直观。就在那个时候,我发现了 tiptop 这个工具,用了之后感觉有点相见恨晚。

[[top]] 是 Unix/Linux 系统里最经典的进程监控命令,存在了几十年,几乎人人都用过。后来出现的 [[htop]] 在交互体验上做了很大的改进,支持鼠标操作、彩色显示、树形进程视图,成为很多开发者和运维工程师的首选替代品。但不管是 top 还是 htop,它们的核心展示方式都是”表格+数字”——实时刷新的数字列表。

tiptop 走了一条不同的路。它的核心理念是把这些数字变成图表,让趋势可见。与其告诉你”当前 CPU 使用率 47%”,不如展示一条过去几分钟内 CPU 使用率的折线图,让你一眼就能看出现在是上升趋势、下降趋势还是保持稳定。这个思路其实很简单,但在命令行工具里做出来效果非常实用。

tiptop 由开发者 Nico Schlömer 用 Python 编写,项目托管在 GitHub(nschloe/tiptop),采用 MIT 许可证开源。底层依赖两个库:[[Textual]] 负责终端 UI 的布局和渲染,[[psutil]] 负责跨平台地抓取系统数据。这个技术选型让 tiptop 在 Windows、macOS 和 Linux 上都能运行,不需要针对不同平台做特殊配置。

打开 tiptop 之后,界面分为上下两个区域。上半部分是多个图表面板,默认展示 CPU 使用率、内存占用、网络收发速率和磁盘 I/O,每个面板都是持续更新的折线图,横轴代表时间,纵轴代表指标数值。下半部分是进程列表,和 htop 类似,可以按 CPU 或内存占用排序。

图表面板的价值在排查间歇性问题时体现得最为明显。比如你怀疑某个任务每隔一段时间会触发一次 CPU 峰值,用普通的 top 你只能守在屏幕前等待,碰巧刷新到那一刻才能看到。而 tiptop 的图表会把历史趋势保留下来,哪怕你回头看,也能从曲线的波峰位置推断出问题的规律。内存的图表同样有用,缓慢上升的曲线往往是内存泄漏的早期信号,远比”当前使用 3.2GB”这个数字更能引起警觉。

网络流量的可视化对于需要监控带宽使用的场景也很有帮助。折线图能清楚地展示流量的突增和骤降,结合下方的进程列表,定位到是哪个进程在消耗带宽相对容易。

tiptop 的安装非常简单,通过 [[pip]] 一行搞定:

pip install tiptop

安装完成之后直接运行 tiptop 即可启动,无需任何配置文件。工具会自动检测系统环境并选择合适的网络接口显示流量数据,如果需要指定特定网络接口,可以通过 --net 参数传入:

tiptop --net eth0

交互方面,tiptop 提供了一些常用的键盘快捷键。q 退出,c 按 CPU 使用率排序进程列表,m 按内存排序,p 暂停和恢复数据更新。操作逻辑和 htop 很接近,熟悉 htop 的人几乎不需要学习成本。

在 macOS 上也可以通过 [[Homebrew]] 或 [[MacPorts]] 安装:

# MacPorts

sudo port install tiptop

如果你用 [[pipx]] 管理命令行 Python 工具(这是我个人更推荐的方式,避免污染全局环境),安装命令是:

pipx install tiptop

tiptop 最适合几类使用场景。第一是 SSH 到远程服务器做临时巡检,一条命令启动,图表直接告诉你服务器当前的负载趋势,比看数字效率高得多。第二是在本地做性能测试的时候,把 tiptop 开在一个终端窗口里,另一个窗口跑压测脚本,CPU 和内存的变化曲线实时可见,结果比截图一列数字更有说服力。第三是日常在终端里保持一个 tiptop 窗口,充当轻量级的系统仪表盘,随时能看到机器的运行状态。

和 htop 相比,tiptop 并不是要取代它。htop 在进程管理方面更完善,支持直接 kill 进程、设置 nice 值、查看进程树,这些是 tiptop 没有的功能。两者更像是互补关系:需要深入管理进程时用 htop,需要直观感知系统负载趋势时用 tiptop。

有一点值得注意,tiptop 目前的版本(0.2.8)功能还比较精简,自定义面板布局的能力有限。如果你有非常复杂的监控需求,可能需要搭配专业的监控系统来用。但作为一个轻量、开箱即用的命令行工具,它的定位非常清晰,在这个定位内做得相当好。

tiptop 让我意识到,有时候改变信息的呈现方式,比增加信息本身更有价值。同样是系统监控数据,用折线图表达出来的洞察力远超数字列表。对于经常在终端里工作的开发者和运维人员来说,这是一个值得加入工具箱的小工具,安装成本几乎为零,但在需要判断趋势的场景下能节省不少脑力。如果你已经习惯了 top 和 htop,不妨花五分钟试试 tiptop,感受一下图表化监控带来的不同体验。

2026-05-12 13:00:00

在 Linux 网络工具箱里,大多数人都知道 [[netcat]](nc),遇到要临时监听端口、传文件、测连通性,第一反应就是 nc。但用了一段时间之后我发现,[[socat]] 才是那个被严重低估的工具——它不仅能做 netcat 的一切,还能做很多 netcat 根本做不到的事,比如 SSL 加密通信、Unix socket 代理、串口转 TCP,以及真正灵活的双向数据流转发。

这篇文章我想把自己用 socat 的经验好好梳理一遍,从基础概念到实战场景,争取让你看完之后不再只会用 netcat 了。

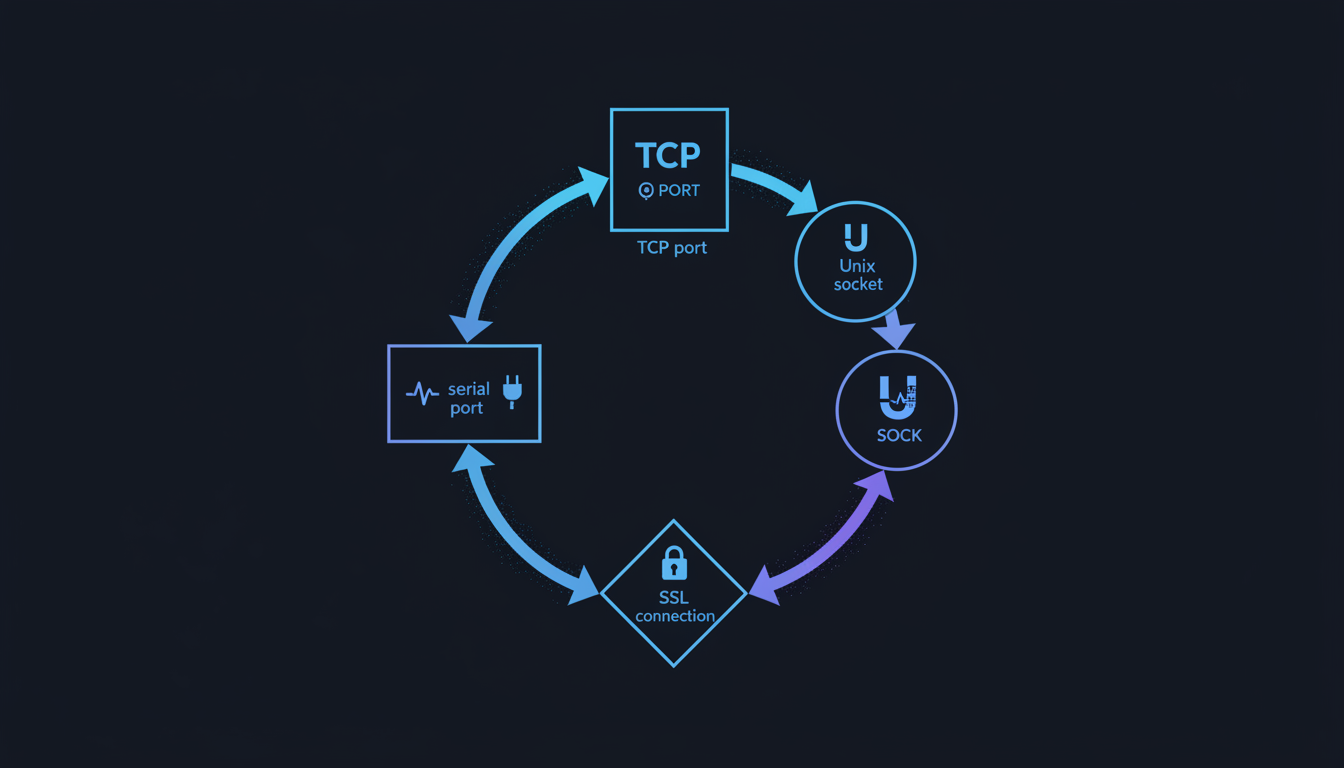

socat 的全称是 SOcket CAT,名字直接说明了它的设计思路——把各种类型的数据流(socket)像 cat 一样连接起来。官方的描述是”建立两个双向字节流并在它们之间传输数据”,听起来有点抽象,但换个说法就清楚了:socat 可以把任意两个”地址”连接起来,数据在两端之间双向流动。

这里的”地址”可以是 TCP 端口、UDP 端口、Unix socket、文件、管道、设备(比如串口 /dev/ttyS0)、甚至标准输入输出。这种设计让 socat 的应用场景非常广泛,而不像 netcat 那样主要局限在 TCP/UDP 的范畴内。

安装也很简单:

# Debian/Ubuntu

sudo apt install socat

# macOS

brew install socat

# CentOS/RHEL

sudo yum install socat

socat 的命令格式很固定:

socat [options] <address1> <address2>

两个地址之间会建立双向数据流。地址的格式通常是 TYPE:parameters,比如 TCP:127.0.0.1:8080、UDP-LISTEN:9000、STDIN、FILE:/tmp/data.txt 等。

几个最常用的地址类型:

TCP:<host>:<port> — 连接到某个 TCP 地址TCP-LISTEN:<port> — 监听某个 TCP 端口UDP:<host>:<port> / UDP-LISTEN:<port> — UDP 版本STDIN / STDOUT — 标准输入输出FILE:<path> — 读写文件UNIX-CONNECT:<path> / UNIX-LISTEN:<path> — Unix domain socketOPENSSL:<host>:<port> — SSL/TLS 连接EXEC:<command> — 执行命令并连接其 stdin/stdout端口转发大概是我用 socat 最多的场景。比如你在内网有一台机器,只有 22 端口对外开放,但你想在本地直接访问那台机器上的 Web 服务(假设跑在 8080)。用 socat 一行搞定:

# 在跳板机上运行:将本地 8888 转发到目标机器的 8080

socat TCP-LISTEN:8888,fork TCP:target-host:8080

这里的 fork 参数很重要,它让 socat 在接受一个连接后继续监听,而不是只处理一次就退出。没有 fork 的话,socat 接受第一个连接处理完就会停止,这显然不是我们想要的行为。

如果要把本地的 UDP 端口转发出去:

socat UDP-LISTEN:5353,fork UDP:8.8.8.8:53

还有一个我经常用到的场景:把 IPv6 地址桥接给只支持 IPv4 的程序访问。比如本地服务只绑定在 IPv4,但你想从 IPv6 客户端访问:

socat TCP6-LISTEN:8080,fork TCP4:127.0.0.1:8080

用 socat 做简单的 TCP 监听和连接,和 netcat 几乎一样直观。

在服务端监听:

socat TCP-LISTEN:12345 STDOUT

在客户端连接发送数据:

echo "hello from socat" | socat - TCP:server-ip:12345

传文件也很方便,接收端先开好监听:

socat TCP-LISTEN:12345 > received_file.tar.gz

发送端:

socat - TCP:server-ip:12345 < local_file.tar.gz

比起 netcat,socat 的好处是行为更可预测,不同平台的 netcat 实现差异很大(BSD 版和 GNU 版语法有不少差异),而 socat 的行为跨平台高度一致。

这个场景在容器和 CI/CD 环境里特别实用。Docker daemon 的 socket 默认在 /var/run/docker.sock,只有 root 或 docker 组的用户才能访问。如果你在某个受限环境里需要让普通用户或某个进程访问 Docker API,可以用 socat 在 TCP 端口上暴露一个代理:

socat TCP-LISTEN:2375,fork UNIX-CONNECT:/var/run/docker.sock

之后就可以通过 DOCKER_HOST=tcp://127.0.0.1:2375 来使用 Docker 客户端,不再受 socket 权限限制。当然,这样做要注意安全问题,仅在受控环境中使用。

反过来,如果某个工具只支持 Unix socket,但你的服务暴露的是 TCP 端口,也可以反向代理:

socat UNIX-LISTEN:/tmp/myapp.sock,fork TCP:127.0.0.1:3000

这是 socat 相对于 netcat 最大的优势之一。你可以用 socat 快速建立一个加密通道,不需要额外配置 nginx 或 stunnel。

先生成自签证书:

openssl req -newkey rsa:2048 -nodes -keyout server.key -x509 -days 365 -out server.crt

cat server.key server.crt > server.pem

服务端启动加密监听:

socat OPENSSL-LISTEN:443,cert=server.pem,verify=0 TCP:127.0.0.1:8080

客户端连接:

socat TCP-LISTEN:8080,fork OPENSSL:server-host:443,verify=0

verify=0 表示不验证证书(适合自签证书的测试场景),生产环境应该正确配置 CA 证书验证。

这个功能是 socat 独有的,netcat 完全做不到。在嵌入式开发或者工业设备调试中,经常需要把串口数据转发到网络上,让远程的机器能够访问本地的串口设备:

# 把本地串口 /dev/ttyUSB0 转发到 TCP 9600 端口

socat TCP-LISTEN:9600,fork /dev/ttyUSB0,raw,echo=0,b115200

b115200 是波特率设置,raw 表示原始模式,echo=0 关闭回显。另一端可以用 socat 连接这个 TCP 端口,就像直接操作本地串口一样。

socat 可以用来替代 telnet 做端口连通性测试,而且更适合在脚本里使用:

# 测试 TCP 端口是否可达,超时 5 秒

socat /dev/null TCP:target-host:8080,connect-timeout=5

echo $? # 0 表示成功,非0 表示失败

比 telnet 好的地方在于 socat 的退出码很规范,适合脚本判断,而 telnet 在不同系统上行为不一致。

在使用 socat 的过程中,我积累了一些提升体验的习惯:

加上 -d -d 可以开启详细日志,排查问题时非常有用:

socat -d -d TCP-LISTEN:8080,fork TCP:backend:8080

对于需要长期稳定运行的转发,可以配合 systemd 或者 supervisor 来管理进程,而不是直接跑在 shell 会话里,避免断开 SSH 后转发失效。

reuseaddr 选项可以避免”地址已在使用”的错误,在频繁重启的开发场景下很实用:

socat TCP-LISTEN:8080,reuseaddr,fork TCP:backend:8080

对于需要多个并发连接的场景,默认的 fork 模式已经够用;但如果担心 fork 带来的开销,可以用 TCP-LISTEN:port,fork,max-children=50 限制最大子进程数。

socat 是那种乍看文档有点发怵、但真正上手之后会让你爱不释手的工具。它的地址格式设计非常正交——理解了”两个地址之间建立双向流”这个核心模型,几乎所有用法都能举一反三。端口转发、协议转换、加密隧道、串口桥接,这些场景在日常运维和开发调试中比你想象的出现得更频繁。

我现在遇到网络调试的需求,第一反应已经从 nc 变成了 socat,主要因为它的行为更一致、功能更全面,而且在 SSL 和 Unix socket 这些场景上完全没有替代品。如果你还没把它放进自己的工具箱,值得花半个小时好好熟悉一下。