2026-06-01 10:25:05

GitHub 地址:https://github.com/hellodk34/linux-quick-translate

在 Linux 桌面环境快速查词/翻译句子,绑定系统全局快捷键。支持各种 Linux 发行版和不同的 DE(桌面环境)。详细食用方法请看 GitHub

选中文本 → 复制( Ctrl+C )→ 按 Super+C 弹出结果。

这样在浏览器或者系统中的任何地方阅读英文文献/文章都能快速翻译,复制文章的全部文本也能翻译整篇文章。

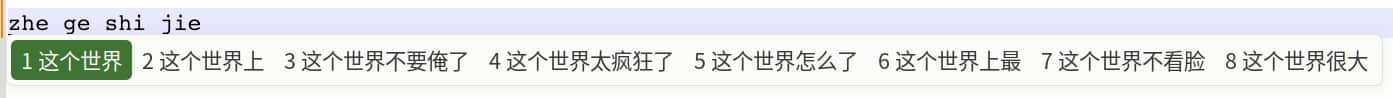

截图展示:

欢迎使用!

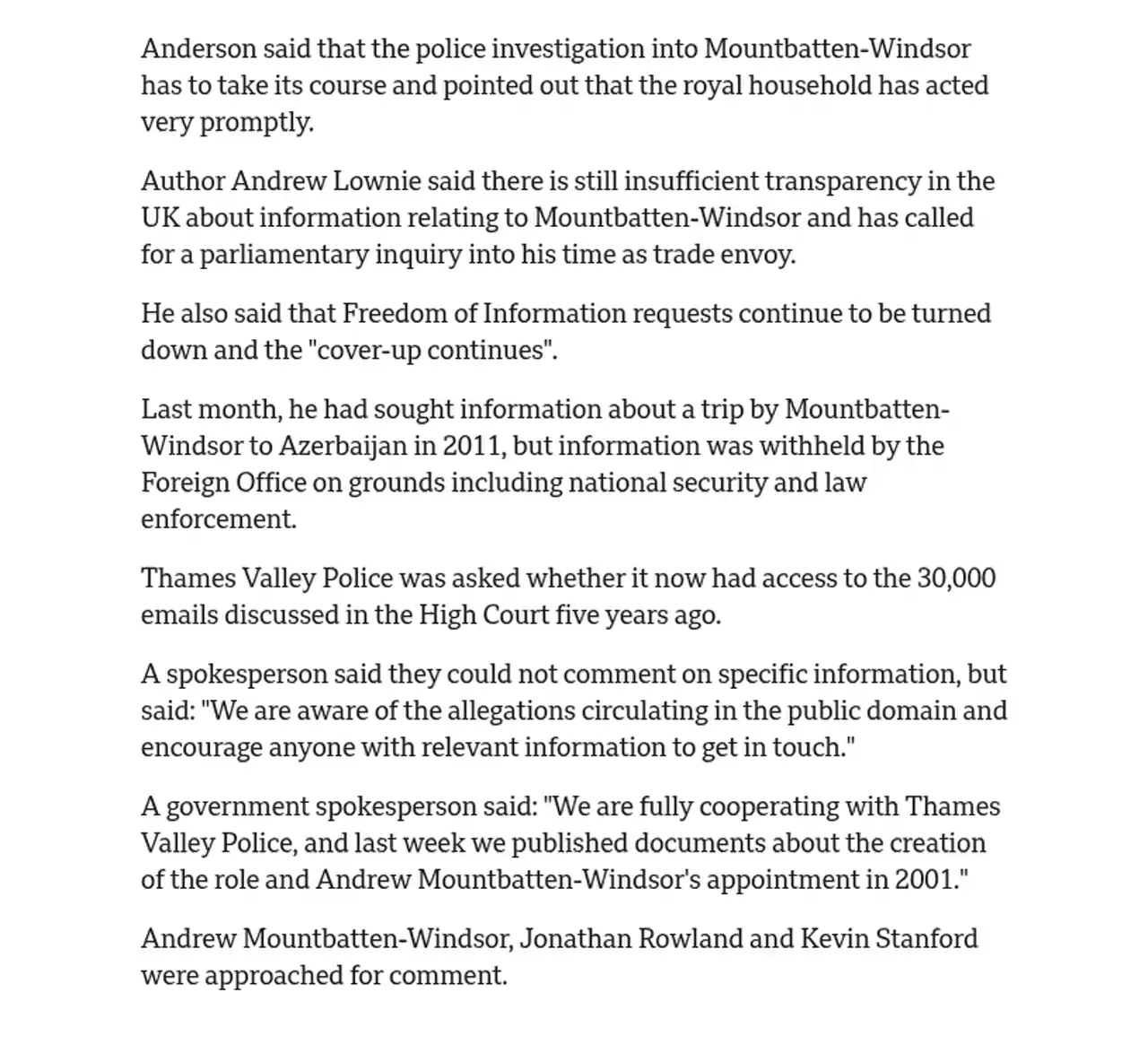

2026-06-01 10:06:31

使用截图

介绍请看 GitHub,这里懒得再写一遍了。地址 https://github.com/hellodk34/checkitout_weather_android

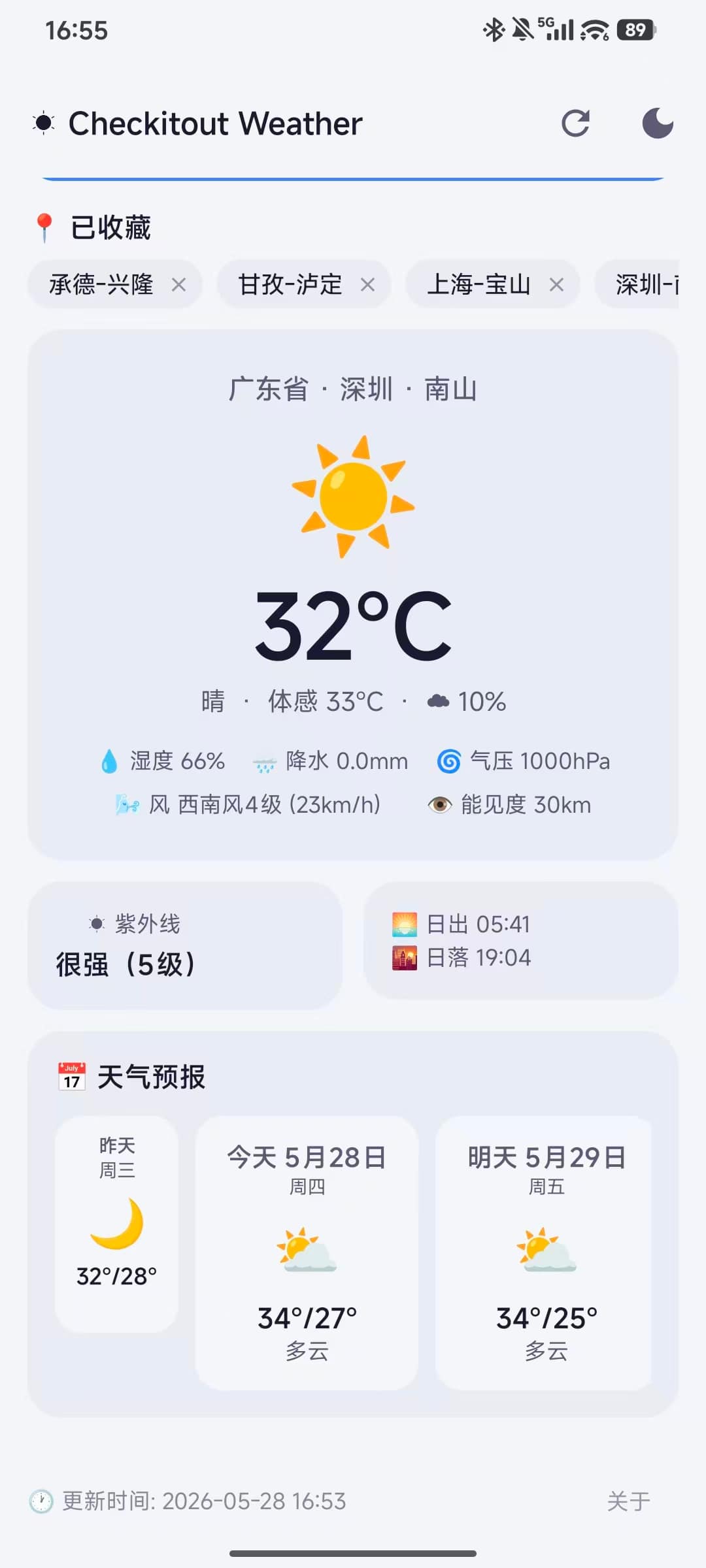

2026-05-25 15:27:00

vibe coding的程序。暂时构建了 win 和 linux 的。mac 没设备暂时。

开源以及下载地址: GitHub ,使用的和风天气API ,由于 API收费,免费的有额度但是不多,所以开源版是无 api auth的。使用了更新的 JWT 认证,更安全,受支持也更久(类似 LTS ),传统的 API KEY 认证方式将很快受到请求量的限制。

功能:

使用截图如下

欢迎下载使用。

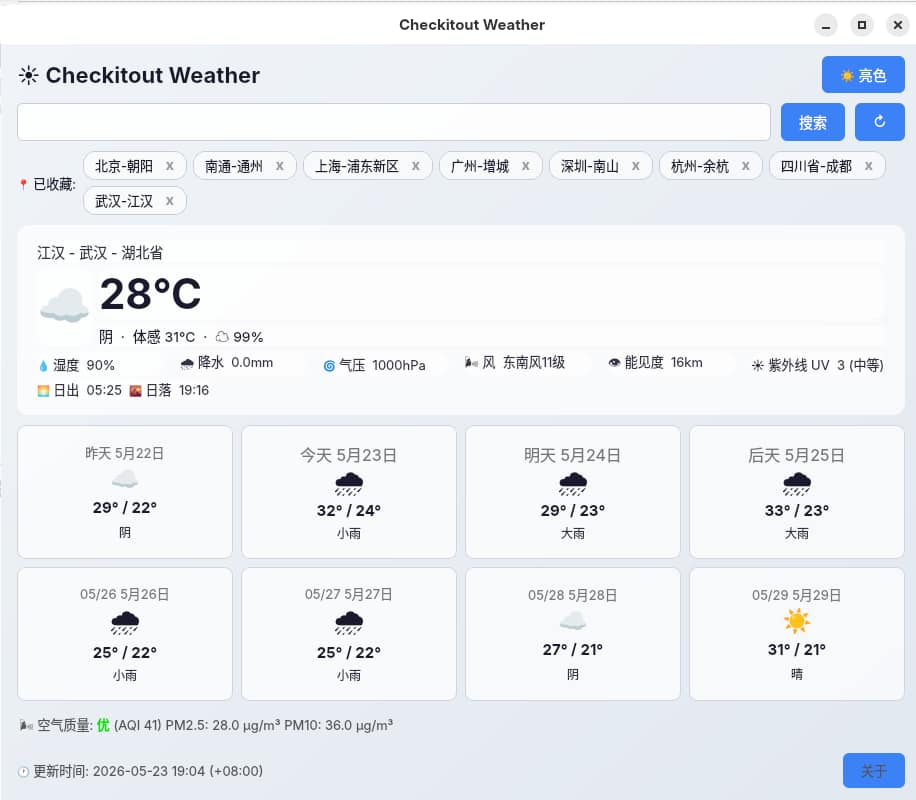

2026-05-21 13:36:00

欢迎使用 linux 桌面的朋友们使用,构建脚本都开源了,开源在 https://github.com/hellodk34/caesium-image-compressor

原来有一个维护者 https://github.com/larygwil/caesium-image-compressor 但是他停更了,止步于 v2.6.0 ,并且项目没有开启 issues ,于是我就自己来了。

这个图片压缩程序我昨晚用了,傍晚出去拿相机拍了几张照片,压缩了效果很不错,并且保持了原有分辨率。前段时间我常用索尼的 Creators' App 的 2M 传输的选项,虽然每张照片也还能看,并且体积只有 500KB 左右,但是被砍成了 200 万像素……

以前我都用 squoosh 的,但是 squoosh 做批量压缩搞个好用的 flow 还是比较麻烦和困难的,这个 GUI 程序正中我的口味。原作者构建了 win/macOS 程序,但是缺少 Linux 这边的构建。

使用截图

随机赠送一张昨晚拍的照片 😁

2026-05-19 11:24:36

代码开源,部署简单 GitHub

满足自用,如有新需求可以 fork 自己开发,比如推送到飞书机器人等。

手环设置一下,也能收到推送,效果图如下。

2026-05-11 10:41:00

前些天发现并使用了 fcitx5-vinput,效果还不错,在此推荐给大家

注意:

~/.local/share/gnome-shell/extensions/[email protected]/stylesheet.css),然后要更改候选文字样式可以直接修改这个文件,推荐一个我当前正在使用的“主题样式”

代码如下

/* Candlelight Spring inspired light theme for kimpanel */

.popup-menu-boxpointer.kimpanel-popup-boxpointer {

-arrow-background-color: transparent;

-arrow-border-color: transparent;

-arrow-border-width: 0px;

background-color: transparent;

border: 0px;

border-radius: 0px;

box-shadow: none;

padding: 0px;

margin: 0px;

}

.popup-menu.kimpanel-popup-boxpointer {

background-color: transparent;

border: 0px;

border-radius: 0px;

box-shadow: none;

padding: 0px;

margin: 0px;

}

.popup-menu-content.kimpanel-popup-content {

background-color: #fbfcf9;

border: 1px solid #dce5d8;

border-radius: 8px;

box-shadow: 0 2px 12px rgba(64, 116, 52, 0.08);

padding: 4px 4px;

margin: 0px;

}

.kimpanel-label {

font-family: "Sans";

font-weight: normal;

color: #3a3a3a;

padding: 0px;

}

.kimpanel-label:not(.kimpanel-candidate-item) {

padding: 4px 8px;

color: #888888;

}

.kimpanel-candidate-item {

cursor: pointer;

transition-duration: 0ms;

border-radius: 6px;

margin: 1px 0px;

padding: 4px 10px !important;

color: #3a3a3a;

}

.kimpanel-candidate-item:hover {

background-color: rgba(64, 116, 52, 0.08);

}

.kimpanel-candidate-item:active {

background-color: #407434;

color: #ffffff;

border: 0px;

box-shadow: none;

}

.kimpanel-candidate-item:active:hover {

background-color: #4a853d;

color: #ffffff;

}

.minwidth-zero {

min-width: 0;

}

.icon-disable {

color: rgba(150, 150, 150, 0.5);

}

功能比较简单,基于百度实时语音识别 wss API 实现的 web 浏览器“语音输入法”,支持简体中文(普通话和部分方言)和英语,将

语音实时转成文字。

GitHub地址: https://github.com/hellodk34/baidu-asr 喜欢的话帮忙点个⭐

动图演示

剩下的内容看 GitHub 仓库 README 吧~ 这里就不赘述了。做这个主要是满足自用,嘿嘿,偶尔需要用到的时候还是有用的。